处理不均衡数据集

发布时间: 2024-09-04 11:11:08 阅读量: 68 订阅数: 40

不平衡数据多分类数据集.rar

# 1. 不均衡数据集概述

在机器学习和数据挖掘领域,数据集是构建预测模型的基础。然而,并非所有数据集都是平等的,特别是数据的分布往往会出现不平衡。**不均衡数据集**指的是在分类问题中,各类别的样本量存在显著差异。这种情况在现实世界应用中非常普遍,例如,信用卡欺诈检测中正常交易远多于欺诈交易。

不平衡的数据分布会严重干扰模型的训练和评估,导致模型对多数类过拟合,而对少数类的预测能力较差。为了更好地理解不均衡数据集带来的挑战,本章将首先介绍不均衡数据集的基本概念,然后分析其对机器学习流程的影响。

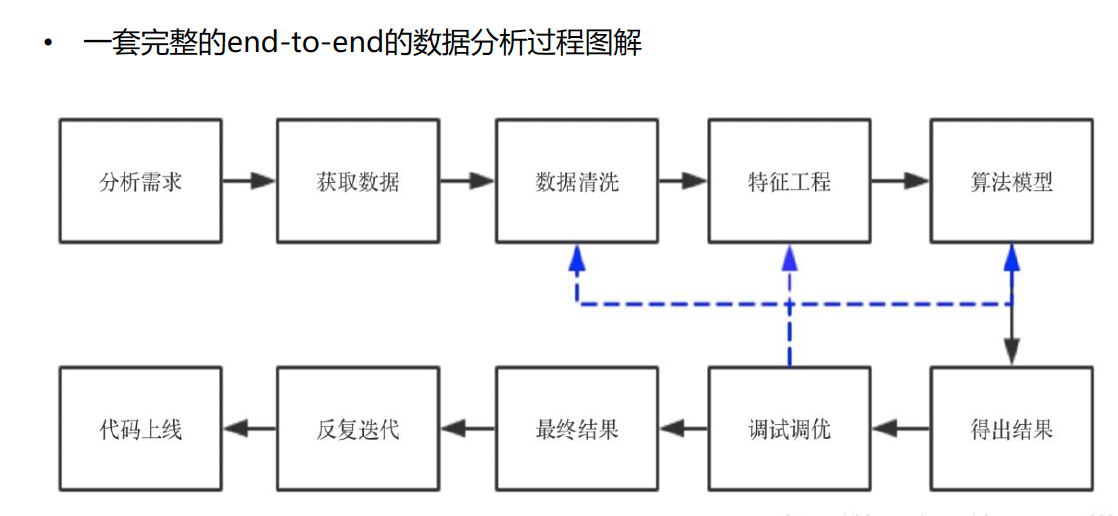

> 在实际应用中,不平衡数据集的处理通常包括以下步骤:

> - 数据收集:了解数据源,确保数据的质量和多样性。

> - 数据预处理:识别并处理缺失值、异常值和不平衡问题。

> - 特征工程:选取有助于提高模型性能的特征。

> - 模型选择和调优:根据问题特性选择合适模型并调整参数。

> - 结果评估:使用适当的评估指标来量化模型性能。

接下来的章节将详细探讨不平衡数据集对机器学习模型的影响、评估指标的选择,以及现有的处理技术。这些内容对于任何希望构建健壮且可靠的机器学习系统的从业者来说,都是不可或缺的知识。

# 2. 不均衡数据集的影响分析

在现实世界的数据集中,不均衡现象普遍存在,这种现象不仅影响了数据的分布,还会对机器学习模型的构建和评估产生深远的影响。接下来,我们将深入探讨不均衡数据集对机器学习模型以及评估指标的具体影响。

### 2.1 对机器学习模型的影响

#### 2.1.1 准确率悖论

准确率是衡量分类模型性能的最直接指标,然而在面对不均衡数据集时,准确率这一指标可能会产生误导。这种现象被称为“准确率悖论”。在不均衡数据集中,即使模型没有学习到任何有用的信息,只是简单地预测多数类,也可能得到较高的准确率。这导致无法有效地反映模型对少数类的识别能力。

为了解决准确率悖论,需要采用更加精细的评价标准,比如考虑每个类别的预测结果,这将使我们能够更准确地衡量模型在面对少数类时的表现。常见的改进指标包括精确率、召回率和F1分数等。

#### 2.1.2 模型泛化能力分析

不均衡数据集会影响模型的泛化能力。在数据集中占多数的类别会主导模型的训练过程,导致模型对少数类的泛化能力不足。这种现象通常会导致模型对于数据中的多数类有过高的预测准确率,而对于少数类的预测准确率则相对较低,从而降低了模型整体的泛化能力。

为提高模型的泛化能力,研究者们提出了各种策略,如改变数据集的分布,使得每个类别都对模型的构建起到平衡的作用,或是采用特定的评估指标来优化模型。

### 2.2 对评估指标的影响

#### 2.2.1 常见评估指标概述

在处理不均衡数据集时,传统的评估指标如准确率、误差率等可能不再适用。因此,需要采用更加综合和细腻的评价标准。以下是一些常见的评估指标:

- 精确率(Precision):指预测为正类中的实际正类的比例。

- 召回率(Recall):指实际为正类中被预测为正类的比例。

- F1分数(F1 Score):精确率和召回率的调和平均数,是二者的一种综合指标。

- ROC曲线和AUC值:ROC曲线是反映模型性能的图形化手段,AUC值是曲线下面积,用来衡量模型在不同分类阈值下的性能。

#### 2.2.2 不平衡数据下的评估指标选择

在不平衡数据集上,单纯的准确率往往不是一个好的性能指标。准确率可能无法准确反映模型对少数类的识别能力。因此,在此类问题上,我们更倾向于使用那些能够同时考虑不同类别性能的指标。

F1分数因为是精确率和召回率的调和平均,常常作为评估的首选指标。除此之外,我们还可以使用ROC-AUC、PR-AUC(精确率-召回率曲线下的面积)等指标,这些指标可以更好地平衡不同类别的贡献,对模型的评估更加全面和公正。

接下来的章节中,我们将详细介绍如何在实际应用中处理不均衡数据集,以及如何选择合适的工具和技术来优化模型性能。

# 3. 不均衡数据集处理技术

## 3.1 数据层面的方法

在处理不均衡数据集问题时,数据层面的方法是最直接且常用的技术之一。这类方法主要通过调整数据集中的样本分布来改善数据的平衡性,以此来提高模型对少数类的识别能力。

### 3.1.1 过采样技术

过采样是一种简单直接的数据增强技术,它通过增加少数类样本的数量来平衡数据集。过采样可以有效地提高模型对少数类的识别率,但过度过采样可能会导致过拟合。

#### 随机过采样

随机过采样技术通常涉及随机复制少数类样本,直到其数量与多数类相匹配。尽管这种方法简单且易于实现,但它可能导致信息丢失,并且增加过拟合的风险。

```python

from imblearn.over_sampling import RandomOverSampler

ros = RandomOverSampler(random_state=42)

X_resampled, y_resampled = ros.fit_resample(X, y)

```

在上述代码中,我们使用了`imblearn`库中的`RandomOverSampler`,它复制少数类样本来平衡数据集。`random_state`参数用于设置随机种子,以确保实验的可重复性。

#### 合成少数类过采样技术(SMOTE)

为了克服随机过采样中过拟合的风险,合成少数类过采样技术(Synthetic Minority Over-sampling Technique, SMOTE)应运而生。SMOTE生成新的少数类样本,而不是简单地复制现有样本。这些新样本是根据少数类样本之间的距离和插值合成的。

```python

from imblearn.over_sampling import SMOTE

smote = SMOTE(random_state=42)

X_resampled, y_resampled = smote.fit_resample(X, y)

```

上述代码展示了如何使用`SMOTE`类,其中`X`和`y`是原始特征和标签数据。`SMOTE`通过在现有少数类样本之间进行插值来生成新的合成样本。

### 3.1.2 欠采样技术

与过采样相反,欠采样通过减少多数类样本的数量来平衡数据集。虽然这种方法可以减少模型训练时间,但它可能会丢失重要信息,因为多数类中的有用信息可能被忽略。

#### 随机欠采样

随机欠采样技术通过随机删除多数类中的样本以平衡数据集。这种方法简单但可能会丢失对模型性能至关重要的多数类样本。

```python

from imblearn.under_sampling import RandomUnderSampler

rus = RandomUnderSampler(random_state=42)

X_resampled, y_resampled = rus.fit_resample(X, y)

```

上述代码展示了`RandomUnderSampler`类的使用。通过随机选择多数类样本进行删除,以获得一个平衡的数据集。

#### 集成方法和代价敏感学习

集成方法结合了过采样和欠采样的优点,通过创建多个平衡的数据子集并构建多个模型来集成最终的结果。代价敏感学习则是一种让模型在训练时对不同类别的错误赋予不同的权重的学习方法,以此来减少对多数类的偏见。

```python

# 集成方法示例代码

from imblearn.ensemble import BalancedBaggingClassifier

balanced_bagging_clf = BalancedBaggingClassifier(

base_estimator=DecisionTreeClassifier(),

n_estimators=10,

sampling_strategy='auto',

random_state=42

)

balanced_bagging_clf.fit(X_train, y_train)

```

上述代码使用了`imblearn`库中的`BalancedBaggingClassifier`,它是一个集成分类器,能够自动平衡数据集,并应用在每个基础分类器的训练中。

```python

# 代价敏感学习示

```

0

0