剪枝方法新趋势

发布时间: 2024-09-04 10:49:56 阅读量: 50 订阅数: 35

# 1. 剪枝方法的基本概念

## 1.1 剪枝的定义与用途

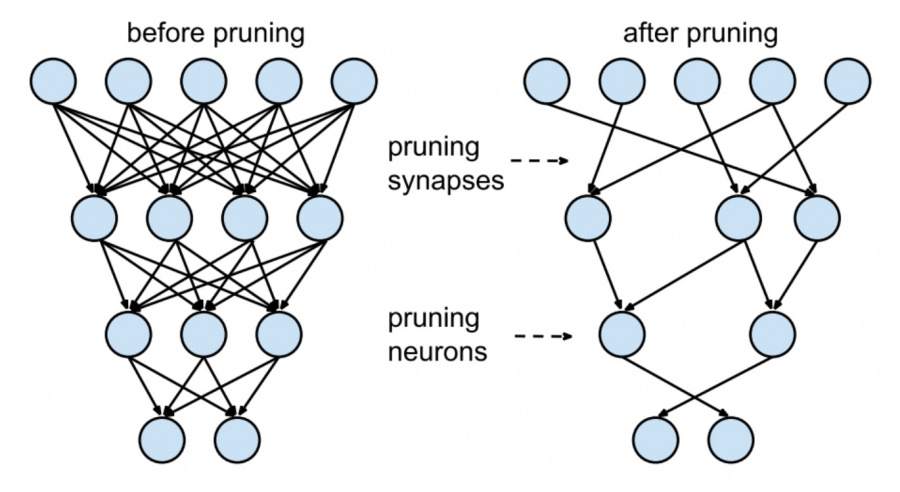

剪枝是一种模型简化技术,常应用于机器学习和数据挖掘领域。它通过减少决策树中不必要的分支,或者精简深度神经网络中的冗余参数,来简化模型结构。剪枝的目的是为了防止过拟合,提高模型在未知数据上的泛化能力。

## 1.2 剪枝与模型复杂度

模型复杂度是影响模型预测准确性和泛化能力的关键因素之一。剪枝通过消除多余的复杂度,能够减少模型训练和预测的时间,同时避免过拟合的风险。模型简化后,也可能提高模型在有限计算资源下的实用性。

## 1.3 剪枝的分类

剪枝可以分为两大类:预剪枝(Pre-pruning)和后剪枝(Post-pruning)。预剪枝是在模型构建过程中进行,它通过提前停止决策树的生长或神经网络的训练来避免不必要的复杂度。而后剪枝则是在模型完全训练后,根据某种准则(如成本复杂度)去除不重要的部分。预剪枝较易实施且计算开销较小,而后剪枝能更加精确地控制模型复杂度。

请注意,章节内容应确保与目录结构一致,并且每个章节都应有明确的介绍和递进式的内容展开。此外,对于每一章节的深入分析,应有详细的示例、代码块、逻辑解释,以及相关的参数说明和性能评估。

# 2. 经典剪枝技术的演进

## 2.1 决策树剪枝理论

### 2.1.1 剪枝的必要性

在构建决策树模型时,如果没有对树的复杂性进行控制,模型可能会过度拟合训练数据。这意味着模型在训练集上的表现非常好,但在未见过的数据上表现较差。剪枝技术的引入是为了防止过度拟合,通过减少模型的复杂度,提高模型的泛化能力。

剪枝可以分为预剪枝(pre-pruning)和后剪枝(post-pruning)。预剪枝是在决策树构建过程中,当满足某些条件(如节点的最小样本数或信息增益阈值)时提前停止树的增长。而后剪枝是在完全构建决策树之后,通过评估节点的不纯度和剪枝的成本效益比来去除一些节点。

### 2.1.2 传统剪枝方法回顾

历史上,许多研究者提出了不同的剪枝方法,为剪枝技术的发展奠定了基础。其中,最著名的包括Quinlan提出的C4.5算法中使用的剪枝技术,它主要通过计算节点的误差增益来决定是否剪枝。还有其他算法,如CART(Classification and Regression Trees)和SLIQ(Supervised Learning In Quest)等,它们使用不同的标准和策略进行剪枝。

C4.5和CART算法在剪枝时考虑了不同的因素,如树的大小和节点分类的准确性。SLIQ则引入了先验知识的概念,通过记录不同属性的分布信息来优化剪枝过程。

## 2.2 典型剪枝算法详解

### 2.2.1 预剪枝与后剪枝策略

预剪枝和后剪枝各有优势和不足。预剪枝简单直接,通过提前停止树的生长减少了模型的复杂度,但可能会在某些情况下剪枝过早,导致模型欠拟合。而后剪枝则允许模型自由生长,然后根据某种标准(如最小描述长度)来优化树的结构,这通常可以得到更精确的模型,但计算成本较高。

举例来说,C4.5算法通过计算每个节点的增益比,并与预设的阈值进行比较来进行剪枝。如果剪枝后分类错误的增加小于一定的阈值,则该节点被视为可剪枝节点。

```python

# C4.5算法中预剪枝的简单实现示例

def c45_prepruning(train_data, threshold):

# 训练数据和剪枝阈值作为输入

# 该示例未展示完整树构建过程,仅展示剪枝判断逻辑

error_gain = calculate_error_gain(train_data)

if error_gain < threshold:

return True # 表示节点可剪枝

return False

```

### 2.2.2 常见算法比较:C4.5,CART,SLIQ

每种剪枝算法都有其独特的优势和适用场景。C4.5算法通过计算信息增益来进行剪枝,适合于中小规模数据集。CART算法则使用基尼指数(Gini Index)作为剪枝依据,适合处理分类和回归问题。而SLIQ算法由于其能够处理大规模数据集的特点,在大数据环境下表现突出。

### 2.3 剪枝技术的优化方向

#### 2.3.1 参数调优策略

剪枝技术的性能很大程度上取决于所使用的参数。对于不同数据集,最优的剪枝阈值可能不同。因此,参数调优是提高剪枝效果的关键。常见的参数调优策略包括网格搜索(Grid Search)、随机搜索(Random Search)和贝叶斯优化等。

在实际应用中,网格搜索通过遍历所有可能的参数组合来寻找最优解,但计算成本较高。随机搜索则通过随机选择参数组合来减少计算量。贝叶斯优化则是一种更为高效的方法,通过构建一个代理模型来预测最优的参数值。

#### 2.3.2 算法性能的评估与改进

评估剪枝算法的性能通常涉及到计算成本和模型的准确性。准确性和模型复杂度是剪枝算法改进的主要考虑因素。在保证模型准确性的前提下,减少节点数量和树的深度是优化的方向。

改进剪枝算法的方法包括引入新的剪枝标准、采用启发式算法进行搜索最优剪枝路径等。例如,可以通过深度学习的方法来预测剪枝的效益,从而动态调整剪枝策略。

通过以上的章节内容,我们可以看出,剪枝技术从理论到实践都具有深厚的内涵。它不仅在决策树领域有着广泛的应用,在深度学习模型的优化方面也展现出巨大的潜力。随着算法和技术的不断发展,我们可以期待剪枝技术将带来更多突破。

0

0