深入MapReduce:全面剖析数据处理流程

发布时间: 2024-10-30 16:07:18 阅读量: 23 订阅数: 28

# 1. MapReduce概念与基本原理

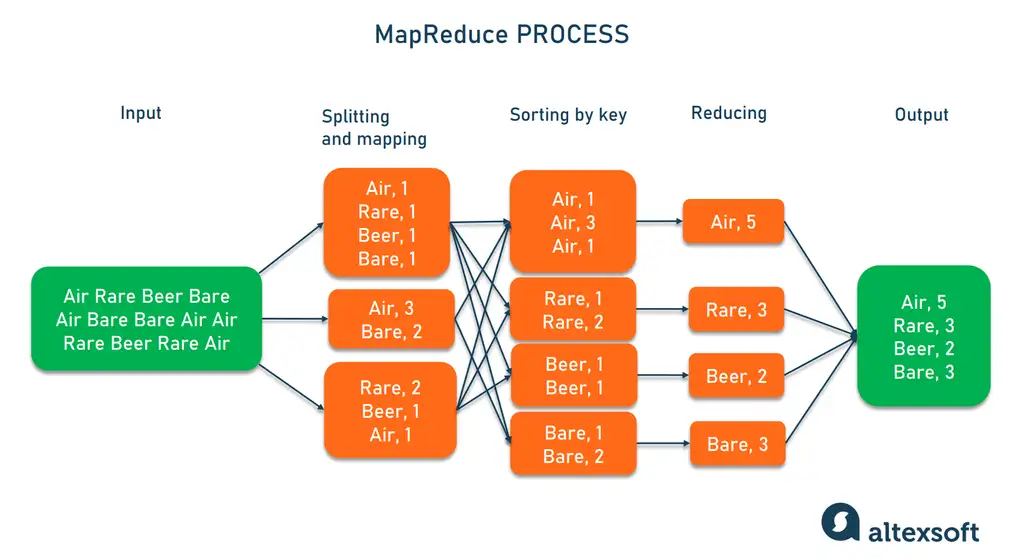

MapReduce是一种编程模型,用于大规模数据集的并行运算。它由Google提出,并成为Hadoop等大数据处理框架的核心组件。基本原理是通过分而治之的方式将任务分为Map(映射)和Reduce(归约)两个阶段来处理。Map阶段处理数据并生成键值对(key-value pairs),而Reduce阶段则对具有相同键(key)的数据进行合并处理。这种模型特别适合于那些可以分解为一系列可以并行处理任务的大数据处理场景,比如日志分析、搜索引擎索引构建等。MapReduce通过这种分阶段处理方式,简化了大数据运算的复杂度,同时易于扩展至成百上千的计算节点。接下来的章节将深入解析MapReduce的核心组件和编程实践,以便读者能够更全面地理解和应用这一强大的数据处理模型。

# 2. MapReduce核心组件解析

### 2.1 Map阶段的执行过程

#### 2.1.1 数据分片与输入格式

MapReduce框架将输入文件分割成固定大小的数据分片(splits),每个分片作为Map任务的输入。数据分片的大小影响到任务并行度和资源使用,通常由Hadoop配置参数`dfs.block.size`设置,决定了HDFS中文件块的大小。在执行Map阶段之前,MapReduce会对输入的分片进行格式化处理,这个过程是通过InputFormat类完成的。

在Java中,一个典型的InputFormat是`TextInputFormat`,它是处理文本文件的默认InputFormat。它读取的每个数据分片通常对应于HDFS中的一个块,使用`RecordReader`来将分片中的数据转换为键值对(key-value pairs)。键通常是行的偏移量,值是行内容。

```java

// 代码段展示如何配置TextInputFormat

Configuration conf = new Configuration();

Job job = Job.getInstance(conf, "MapReduce Input Format Example");

job.setInputFormatClass(TextInputFormat.class);

```

#### 2.1.2 Map函数的作用与实现

Map函数处理输入分片中的数据,生成中间键值对。这是用户定义的函数,在实际应用中需要根据具体需求编写相应的逻辑。Map函数的输出会直接作为Shuffle过程的输入。

下面是一个简单的Map函数的实现,用于计算输入文件中每个单词出现的次数:

```java

public static class TokenizerMapper

extends Mapper<Object, Text, Text, IntWritable> {

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(Object key, Text value, Context context

) throws IOException, InterruptedException {

StringTokenizer itr = new StringTokenizer(value.toString());

while (itr.hasMoreTokens()) {

word.set(itr.nextToken());

context.write(word, one);

}

}

}

```

### 2.2 Shuffle与Sort机制

#### 2.2.1 Shuffle过程详解

Shuffle是MapReduce处理过程中的关键步骤,它将Map阶段输出的数据分发到相应的Reduce任务。这个过程包括了数据的传输、合并、排序等。

Shuffle过程可以被分为三个阶段:

1. **Copy阶段**:Map任务完成并开始Shuffle时,MapReduce框架开始从Map任务节点拉取中间结果。这个过程涉及到网络传输,大量数据的移动可能会成为性能瓶颈。

2. **Sort阶段**:拉取的数据首先在Reduce节点进行合并和排序。这保证了每个Reduce任务接收到的数据是有序的。

3. **Spill阶段**:一旦缓冲区的数据达到一定大小(通过参数`io.sort.factor`控制),它会被溢写(spill)到磁盘。这个过程是为了防止内存溢出,也是为了避免内存使用过高导致的垃圾回收(GC)性能问题。

下面是一个简化的伪代码,展示了Shuffle过程中数据排序和溢写的逻辑:

```java

// 伪代码,用于说明Shuffle过程中的排序和溢写逻辑

List<KeyValue> buffer = new ArrayList<KeyValue>();

for (KeyValue kv : data) {

if (buffer.size() < io.sort.factor) {

buffer.add(kv);

} else {

// Sort the buffer and write it to disk

sort(buffer);

spill(buffer);

buffer.clear();

}

}

// After all map tasks are finished

// Sort and merge all the spilled data

sort(buffer);

merge(sortedBuffers);

```

#### 2.2.2 排序与数据分区

排序是Shuffle过程的一部分,而分区则发生在排序之后,确保Map阶段的输出被正确地分发到每个Reduce任务。每个Map任务的输出都包含多个键值对,这些键值对需要根据键的范围来分配给不同的Reduce任务。这一步骤是由Partitioner组件完成的,它决定了哪个Reduce任务负责处理特定键值对。

```java

// 自定义Partitioner

public class CustomPartitioner extends Partitioner<Text, IntWritable> {

public int getPartition(Text key, IntWritable value, int numPartitions) {

// Return partition number based on key

return (key.hashCode() & Integer.MAX_VALUE) % numPartitions;

}

}

```

在配置阶段,需要确保分区器与MapReduce作业一起设置:

```java

job.setPartitionerClass(CustomPartitioner.class);

```

### 2.3 Reduce阶段的工作原理

#### 2.3.1 Reduce任务的启动与数据合并

Reduce任务在所有Map任务完成后启动,Reduce阶段处理的键值对是Shuffle过程中排序和分区后的结果。Reduce任务开始时,它首先会调用`setup()`方法进行初始化,然后从所有Map任务拉取排序好的数据。这个过程称为Copy阶段。

在`reduce()`方法中,Reduce任务处理从Map阶段得到的中间数据,将具有相同键(key)的值(values)进行合并。每个键值对都会调用一次用户定义的`reduce()`函数。

下面是一个简单的Reduce函数实现:

```java

public static class IntSumReducer

extends Reducer<Text, IntWritable, Text, IntWritable> {

private IntWritable result = new IntWritable();

public void reduce(Text key, Iterable<IntWritable> values,

Context context

) throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

result.set(sum);

context.write(key, result);

}

}

```

#### 2.3.2 Reduce函数的执行逻辑

Reduce函数的逻辑包括对中间数据进行汇总和进一步处理。在执行Reduce任务时,框架会调用`setup()`、`reduce()`以及`cleanup()`方法。其中,`reduce()`方法是核心,它对每个键值对进行处理,并将结果写入最终输出文件。`cleanup()`方法用于清理资源,比如关闭打开的文件句柄。

Reduce任务的执行逻辑需要考虑数据合并的效率和内存管理,特别是当处理的数据量非常大时。合理的优化措施包括设置合适的内存缓冲区大小和调整Shuffle缓冲区的参数。

```java

// 在Reduce任务中执行自定义清理操作

public void cleanup(Context context) throws IOException, InterruptedException {

// Perform cleanup operation

}

```

在配置阶段,可以对Reduce任务进行细粒度的调优:

```java

job.setReducerClass(IntSumReducer.class);

```

以上所述是MapReduce核心组件解析章节中的一部分内容。Map阶段和Reduce阶段均包括更深入的内容,涉及数据处理、任务调度与优化等各个方面。在实际开发与应用中,理解这些组件的工作原理将有助于开发更高效的MapReduce程序。

# 3. MapReduce编程实践

#### 3.2 MapReduce应用案例分析

##### 3.2.1 单词计数案例详解

在Hadoop和MapReduce的众多入门案例中,单词计数(Word Count)无疑是最具代表性的一个。它通过统计输入文本中各个单词出现的次数,来展示MapReduce程序的基本构成和处理流程。本节将详细介绍如何通过MapReduce实现单词计数案例,并通过代码块展示具体的编程实践。

首先,我们假设有一个文本文件作为输入数据,该文件包含如下内容:

```text

hello world hello mapreduce

hello hadoop hello spark

```

我们的目标是统计每个单词出现的次数。以下是MapReduce程序的结构:

```java

public class WordCount {

public static class TokenizerMapper

extends Mapper<Object, Text, Text, IntWritable>{

private final static IntWritable one = new IntWritable(1);

private Text word = new Text();

public void map(Object key, Text value, Context context

) throws IOException, InterruptedException {

StringTokenizer itr = new StringTokenizer(value.toString());

while (itr.hasMoreTokens()) {

word.set(itr.nextToken());

context.write(word, o

```

0

0