数据压缩技巧:MapReduce Shuffle提升排序效率的必杀技

发布时间: 2024-10-31 02:44:22 阅读量: 2 订阅数: 4

# 1. MapReduce Shuffle排序原理

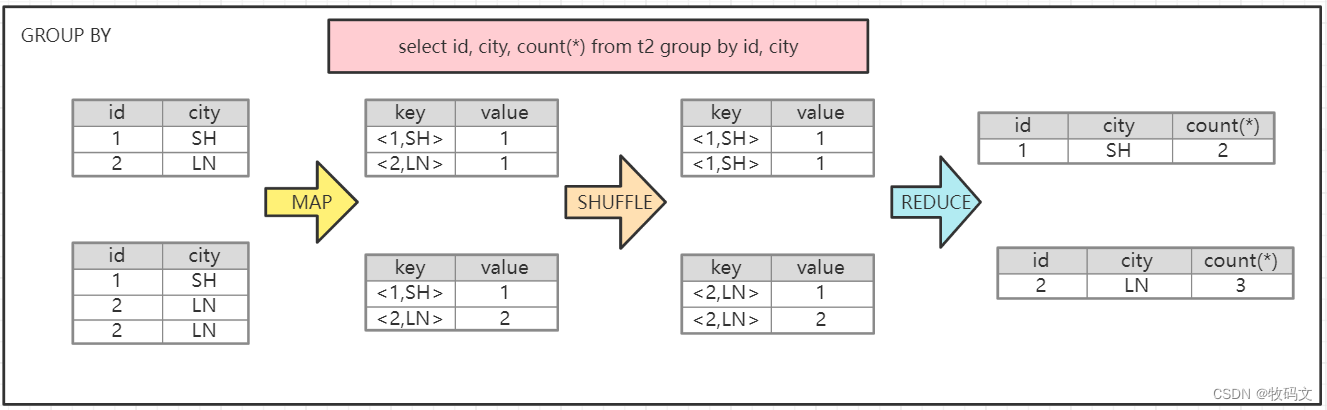

在分布式计算框架中,MapReduce Shuffle排序是一个关键步骤,它在Map和Reduce任务之间进行数据的重新分布和排序。 Shuffle排序确保了在Map阶段处理完成的数据能够按照一定的规则传递到Reduce阶段进行处理。这个过程通常分为两部分:Shuffle和Sort。Shuffle负责数据的迁移和聚合,而Sort则保证数据按照key进行有序排列。

Shuffle排序的效率直接影响着整个MapReduce作业的性能。在数据量大时,如果Shuffle过程中的数据传输和排序不够高效,将导致大量的网络IO和磁盘IO开销,延长作业完成时间。因此,了解Shuffle排序的原理和优化策略对于大数据处理至关重要。

本章将深入分析MapReduce Shuffle排序的机制,从数据的分区、排序、归并,到最终的网络传输,我们将逐步揭开Shuffle排序神秘的面纱,揭示其对整个MapReduce作业效率影响的内在原因。通过本章的学习,读者将能够对Shuffle排序有一个全面的认识,并掌握提升排序效率的基本策略。

# 2. 数据压缩的理论基础

## 2.1 数据压缩的概念和分类

数据压缩,也被称为编码,是将信息表示为更紧凑的形式的一系列过程,目的是减少存储空间或者减少传输时间。在数据处理和大数据分析中,数据压缩技术尤为重要,因为它们可以大幅降低存储和网络传输的成本。

### 2.1.1 压缩算法的基本原理

压缩算法可以分为两类:无损压缩和有损压缩。无损压缩指的是在压缩过程中不丢失任何信息,解压缩后能够完美还原原始数据;有损压缩则是通过牺牲一些信息来获得更高的压缩比,解压缩后得到的数据与原始数据有所不同。

无损压缩算法通常依赖于数据中的冗余信息。比如,如果一段文本中反复出现相同的字串,算法可以将这个字串用一个简短的代码来代替,解压缩时再将这个代码恢复为原始字串。有损压缩算法广泛应用于图像、音频和视频等媒体数据,因为人眼和人耳对某些信息并不敏感,所以可以安全地丢弃这些部分,以实现更高的压缩率。

### 2.1.2 压缩算法的分类及应用场景

压缩算法的分类和应用场景:

- **静态压缩**:在压缩之前,算法不需要知道任何关于数据的信息。适用于通用目的,如ZIP文件压缩。

- **动态压缩**:算法根据数据的统计特性动态调整压缩策略。适用于特定类型的数据集,如视频流。

## 2.2 常用的数据压缩技术

### 2.2.1 Huffman编码和LZ77压缩

**Huffman编码**是一种广泛使用的静态压缩算法。它通过构建一个Huffman树来编码信息,频繁出现的数据被赋予较短的编码,不频繁出现的则赋予较长的编码。Huffman编码适用于各种类型的数据,尤其在文本文件压缩中表现优异。

**LZ77算法**是一种基于字典的压缩算法,它利用输入数据中的重复模式。LZ77维护一个滑动窗口来保存最近处理过的数据段,如果重复出现相同的字符串,就用指针指向之前出现过的位置和长度来代替重复字符串。

### 2.2.2 Gzip和Snappy压缩技术详解

**Gzip**是基于Deflate算法的一种压缩工具,它结合了LZ77算法和Huffman编码。Gzip广泛应用于文件压缩,尤其是在Linux环境中,通常通过gzip命令或者zlib库来使用。

**Snappy**是由Google开发的一种快速压缩库,它的目的是提供尽可能高的压缩和解压缩速度,同时保持合理的压缩率。Snappy非常适合于对速度要求高于压缩率的场合,比如实时数据处理和大数据应用。

### 2.2.3 压缩算法的选择与比较

选择合适的压缩算法需要考虑多个因素,如压缩速度、压缩率、内存占用和CPU负载。通常,无损压缩算法在需要完全还原数据的场景下使用,而有损压缩算法则适用于对还原精度要求不高的场合。

在实际应用中,Gzip提供了较好的压缩率和中等的压缩速度,适合文件压缩和网络传输;而Snappy则由于其高速压缩和解压缩能力,在需要快速处理大量数据的应用中更为合适。

为了更深入理解这些技术,让我们通过一个Mermaid流程图来展示Gzip压缩的基本过程:

```mermaid

graph LR

A[开始] --> B[读取数据]

B --> C[构建Huffman树]

C --> D[编码数据]

D --> E[输出压缩文件]

E --> F[结束]

```

## 2.3 表格展示常用压缩技术对比

下面表格展示了常用压缩技术的对比,以供读者参考:

| 特性 | Huffman编码 | LZ77压缩 | Gzip | Snappy |

|------------|--------------|--------------|---------------|---------------|

| 类型 | 静态无损压缩 | 动态无损压缩 | 静态无损压缩 | 动态无损压缩 |

| 压缩速度 | 较慢 | 中等 | 中等 | 非常快 |

| 解压缩速度 | 快速 | 较快 | 较快 | 非常快 |

| 压缩率 | 较低 | 较高 | 中等 | 较低 |

| 应用场景 | 文本压缩 | 各类数据压缩 | 文件压缩 | 实时数据处理 |

通过这个表格,我们可以看出不同压缩技术在不同维度上的性能差异,这对于选择适合的压缩算法具有重要的参考价值。

在下一章中,我们将讨论在MapReduce Shuffle阶段如何应用这些压缩技术,并探讨它们对Shuffle排序性能的影响。

# 3. MapReduce中的数据压缩实践

## 3.1 数据压缩在Shuffle阶段的应用

### 3.1.1 Shuffle过程中数据流分析

在MapReduce处理流程中,Shuffle阶段是负责将Map任务产生的中间数据(键值对)传输到Reduce任务的过程。这一过程涉及到网络传输、磁盘I/O以及内存管理等多个资源密集型的操作,因此在Shuffle阶段采用数据压缩技术,能够有效减少对这些资源的需求,提高整体数据处理的效率。

具体到Shuffle流程,Map任务完成后,输出的数据首先会被写入到磁盘,然后这些数据会根据其键(Key)进行排序和分区,以保证具有相同键的数据最终会发往同一个Reduce

0

0