XGBoost特征重要性:图像识别,赋能计算机视觉

发布时间: 2024-08-21 06:16:01 阅读量: 81 订阅数: 43

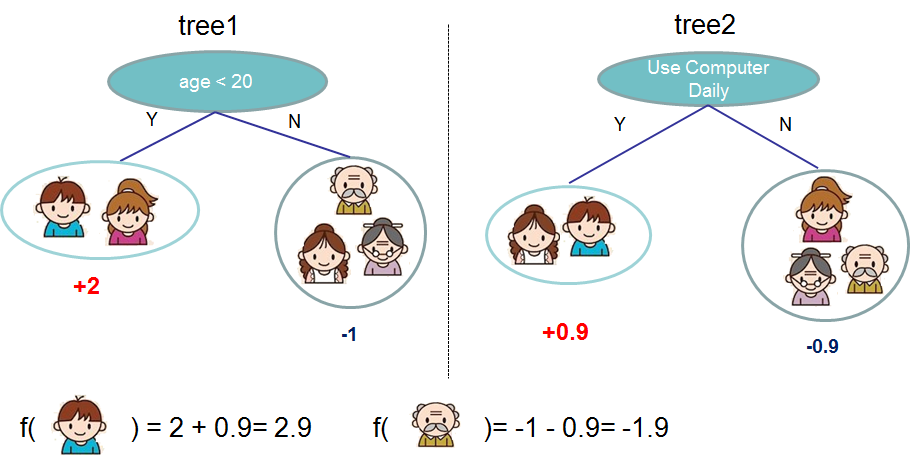

# 1. XGBoost简介

XGBoost(Extreme Gradient Boosting)是一种强大的机器学习算法,属于梯度提升决策树(GBDT)的范畴。它通过集成多个弱学习器(决策树)来构建一个强学习器,在各种机器学习任务中表现出色,尤其是在分类和回归问题上。XGBoost的优势在于其高效的算法、正则化技术和并行计算能力,使其能够处理大规模数据集并生成准确且可解释的模型。

# 2. XGBoost特征重要性理论

### 2.1 特征重要性概念

特征重要性是指特征对模型预测结果的影响程度。在机器学习中,特征重要性被用来衡量特征的相对重要性,从而帮助我们了解模型的决策过程,并识别对预测结果影响最大的特征。

### 2.2 XGBoost的特征重要性算法

XGBoost使用了一种称为“增益”的度量来计算特征重要性。增益衡量了将一个特征添加到模型中对模型预测精度的提升程度。具体来说,XGBoost计算每个特征的增益如下:

```python

gain(feature) = (loss_left - loss_right) * (H_left + H_right) / (H_total)

```

其中:

* `loss_left` 和 `loss_right` 是将特征添加到模型后左右子树的损失函数值

* `H_left` 和 `H_right` 是左右子树的叶子节点数

* `H_total` 是树的总叶子节点数

增益较高的特征表明该特征对模型预测精度的提升较大,因此具有更高的重要性。

### 2.2.1 增益的计算过程

增益的计算过程如下:

1. 将训练数据按照特征值进行排序。

2. 找到最佳分割点,将数据分成左右子树。

3. 计算左右子树的损失函数值和叶子节点数。

4. 计算增益。

### 2.2.2 增益的优点和缺点

增益作为特征重要性度量的优点包括:

* 简单易懂,计算方便。

* 可以处理连续和分类特征。

增益的缺点包括:

* 容易受到异常值的影响。

* 对于高基数特征(具有大量不同取值的特征),增益可能被高估。

### 2.2.3 其他特征重要性度量

除了增益之外,XGBoost还提供了其他特征重要性度量,包括:

* **权重:**每个特征在模型中使用的次数。

* **覆盖率:**特征在训练数据中出现的频率。

* **F-score:**特征重要性的统计检验。

这些度量可以提供不同的特征重要性视角,帮助我们更全面地了解模型的决策过程。

# 3. XGBoost特征重要性实践

### 3.1 数据准备和特征工程

在开始使用XGBoost计算特征重要性之前,需要对数据进行准备和特征工程。数据准备包括数据清洗、数据转换和数据归一化等操作,以确保数据质量和模型的稳定性。特征工程则涉及到特征选择、特征提取和特征转换等技术,以提升模型的性能。

### 3.2 模型训练和特征重要性计算

**3.2.1 模型训练**

使用准备好的数据训练XGBoost模型。模型训练过程涉及到设置模型参数,如学习率、树的深度和正则化参数等。

```python

import xgboost as xgb

# 设置模型参数

params = {

'max_depth': 5,

'learning_rate': 0.1,

'n_estimators': 100

}

# 训练模型

model = xgb.XGBClassifier(**params)

model.fit(X_train, y_train)

```

**3.2.2 特征重要性计算**

训练完成后,可以使用XGBoost提供的`feature_importances_`属性获取特征重要性。特征重要性是一个浮点数数组,表示每个特征对模型预测的影响程度。

```python

# 获取特征重要性

feature_importance

```

0

0