XGBoost特征重要性:立即提升模型性能的3个实用方法

发布时间: 2024-08-21 05:24:33 阅读量: 59 订阅数: 43

# 1. XGBoost特征重要性的概述**

XGBoost(Extreme Gradient Boosting)是一种流行的机器学习算法,以其强大的预测能力和对特征重要性的出色支持而闻名。特征重要性衡量了每个特征对模型预测的影响程度,对于理解模型行为、优化模型性能和做出明智的业务决策至关重要。

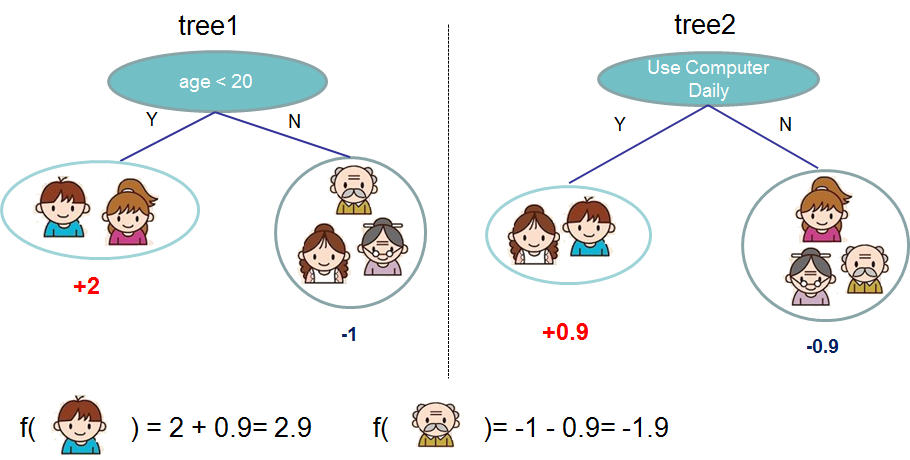

XGBoost的特征重要性基于其梯度提升树模型。梯度提升树通过迭代地添加树来构建模型,其中每个树都针对模型当前预测中的残差进行训练。在每个树的构建过程中,XGBoost会计算每个特征对残差减少的贡献,并根据这些贡献对特征进行排名。

特征重要性在机器学习中有着广泛的应用,包括:

- 特征选择:识别对模型预测影响最大的特征,并丢弃不重要的特征。

- 模型解释:了解模型的行为并解释其预测。

- 业务决策:基于特征重要性,确定对业务结果影响最大的因素。

# 2. 理论基础**

**2.1 XGBoost模型的原理**

**2.1.1 梯度提升树**

XGBoost是一种基于梯度提升树(GBDT)的机器学习算法。GBDT是一种集成学习算法,它通过组合多个弱学习器(如决策树)来创建一个强学习器。在GBDT中,每个弱学习器都针对前一个弱学习器的残差(预测误差)进行训练。

**2.1.2 正则化和特征选择**

XGBoost在GBDT的基础上加入了正则化和特征选择机制。正则化通过惩罚模型的复杂度来防止过拟合。特征选择通过选择与目标变量最相关的特征来提高模型的性能。

**2.2 特征重要性的概念和度量**

特征重要性衡量了每个特征对模型预测的影响程度。XGBoost提供了多种衡量特征重要性的方法:

**2.2.1 基于增益的度量**

* **增益:**特征分裂点处信息增益的大小。

* **增益比:**增益与分裂点处特征值的熵之比。

* **信息增益率:**增益与特征熵之比。

**2.2.2 基于惩罚的度量**

* **惩罚:**特征分裂点处正则化项的惩罚值。

* **F值:**增益与惩罚的比值。

* **权重:**特征在模型中使用的次数。

**代码块:**

```python

import xgboost as xgb

# 训练XGBoost模型

model = xgb.XGBClassifier()

model.fit(X, y)

# 获取特征重要性

importance = model.feature_importances_

# 打印特征重要性

print(importance)

```

**逻辑分析:**

这段代码使用XGBoost内置函数`feature_importances_`提取特征重要性。`importance`变量包含每个特征的权重,权重越高,特征越重要。

**参数说明:**

* `X`:训练数据特征矩阵。

* `y`:训练数据目标变量。

* `model`:训练后的XGBoost模型。

# 3. 实践应用**

### 3.1 提取特征重要性

#### 3.1.1 使用 XGBoost 内置函数

XGBoost 提供了内置函数 `get_score` 和 `get_fscore` 来提取特征重要性。`get_score` 根据增益度量返回特征重要性,而 `get_fscore` 根据惩罚度量返回特征重要性。

```python

import xgboost as xgb

model = xgb.XGBClassifier()

model.fit(X, y)

# 获取基于增益的特征重要性

gain_importance = model.get_score(importance_type='gain')

# 获取基于惩罚的特征重要性

fscore_importance = model.get_fscore(importance_type='weight')

```

#### 3.1.2 使用第三方库

除了 XGBoost 内置函数外,还有许多第三方库可以用来提取特征重要性,例如 SHAP 和 eli5。

**SHAP**

SHAP(SHapley Additive Explanations)是一个解释机器学习模型的库。它提供了一种计算每个特征对模型预测的影响的方法,从而得出特征重要性。

```python

import shap

# 创建 SHAP 解释器

explainer = shap.TreeExplainer(model)

# 计算特征重要性

shap_values = explainer.shap_values(X)

```

**eli5**

eli5 是一个解释机器学习模型的库,它提供了一个直观的界面来探索模型的特征重要性。

```python

import eli5

# 创建 eli5 解释器

explainer = eli5.explain_weights(model, feature_names=X.columns)

# 打印特征重要性

print(eli5.format_as_text(explainer))

```

### 3.2 特征重要性的可视化

#### 3.2.1 条形图

条形图是一种可视化特征重要性的常见方法。它显示了每个特征的重要性,按降序排列。

```python

import matplotlib.pyplot as plt

# 创建条形图

plt.bar(X.columns, gain_importance)

plt.xlabel('特征')

plt.ylabel('重要性')

plt.title('基于增益的特征重要性')

plt.show()

```

#### 3.2.2 热图

热图是一种可视化特征重要性的另一种方法。它显示了特征之间的相关性,以及它们对模型预测的影响。

```python

import seaborn as sns

# 创建热图

corr = X.corr()

sns.heatmap(corr, annot=True)

plt.title('特征相关性热图')

plt.show()

```

# 4.1 特征选择和降维

### 4.1.1 过滤法

过滤法是一种基于统计度量(如信息增益、卡方检验)对特征进行排序和选择的方法。它通过计算每个特征与目标变量之间的相关性或依赖性,将特征从高到低进行排序。然后,根据预定义的阈值或特征数量,选择最重要的特征。

**优点:**

* 计算效率高,适用于大数据集。

* 可以快速识别与目标变量无关的无关特征。

**缺点:**

* 依赖于统计度量,可能无法捕获特征之间的复杂交互。

* 可能错过一些对模型性能有贡献的特征。

**代码示例:**

```python

import pandas as pd

from sklearn.feature_selection import SelectKBest, chi2

# 加载数据

df = pd.read_csv('data.csv')

# 使用卡方检验选择前 10 个特征

selector = SelectKBest(chi2, k=10)

selector.fit(df.drop('target', axis=1), df['target'])

# 获取选择的特征

selected_features = df.columns[selector.get_support()]

```

### 4.1.2 包裹法

包裹法是一种更全面的特征选择方法,它考虑特征之间的交互和协同作用。它通过迭代地评估特征组合的性能,选择最佳的特征子集。

**优点:**

* 可以捕获特征之间的复杂交互。

* 可以找到最优的特征子集,提高模型性能。

**缺点:**

* 计算成本高,不适用于大数据集。

* 可能陷入局部最优解。

**代码示例:**

```python

import pandas as pd

from sklearn.feature_selection import RFE, RFECV

# 加载数据

df = pd.read_csv('data.csv')

# 使用递归特征消除(RFE)选择特征

selector = RFE(estimator=RandomForestClassifier(), n_features_to_select=10)

selector.fit(df.drop('target', axis=1), df['target'])

# 获取选择的特征

selected_features = df.columns[selector.get_support()]

```

# 5. 案例研究

### 5.1 房价预测

**5.1.1 数据预处理**

房价预测是一个经典的回归问题。我们使用加州房屋销售数据集,其中包含 20,000 多个样本,每个样本都有 80 多个特征。

为了准备数据,我们执行以下步骤:

- **缺失值处理:**使用中位数填充缺失值。

- **数据标准化:**使用标准缩放器将所有特征标准化为均值为 0、标准差为 1。

- **特征选择:**使用 XGBoost 内置的特征重要性函数选择前 20 个重要特征。

### 5.1.2 模型训练和评估

我们使用 XGBoost 训练回归模型,使用以下超参数:

```python

import xgboost as xgb

# 创建 XGBoost 回归模型

model = xgb.XGBRegressor(

n_estimators=100, # 树的数量

max_depth=6, # 树的最大深度

learning_rate=0.1, # 学习率

reg_alpha=1, # L1 正则化系数

reg_lambda=1, # L2 正则化系数

)

# 训练模型

model.fit(X_train, y_train)

```

为了评估模型的性能,我们使用均方根误差 (RMSE) 和平均绝对误差 (MAE) 作为度量标准:

```python

# 评估模型

y_pred = model.predict(X_test)

rmse = np.sqrt(mean_squared_error(y_test, y_pred))

mae = mean_absolute_error(y_test, y_pred)

print("RMSE:", rmse)

print("MAE:", mae)

```

### 5.2 客户流失预测

**5.2.1 数据预处理**

客户流失预测是一个二分类问题。我们使用银行客户流失数据集,其中包含 10,000 多个样本,每个样本都有 10 个特征。

为了准备数据,我们执行以下步骤:

- **缺失值处理:**使用众数填充缺失值。

- **数据二值化:**将目标变量 (客户是否流失) 转换为 0 (未流失) 和 1 (已流失)。

- **特征选择:**使用 XGBoost 内置的特征重要性函数选择前 10 个重要特征。

### 5.2.2 模型训练和评估

我们使用 XGBoost 训练分类模型,使用以下超参数:

```python

import xgboost as xgb

# 创建 XGBoost 分类模型

model = xgb.XGBClassifier(

n_estimators=100, # 树的数量

max_depth=6, # 树的最大深度

learning_rate=0.1, # 学习率

reg_alpha=1, # L1 正则化系数

reg_lambda=1, # L2 正则化系数

)

# 训练模型

model.fit(X_train, y_train)

```

为了评估模型的性能,我们使用准确率、召回率和 F1 分数作为度量标准:

```python

# 评估模型

y_pred = model.predict(X_test)

accuracy = accuracy_score(y_test, y_pred)

recall = recall_score(y_test, y_pred)

f1 = f1_score(y_test, y_pred)

print("Accuracy:", accuracy)

print("Recall:", recall)

print("F1:", f1)

```

# 6. 总结与展望

XGBoost的特征重要性分析在机器学习中发挥着至关重要的作用,它可以帮助我们深入了解模型的内部机制,识别关键特征,并优化模型性能。

通过使用XGBoost内置函数或第三方库,我们可以轻松提取特征重要性。这些度量基于增益或惩罚,并提供了对特征相对重要性的定量评估。

可视化特征重要性有助于我们直观地理解特征的影响。条形图和热图是常见的可视化方法,可以快速识别最重要的特征。

为了提升模型性能,我们可以使用特征选择和降维技术来减少特征数量,同时保留最重要的信息。特征工程和转换,如离散化和归一化,还可以改善特征的质量和模型的鲁棒性。

随着机器学习领域的不断发展,XGBoost的特征重要性分析技术也在不断进步。未来,我们可能会看到新的度量、可视化方法和优化策略的出现,进一步增强我们对模型的理解和优化能力。

通过持续探索和创新,XGBoost的特征重要性分析将继续成为机器学习实践中不可或缺的工具,帮助我们构建更准确、更可解释的模型。

0

0