【深度学习生成对抗网络全解】:GAN原理与实战技巧

发布时间: 2024-09-03 10:19:17 阅读量: 119 订阅数: 59

GAN;深度学习 生成对抗网络 机器学习 神经网络

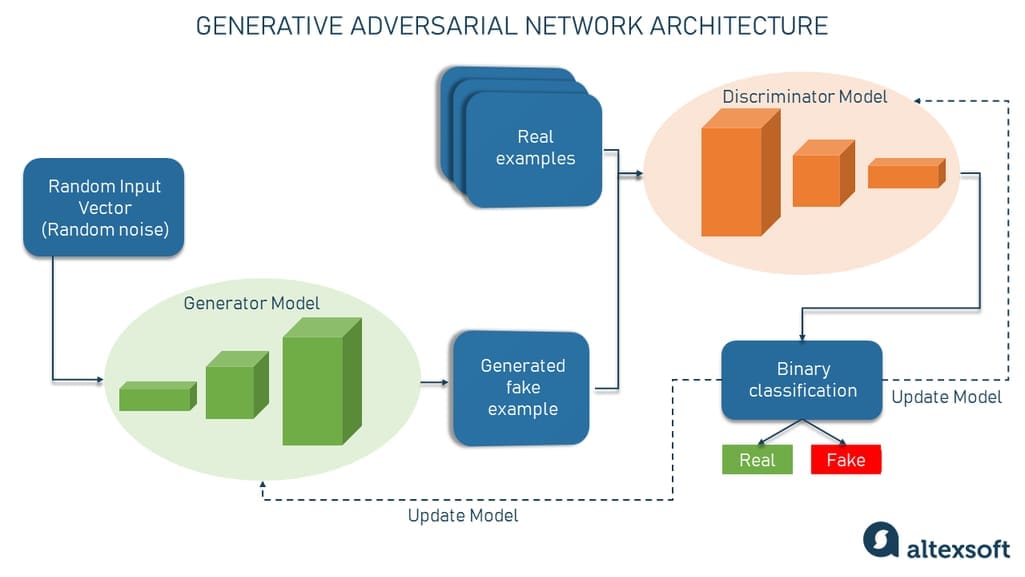

# 1. 生成对抗网络的基本概念

生成对抗网络(GAN)是深度学习领域的一个突破性技术,由Ian Goodfellow在2014年提出。GAN由两个神经网络组成:生成器(Generator)和判别器(Discriminator),它们相互竞争,推动对方性能的提升。生成器的任务是创造尽可能接近真实的数据分布,而判别器则要尽可能准确地区分出真实数据和生成器产生的数据。这种对抗机制使得GAN能够生成高质量和真实感的数据样本,例如图片、音频和视频等。

GAN的应用场景广泛,可以用于图像合成、图像修复、风格转换、数据增强等。其背后的原理是通过不断迭代学习,使得生成的数据越来越难以被判别器识别为假的。这一过程需要复杂的数学建模和深度学习技术,对计算资源和专业知识都有一定的要求。

在本章中,我们将深入探讨GAN的基本工作原理,并对生成器和判别器的角色进行详细阐述,从而为理解后续章节的更高级内容奠定基础。

# 2. 生成对抗网络的数学原理

### 2.1 概率分布与生成模型

#### 2.1.1 概率分布基础

概率分布是理解生成对抗网络(GAN)核心原理的基石。在统计学和机器学习中,概率分布用来描述一个或多个随机变量可能的所有取值及其发生的概率。对于生成模型来说,了解输入数据的概率分布是至关重要的,因为这将影响模型生成数据的真实性。

例如,高斯分布(正态分布)是一个连续概率分布,在许多自然现象和社会现象中都可以观察到。然而,现实世界的数据通常呈现复杂分布,如偏态分布或多峰分布,此时需要更复杂的模型来捕捉其特征。

在GAN的训练过程中,生成器(G)需要学习真实数据的概率分布,并生成接近真实分布的数据。判别器(D)则评估数据来源于真实数据集还是生成器,从而为生成器提供反馈。

```python

import numpy as np

# 示例:生成服从高斯分布的数据集

data = np.random.normal(0, 1, 1000) # 生成1000个服从标准正态分布的样本

```

在上述代码中,我们使用NumPy库生成了服从标准正态分布的数据。这仅为一个基础示例,现实中的生成模型需要学习更复杂的分布。

#### 2.1.2 生成模型的理论框架

生成模型的目标是学习一个能够生成新数据的模型,这些数据与训练数据集具有相同分布。生成模型的理论框架包括但不限于以下几种:

- 变分自编码器(VAE):通过编码器将数据映射到隐空间,再通过解码器从隐空间生成数据。

- 自回归模型:逐个预测数据点,通常用于序列生成。

- 流模型:通过一系列可逆变换从简单分布映射到复杂分布。

在GAN中,生成模型是通过对抗的方式训练得到的。生成器不断尝试生成越来越真实的数据,以欺骗判别器;而判别器则努力区分出真实和生成的数据。这种动态对抗过程推动生成器逐渐逼近真实数据分布。

### 2.2 卷积神经网络与GAN

#### 2.2.1 卷积神经网络简介

卷积神经网络(CNN)是一种专门处理具有类似网格结构的数据的深度学习模型,例如,图像数据就是一种典型的二维网格结构。CNN通过卷积层自动和适应性地学习空间层级特征。

其核心组件包括卷积层、池化层、激活函数等。卷积层负责提取局部特征,池化层则用来降低数据的维度和增强模型对输入变化的鲁棒性。CNN在视觉任务中取得了巨大成功,这也是为什么CNN成为GAN中生成器和判别器的首选架构。

```python

from keras.layers import Conv2D

# 示例:创建一个卷积层

conv_layer = Conv2D(filters=32, kernel_size=(3, 3), activation='relu')

```

以上代码段创建了一个具有32个3x3滤波器的卷积层,并使用ReLU作为激活函数。在GAN中,生成器和判别器都可能使用卷积层来处理图像数据。

#### 2.2.2 卷积神经网络在GAN中的应用

在GAN中,卷积神经网络的应用非常广泛。生成器使用卷积层来合成图像,而判别器则利用卷积层来区分真伪图像。CNN的层级结构和参数共享机制使得模型可以学习到从低级到高级的特征表示,这对于处理高维数据尤为重要。

例如,生成器可能先通过上采样层逐渐放大图像尺寸,然后通过卷积层逐渐增强图像的细节。判别器则采用下采样层来减少图像尺寸并提取关键特征,以判别图像的真伪。

```python

from keras.models import Sequential

from keras.layers import Conv2D, UpSampling2D

# 构建一个简单的GAN生成器模型

generator_model = Sequential()

generator_model.add(UpSampling2D(size=(2, 2)))

generator_model.add(Conv2D(64, (5, 5), activation='relu'))

```

这段代码使用了Keras框架构建了一个简单的生成器模型,其中包含了上采样层和卷积层。上采样层用于放大图像,而卷积层用于增强图像细节。

### 2.3 GAN的损失函数与优化

#### 2.3.1 损失函数的构建与意义

损失函数是衡量模型性能的关键指标,GAN中的损失函数通常包含两部分:生成器的损失和判别器的损失。生成器的损失函数通常设计为判别器错误分类的概率,而判别器的损失函数则是交叉熵损失,用于区分真实和生成的数据。

例如,在原始GAN中,损失函数通常是这样的:

- 生成器损失:`min_G -log(D(G(z)))`

- 判别器损失:`min_D -log(D(x)) - log(1 - D(G(z)))`

其中,`D(x)`是判别器对真实数据的评分,`D(G(z))`是判别器对生成数据的评分,`G(z)`是生成器生成的数据。

```python

import keras.backend as K

# 定义GAN的损失函数

def gan_loss(y_true, y_pred):

return K.mean(-K.log(y_pred)) # 用于判别器的损失函数,即交叉熵损失函数

```

在上述代码中,我们定义了一个简单的损失函数,这通常是在构建GAN模型时使用的。

#### 2.3.2 优化算法的选择与应用

GAN的训练是一个动态对抗的过程,因此优化算法的选择也十分关键。传统的梯度下降算法可能不适用于这种动态变化的环境。因此,研究人员开发了多种算法来稳定GAN的训练过程,例如:

- 梯度惩罚(Wasserstein GAN)

- 二阶优化方法

- 一致性正则化

这些方法通过限制梯度更新、增加额外的约束条件或者利用二阶导数信息等,来优化GAN训练过程的稳定性。

```python

from keras.optimizers import Adam

# 定义优化器,使用Adam算法

optimizer = Adam(lr=0.0002, beta_1=0.5)

```

在上述代码中,我们使用了Keras框架中的Adam优化器,并设置了较低的学习率和β1参数,以减缓训练过程中的梯度消失问题,有助于提升训练的稳定性。

接下来的章节将继续深入GAN的实战技巧,如数据预处理与增强、训练技巧与稳定性提升、模型评估与调优等,这些内容对于构建和优化一个实用的GAN模型至关重要。

# 3. 生成对抗网络的实战技巧

在本章中,我们将深入探讨生成对抗网络(GAN)的实战应用,涵盖从数据预处理到模型调优的各个方面。我们将分析如何高效地准备数据集、优化GAN的训练过程以及如何评估和改进模型性能。本章旨在为那些希望在实际项目中应用GAN技术的读者提供实用的指导和建议。

## 3.1 数据预处理与增强

数据是深度学习模型训练的关键,GAN也不例外。在开始训练之前,对数据进行适当的预处理和增强至关重要,以确保模型能够

0

0