【深度学习模型压缩手册】:轻量化模型的必备技术

发布时间: 2024-09-03 09:44:11 阅读量: 140 订阅数: 56

# 1. 深度学习模型压缩概述

## 深度学习模型压缩的必要性

在深度学习领域,大型复杂模型如卷积神经网络(CNN)和循环神经网络(RNN)常常因为其高效的性能而在众多任务中占据着主导地位。然而,随着模型参数的增多,计算需求也随之增加,导致部署在计算能力有限的设备上变得不切实际。深度学习模型压缩因此应运而生,旨在降低模型大小,减少计算需求,加快推理速度,同时尽可能保持模型性能。

## 面临的技术挑战

尽管模型压缩的好处显而易见,但实现这一点绝非易事。技术挑战包括但不限于:

- **保持性能**:在压缩过程中保持模型的预测性能,尤其是在减少参数和计算量时。

- **普适性**:开发可以广泛应用于不同类型网络结构的压缩方法。

- **兼容性**:确保压缩后的模型能够在多种硬件和软件平台上无缝运行。

## 模型压缩的性能评估指标

评估压缩效果的标准主要围绕以下两个方面:

- **精度与速度的权衡**:模型压缩后在保证精确度的同时实现更高的推理速度。

- **模型大小与资源消耗**:压缩后模型的存储空间和运行时所需的内存、能源等资源。

深度学习模型压缩既是一个技术挑战,又是一个不断发展的研究领域。接下来的章节将深入探讨模型压缩的各种方法和实践案例。

# 2. 深度学习模型压缩的理论基础

深度学习模型压缩是当前AI领域研究的热点之一,其核心目标在于减少模型大小、加速计算过程,同时尽可能保持模型的性能。在本章节中,我们将深入探讨模型压缩的动机与挑战,概述模型压缩的主要技术类型,并阐述性能评估的关键指标。

## 2.1 模型压缩的动机与挑战

### 2.1.1 模型压缩的必要性

随着深度学习技术的飞速发展,模型的复杂度日益增加,随之而来的是模型参数数量的剧增。这不仅导致了巨大的存储需求,也增加了计算负担,尤其是在资源受限的场景如移动设备、边缘计算等。为了适应这些应用场景,模型压缩应运而生。

为了说明模型压缩的必要性,我们可以列举几个关键点:

- **资源限制**:移动设备和边缘设备通常拥有有限的存储空间和计算能力,无法处理大规模深度学习模型。

- **能源效率**:减少模型大小和计算需求可以降低能源消耗,对于延长设备的运行时间至关重要。

- **数据传输**:在云计算环境中,较大的模型需要更多的带宽进行上传和下载,压缩模型可以显著减少所需的数据传输量。

### 2.1.2 面临的技术挑战

模型压缩并非没有挑战,其技术难点主要包括:

- **精度损失**:在压缩模型的同时,保持甚至提高模型的准确度是一大挑战。

- **技术多样性**:模型压缩方法多种多样,如何选择合适的压缩技术并组合应用是一个复杂的问题。

- **可扩展性与泛化性**:压缩后的模型需要能够适应不同的任务和数据集,保持良好的泛化能力。

### 2.1.3 模型压缩的理论基础

模型压缩理论基础涉及数学、机器学习和计算机科学等多个领域。压缩方法大致可以分为三类:参数剪枝、量化和知识蒸馏。

**参数剪枝**主要是识别并去除神经网络中不重要的参数,从而减少模型的复杂度。**量化**旨在用低精度的数值来代替模型中的高精度数值,以减少模型大小和加速推理过程。**知识蒸馏**则是将一个大型、复杂模型的知识转移到一个小型模型中,以训练出一个在性能上接近大型模型的紧凑模型。

## 2.2 模型压缩的主要技术类型

### 2.2.1 权重剪枝和量化

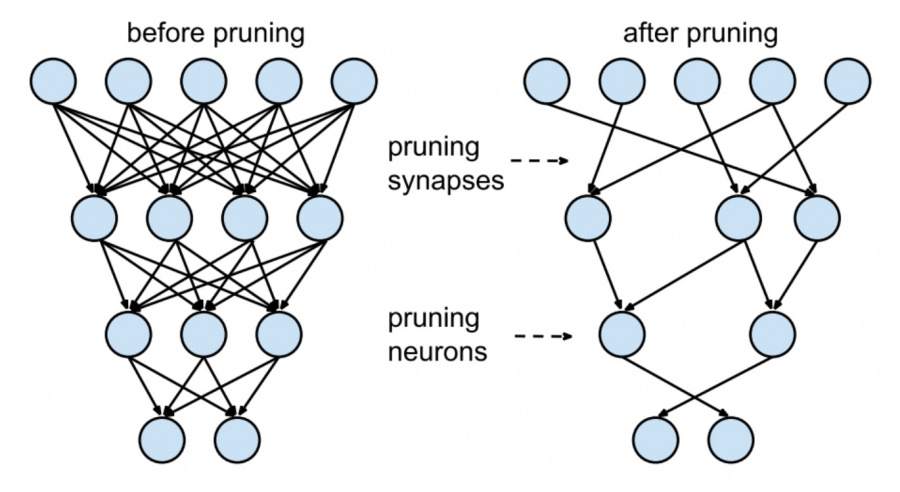

**权重剪枝**通过移除网络中不重要的连接来减少参数数量。这通常分为两种形式:**非结构化剪枝**,随机去除网络中的任意权重;和**结构化剪枝**,在特定结构(如整个卷积核)的基础上进行剪枝。

**量化**是一种将模型中的参数和激活从32位浮点数降低到更低位精度表示的方法。这包括了多种策略,如后训练量化(Post-Training Quantization)、量化感知训练(Quantization-Aware Training)等。

### 2.2.2 知识蒸馏

知识蒸馏是一种转移学习策略,通过训练一个小型网络来模仿一个大型网络的行为。在蒸馏过程中,不仅注重模型输出的最终预测结果,而且还关注大型网络输出的软标签(soft targets),即其对不同类别的预测概率。

### 2.2.3 低秩分解

**低秩分解**是一种数学方法,将大型参数矩阵分解为若干个较小矩阵的乘积,以实现参数矩阵的压缩。这种方法通过提取参数矩阵的主要成分来减少模型的复杂度,同时也能够加速模型的推理过程。

## 2.3 模型压缩的性能评估指标

### 2.3.1 精度与速度的权衡

在模型压缩过程中,一个重要的衡量标准是模型的准确性和速度之间的权衡。在某些情况下,为了获得更快的推理速度或更小的模型大小,可能会牺牲一部分精度。

### 2.3.2 模型大小与资源消耗

评估模型压缩效果的另一个关键指标是模型大小和其运行时所消耗的资源。这些指标直接关系到模型是否能够部署在资源受限的设备上。模型大小越小,存储和传输就越容易;资源消耗越低,运行速度也就越快。

在下一章节中,我们将具体介绍权重剪枝和量化技术的实践,并通过案例和代码示例来展示如何实现这些技术。

# 3. 权重剪枝和量化实践

## 3.1 权重剪枝技术

### 3.1.1 非结构化剪枝方法

非结构化剪枝是指移除神经网络中不规则的权重,这可能会导致稀疏矩阵。此类方法通常不会影响模型架构,因为剪枝发生在权重层面。一个典型的非结构化剪枝流程如下:

1. **确定剪枝比例**:根据期望的压缩率或模型性能,选定要剪枝的权重百分比。

2. **权重排序**:根据权重的绝对值大小排序权重,保留重要的权重,舍去较小的权重。

3. **剪枝**:删除那些绝对值最小的权重。

4. **重训练**:为了恢复由于剪枝造成的精度损失,需要对模型进行微调。

以下是Python代码示例,展示了如何使用PyTorch进行非结构化剪枝:

```python

import torch

import torch.nn.utils.prune as prune

def unstructured_pruning(model, amount):

for name, module in model.named_modules():

if isinstance(module, torch.nn.Linear):

prune.l1_unstructured(module, name='weight', amount=amount)

return model

# 假设有一个已加载好的模型model和需要剪枝的比例amount

pruned_model = unstructured_pruning(model, amount=0.1)

```

该代码会遍历模型中的每一个线性层,并按照给定的比例剪枝权重。

### 3.1.2 结构化剪枝方法

结构化剪枝将权重按照特定的结构来移除,比如移除整个卷积核或者整个隐藏单元,因此可以保持模型的稀疏性且有利于硬件加速。典型的结构化剪枝流程如下:

1. **确定剪枝模式**:选择要剪枝的模式,例如通道剪枝、层剪枝等。

2. **计算重要性分数**:通过评分机制确定哪些权重或通道最不重要。

3. **剪枝决策**:根据评分结果决定剪枝的通道或权重。

4. **调整网络结构**:移除选定的结构部分并调整模型架构。

5. **重训练**:微调模型以适应新的结构。

下面是一个简单的通道剪枝的示例代码:

```python

import torch

import torch.nn as nn

def channel_pruning(model, prune_rate):

for name, module in model.named_modules():

if isinstance(module, nn.Conv2d):

prune_rate = min(prune_rate, module.weight.data.shape[0])

pruned_chs = prune.l1_unstructured(module, name='weight', amount=prune_rate)

module.regi

```

0

0