【深度学习注意力机制揭秘】:注意力技术的核心应用

发布时间: 2024-09-03 10:02:46 阅读量: 110 订阅数: 59

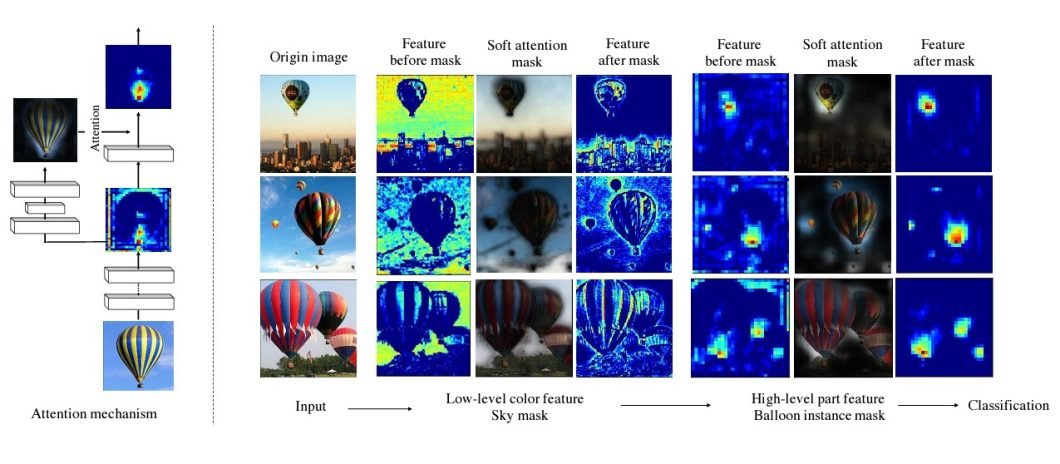

图像识别中的注意力机制:深度解析与代码实现

# 1. 注意力机制的起源与原理

注意力机制,最初受人类视觉注意力的启发,是一种能够使计算机系统在处理大量信息时,模拟人类集中注意力于重要信息部分的机制。它允许模型在每个时间点或空间位置动态地选择关注输入数据的不同部分,从而提高性能和处理效率。

## 1.1 注意力机制的起源

从心理学的角度来看,注意力机制类似于人类在处理视觉或听觉信息时的选择性注意,即人们往往会将注意力集中在一些关键信息上,忽略无关干扰。20世纪90年代,注意力模型首次被引入机器学习领域,用于序列到序列的任务中,尤其是在机器翻译中,它大大提高了翻译的准确性。

## 1.2 注意力机制的基本原理

注意力机制的原理核心在于“权重分配”,它通过为输入序列中的每个元素赋予一个权重,来决定各部分的重要性。这样,模型就可以在计算后续任务时聚焦于这些关键信息。从技术实现角度来看,这些权重可以通过不同的方式来计算,如基于点积或加性方式,而在后续的发展中,各种复杂的注意力模型被设计出来以提升模型性能。

# 2. 注意力机制在深度学习中的实现

深度学习的突破在很大程度上归功于模型对序列数据的处理能力,其中注意力机制(Attention Mechanism)扮演了至关重要的角色。它使得模型可以动态地聚焦于输入数据的不同部分,从而提升了对复杂数据模式的捕捉和处理能力。本章将深入探讨注意力机制在深度学习中的各种实现方式。

## 2.1 基于权重的注意力模型

在深度学习的语境下,基于权重的注意力模型是一种常见的实现方式。它通过计算一个注意力分布来对输入序列的不同部分赋予不同的关注权重。

### 2.1.1 点积注意力和缩放点积注意力

点积注意力是最早期的实现方式之一,它通过点积计算query和key之间的相似度,进而得到权重分布。

```python

def dot_product_attention(query, key, value, mask=None, dropout=None):

d_k = query.size(-1)

scores = torch.matmul(query, key.transpose(-2, -1)) / math.sqrt(d_k)

if mask is not None:

scores = scores.masked_fill(mask == 0, -1e9)

p_attn = F.softmax(scores, dim=-1)

if dropout is not None:

p_attn = dropout(p_attn)

return torch.matmul(p_attn, value), p_attn

```

在这段代码中,首先进行query和key的点积计算,然后通过缩放因子`sqrt(d_k)`来避免点积过于集中于某些值。接着应用softmax函数计算出权重分布,最后将这个权重应用于value上。如果提供了mask,则会掩蔽掉不需要关注的部分。

### 2.1.2 多头注意力机制

多头注意力机制允许模型在不同的表示子空间学习信息,有助于模型捕捉序列中不同位置的不同类型的信息。

```python

class MultiHeadedAttention(nn.Module):

def __init__(self, h, d_model, dropout=0.1):

super(MultiHeadedAttention, self).__init__()

assert d_model % h == 0

self.d_k = d_model // h

self.h = h

self.linear_layers = clones(nn.Linear(d_model, d_model), 3)

self.output_linear = nn.Linear(d_model, d_model)

self.dropout = nn.Dropout(p=dropout)

def forward(self, query, key, value, mask=None):

batch_size = query.size(0)

query, key, value = [l(x).view(batch_size, -1, self.h, self.d_k).transpose(1, 2)

for l, x in zip(self.linear_layers, (query, key, value))]

x, attn = attention(query, key, value, mask=mask, dropout=self.dropout)

x = x.transpose(1, 2).contiguous().view(batch_size, -1, self.h * self.d_k)

return self.output_linear(x)

```

这段代码展示了多头注意力机制的实现,其中包括了几个线性层将输入数据映射到不同的子空间,并在每个子空间中计算注意力。之后,将各子空间的输出拼接起来并最终通过一个输出线性层。

## 2.2 自注意力机制

自注意力(Self-Attention)机制,也被称作内部注意力,允许在序列的各个位置之间直接建立联系,从而赋予模型更强大的表达能力。

### 2.2.1 自注意力的基本概念

自注意力通过计算序列内部各元素之间的关系,赋予每个元素一个加权表示,以此来捕捉长距离依赖关系。

### 2.2.2 自注意力在Transformer模型中的应用

Transformer模型是一个依赖于自注意力机制的模型,它在NLP领域取得了巨大的成功,尤其是在机器翻译任务中。

```python

class TransformerBlock(nn.Module):

def __init__(self, hidden, attn_heads, dropout):

super(TransformerBlock, self).__init__()

self.attention = MultiHeadedAttention(h=attn_heads, d_model=hidden)

self.norm1 = Norm(hidden)

self.norm2 = Norm(hidden)

self.feed_forward = PositionwiseFeedForward(hidden, dropout=dropout)

self.dropout = nn.Dropout(dropout)

def forward(self, x, mask):

attended = self.attention(x, x, x, mask=mask)

x = self.dropout(self.norm1(attended + x))

forwarded = self.feed_forward(x)

return self.dropout(self.norm2(forwarded + x))

```

在这个例子中,Transformer模型的一个基础块由自注意力和位置前馈网络构成,并且加入了归一化层和dropout来防止过拟合。自注意力部分用于学习序列内部的复杂关系,而位置前馈网络则提供了非线性变换。

## 2.3 注意力机制的正则化和优化

为了提高注意力模型的泛化能力,引入正则化技术以及优化策略是至关重要的。

### 2.3.1 注意力权重的正则化方法

正则化方法有助于防止过拟合,常见的技术包括权重衰减、dropout以及早停等。

### 2.3.2 注意力模型的训练技巧和优化策略

对于注意力模型的训练,一些特定的策略如学习率预热(learning rate warm-up)和梯度累积(gradient accumulation)等,可以进一步提升训练效率和模型性能。

```python

class AttentionModelTrainer:

def __init__(self, model, optimizer, criterion, scheduler=None):

self.model = model

self.optimizer = optimizer

self.criterion = criterion

self.scheduler = scheduler

def train(self, data_loader, epochs, device):

for epoch in range(epochs):

self.model.train()

for batch in data_loader:

self.optimizer.zero_grad()

input_ids = batch['input_ids'].to(device)

attention_mask = batch['attention_mask'].to(device)

labels = batch['labels'].to(device)

outputs = self.model(input_ids, attention_mask=attention_mask, labels=labels)

loss = outputs.loss

loss.backward()

```

0

0