【注意力机制】:提升CNN模型性能的前沿技术

发布时间: 2024-09-03 07:23:10 阅读量: 45 订阅数: 31

# 1. 注意力机制的理论基础

在深度学习中,注意力机制已经被广泛地研究和应用,尤其是在图像识别、自然语言处理、强化学习等领域。注意力机制的核心思想是模仿人类视觉注意力系统,即能够对场景中的重要部分给予更多的关注,而忽略不重要的细节。这与人类视觉处理过程类似,我们通常不会对所有看到的信息都给予相同的注意力,而是会根据当前的任务和环境,有选择性地集中注意力。

## 2.1 注意力机制的基本原理

### 2.1.1 注意力机制的起源和定义

注意力机制的起源可以追溯到2015年,当时的一篇论文提出了"注意力是你要的一切"(Attention Is All You Need)的概念。该论文介绍了一种新型的神经网络架构,称为Transformer,其主要的创新在于摒弃了传统的循环神经网络(RNN)和卷积神经网络(CNN)中的序列处理方式,转而使用了一种称为"自注意力"(self-attention)的机制,从而引发了后续一系列关于注意力机制的研究和应用。

### 2.1.2 注意力机制的核心组成

注意力机制的核心组成通常包括三个部分:查询(Query)、键(Key)和值(Value)。在自注意力模型中,输入的序列或数据会被转换为这三种类型的向量,然后计算查询向量与键向量之间的相似度(或称为分数),这些分数将决定每个值向量对输出的贡献。通过这种方式,网络能够动态地聚焦于输入数据的相关部分。

通过注意力机制,模型可以对信息进行加权,使得重要的部分被强化,不那么重要的部分则被弱化。在机器学习任务中,这种能力使模型能够更精准地捕捉到关键特征,提高性能。在后续的章节中,我们将探讨注意力机制如何在卷积神经网络(CNN)中得到应用,并进一步探讨它的实际应用和性能优化。

# 2. 注意力机制在CNN中的应用

### 2.1 注意力机制的基本原理

#### 2.1.1 注意力机制的起源和定义

注意力机制(Attention Mechanism)最初源自于心理学领域,用于描述人类在处理复杂信息时,对某些关键信息给予更多关注的现象。在机器学习领域,特别是深度学习中,注意力机制是一种模仿人类注意力集中机制的技术,能够使模型在处理信息时能够“集中注意力”于输入数据的关键部分。

在深度学习的背景下,注意力机制通过赋予不同的输入数据不同的权重,从而提升模型对于关键信息的处理能力,它已成为改善序列模型和视觉模型性能的关键技术。在卷积神经网络(CNN)中,注意力机制尤其在图像识别、目标检测和图像分割等领域中得到了广泛的应用。

#### 2.1.2 注意力机制的核心组成

注意力机制的核心由三个关键部分组成:**查询(Query)**、**键(Key)**和**值(Value)**。这三者在注意力机制中的操作如下:

- **查询(Query)**:这是模型当前任务想要关注的信息。

- **键(Key)**:与查询相关联的一系列信息,模型通过比较查询和键来确定注意力分配。

- **值(Value)**:包含实际信息的部分,值是被注意力机制调整权重后的输出结果。

在实际的网络模型中,查询、键和值可以通过不同的方式获得,它们可以是输入特征的不同表示,也可以是通过一些变换后的版本。注意力权重是通过查询和键的相似度(一般为点积)来计算的,然后这个权重被应用于值上,以产生加权和作为最终的输出。

### 2.2 注意力机制与CNN结合的演进

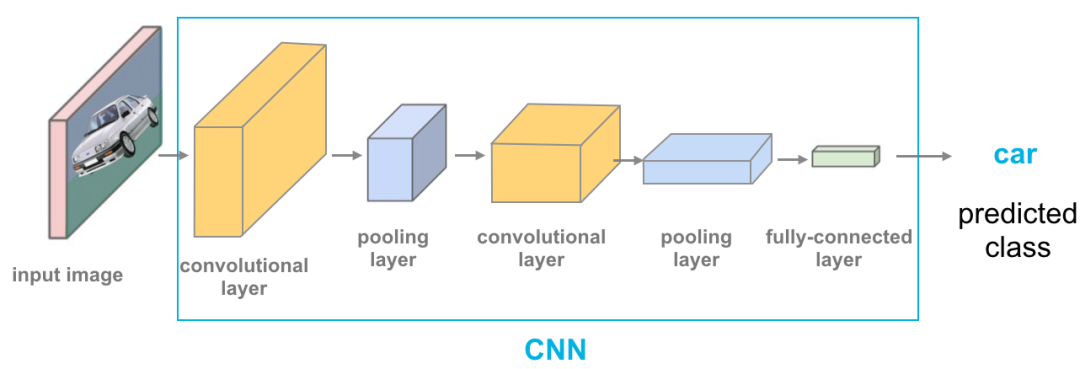

#### 2.2.1 传统CNN模型的局限性

传统的CNN模型虽然在图像处理领域取得了巨大成功,但其存在一定的局限性。例如,在处理大尺寸图像时,传统CNN通常依赖于多个卷积层来逐步提取特征,这会导致模型在识别和理解图像局部细节方面的能力受到限制。此外,传统的CNN在捕获全局依赖关系方面也存在不足,例如在图像分类任务中,模型可能未能充分考虑到图像全局的上下文信息。

#### 2.2.2 注意力机制在CNN中的具体实现

将注意力机制引入CNN模型,可以有效地缓解上述局限性。注意力模块使得网络在处理图像时可以动态地聚焦于最重要的区域,无论这些区域在空间上是连续的还是分散的。常见的实现方式有:

- **空间注意力**(Spatial Attention):空间注意力关注图像的局部区域,赋予模型在空间维度上的选择能力。

- **通道注意力**(Channel Attention):通道注意力关注不同通道上的特征,使得模型能更好地捕捉到重要特征通道。

在实现这些注意力模块时,常常会涉及到一些复杂的网络结构和参数计算,例如通过一个小型的多层感知器(MLP)来学习查询、键和值之间的关系,再应用到CNN的特征图上。

#### 2.2.3 注意力模块的设计和集成

设计注意力模块时,需要考虑的关键因素包括:

- **模块位置**:注意力模块可以置于CNN的不同层级,如在卷积层的输出端或中间层。

- **模块结构**:注意力模块的结构设计影响其能否有效地提取和利用特征。

- **集成方式**:如何将注意力模块和原有的CNN结构无缝集成,使得整个模型性能得到提升。

注意力模块的设计和集成策略往往依赖于具体任务的需求。例如,在图像分类任务中,注意力模块可能被用来突出图像中最重要的区域;而在图像分割任务中,注意力模块的集成目标可能是提高模型对于细粒度特征的学习能力。

在下一章节中,我们将具体介绍如何构建一个带有注意力机制的CNN模型,并展示在实际数据集上的应用过程。通过对比不同注意力模块的设计,我们可以更深入地理解它们对模型性能的影响。

# 3. 实践案例分析:注意力CNN模型的构建

## 3.1 数据准备与预处理

### 3.1.1 数据集的选择与下载

在构建注意力卷积神经网络(Attention-CNN)模型之前,选择合适的数据集是至关重要的一步。这通常取决于任务的性质。例如,在图像识别任务中,常用的公开数据集有CIFAR-10、ImageNet、MNIST等。这些数据集包含丰富的标注信息和多样的样本类别,适合用于训练和测试。

以CIFAR-10数据集为例,它由60000张32x32像素的彩色图像组成,分为10个类别,每个类别有6000张图像。数据集的获取通常通过库函数直接下载。以下是使用Python语言下载CIFAR-10数据集的示例代码:

```python

from keras.datasets import cifar10

(x_train, y_train), (x_test, y_test) = cifar10.load_data()

```

代码解释:

- `cifar10.load_data()`函数会从Keras的内部存储中下载CIFAR-10数据集,并自动完成训练集和测试集的划分。

### 3.1.2 数据增强与归一化处理

数据增强是一种通过应用一系列随机变换来增加数据多样性的技术,能够提高模型的泛化能力。常见的数据增强方法包括旋转、缩放、裁剪、水平翻转等。归一化处理则是为了减少输入数据范围对模型训练的影响,通常将数据值缩放到[0, 1]或[-1, 1]区间内。

以下是一个使用Keras进行数据增强和归一化的代码示例:

```python

from keras.preprocessing.image import ImageDataGenerator

# 定义数据增强生成器

datagen = ImageDataGenerator(

rotation_range=15, # 随机旋转的角度范围

width_shift_range=0.1, # 随机水平位移范围

height_shift_range=0.1, # 随机垂直位移范围

horizontal_flip=True, # 随机水平翻转

fill_mode='nearest' # 填充新创建像素的方法

)

# 计算训练数据的均值和标准差,用于归一化

mean = np.mean(x_train, axis=(0, 1, 2))

std = np.std(x_train, axis=(0, 1, 2))

# 归一化预处理函数

def normalize(x, mean, std):

return (x - mean) / std

x_train = normalize(x_train, mean, std)

x_test = normalize(x_test, mean, std)

```

代码逻辑解释:

- `ImageDataGenerator`类用于定义数据增强的方法和参数。

- `normalize`函数将数据集的像素值通过减去均值并除以标准差,从而进行归一化处理。

## 3.2 注意力CNN模型的搭建

### 3.2.1 模型架构的设计思路

注意力CNN模型的设计需要在传统的CNN架构中集成注意力机制。设计思路通常包括以下几个方面:

1. **选择基础网络结构**:首先确定基础的CNN模型,例如ResNet、VGG、Inception等。

2. **集成注意力模块**:然后在基础模型的适当层次中加入注意力模块。这可能是在卷积层之后或者整个网络的某个中间层。

3. **构建注意力模块**:注意力模块的设计需要能够捕捉长距离依赖和增强关键信息的表示,常用的模块有SENet中的Squeeze-and-Excitation模块或CBAM中的通道和空间注意力模块。

4. **考虑模型效率**:注意力机制可能会带来额外的计算负担,设计时需要考虑如何平衡性能和计算效率。

### 3.2.2 注意力模块的编程实现

在模型构建中,我们可以通过自定义层或使用现有的深度学习框架实现注意力模块。下面是一个使用Keras构建SENet中的SE模块的示例代码:

```python

from keras.layers import GlobalAveragePooling2D, Reshape, Dense, multiply

from keras.models import Model

def squeeze_excite_block(input, ratio=16):

init = input

# Squeeze阶段:全局平均池化

filters = init.shape[-1]

se_shape = (1, 1, filters)

se = GlobalAveragePooling2D()(init)

se = Reshape(se_shape)(se)

# Excitation阶段:两个全连接层

se = Dense(filters // ratio, activation='relu', kernel_initializer='

```

0

0