【数据清洗艺术大揭秘】:机器学习预处理的实用技巧

发布时间: 2024-09-02 19:29:13 阅读量: 164 订阅数: 43

# 1. 数据清洗的重要性与概念

在数据分析和机器学习项目中,数据是构建一切模型的基础。高质量的数据能够让模型更加精准,提升业务价值。然而,数据在收集过程中往往会受到各种噪声的影响,如缺失值、异常值、格式不统一等,这直接影响数据的质量,进而影响模型的准确性和可靠性。

数据清洗,顾名思义,就是为了提升数据质量而进行的一系列处理。它包括识别并移除数据集中的错误和不一致性,纠正数据的错误,处理缺失值,以及转换数据格式使之更适合分析。正确的数据清洗能提高数据集的完整性,从而提升模型预测的效果。

数据清洗的重要性不言而喻,它不仅能够优化数据的结构,提高数据处理的速度,还能帮助我们发现数据集中的隐藏模式,为数据挖掘提供更准确的输入。因此,数据清洗成为了数据预处理中不可或缺的重要环节。

# 2. 数据预处理基础

## 2.1 数据收集与数据集的构建

### 2.1.1 数据来源与获取方法

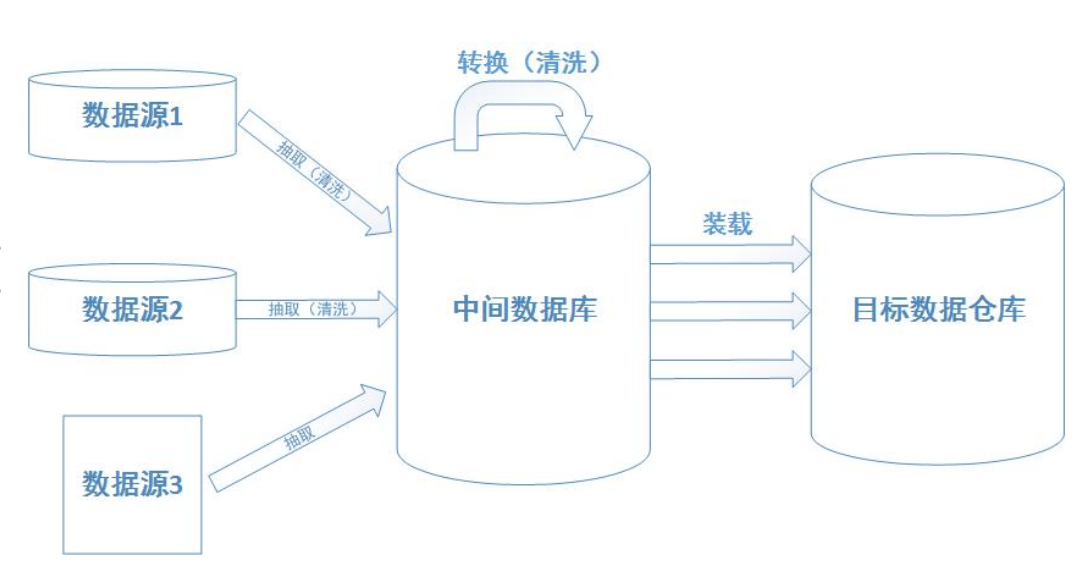

在构建任何数据分析或机器学习模型之前,数据收集是至关重要的第一步。数据来源多样,根据不同的业务需求和分析目的,我们可以从多个渠道获取数据。

- **公开数据集**:互联网上有许多开放数据平台,如Kaggle、UCI Machine Learning Repository,提供各种领域的数据集,适用于快速原型开发和模型训练。

- **网络爬虫**:通过编写网络爬虫程序从网站上抓取数据,这是针对特定需求自定义数据集的有效手段。

- **内部数据**:公司内部存储在数据库中的数据,比如销售记录、用户行为数据等,这些数据由于与业务直接相关,具有很高的实用价值。

- **API服务**:一些在线服务提供API接口,可以直接调用获取数据,例如社交媒体平台、金融数据提供商等。

数据收集之后,需要对数据进行清洗和整理,以构建高质量的数据集。这通常涉及数据转换、格式统一、以及去除重复值等步骤。

### 2.1.2 数据集的划分:训练集、验证集和测试集

数据集构建完成后,我们需要将数据集分割成训练集、验证集和测试集,以便于模型的训练、调参和评估。

- **训练集**:用于模型的学习,通过这部分数据让模型掌握数据的基本特征和模式。

- **验证集**:用于模型的超参数调整和早期停止,以避免过拟合,并选择最优模型结构。

- **测试集**:在模型训练完成之后用来对模型性能进行最终评估的数据集,模型对这部分数据的预测结果能够反映出模型的泛化能力。

```python

from sklearn.model_selection import train_test_split

# 假设X为特征集,y为目标变量

X_train, X_temp, y_train, y_temp = train_test_split(X, y, test_size=0.3, random_state=42)

X_val, X_test, y_val, y_test = train_test_split(X_temp, y_temp, test_size=0.5, random_state=42)

```

以上代码块展示了如何使用`sklearn.model_selection`模块中的`train_test_split`函数划分数据集,其中`test_size=0.3`表示30%的数据用作测试集,`random_state`参数确保了划分的可重复性。

## 2.2 数据清洗的常用方法

### 2.2.1 缺失值处理

在现实世界的数据集中,缺失值是常见问题。处理缺失值的方法有多种,需要根据数据特性和业务需求来选择。

- **删除含有缺失值的记录**:如果数据量大且缺失数据不多,可以考虑直接删除含有缺失值的记录。

- **填充缺失值**:可以使用平均值、中位数、众数或特定值填充缺失值,具体使用哪种方式取决于数据的分布和变量类型。

- **预测模型填充**:使用其他特征预测缺失值,然后用预测的结果填充。

```python

import pandas as pd

from sklearn.impute import SimpleImputer

# 假设df为数据框,其中"Age"列有缺失值

imputer = SimpleImputer(strategy='mean') # 使用均值填充

df['Age'] = imputer.fit_transform(df[['Age']])

```

### 2.2.2 异常值检测与处理

异常值是指那些不符合预期模式的数据点,它们可能是由错误、异常情况或其他不寻常事件引起的。

- **基于统计的方法**:比如计算IQR(四分位距),超出1.5倍IQR范围的点可以被认为是异常值。

- **基于模型的方法**:使用聚类或基于密度的算法来识别异常值。

```python

# 以Z分数方法识别异常值

from scipy import stats

import numpy as np

z_scores = np.abs(stats.zscore(df))

outliers = (z_scores > 3).all(axis=1)

df_cleaned = df[~outliers]

```

### 2.2.3 数据格式化与规范化

为了保证数据质量,数据常常需要进行格式化和规范化,以满足后续处理的需要。

- **数据格式化**:包括日期时间格式化、数字格式化等,确保数据的统一性。

- **数据规范化**:将数据转换到一个标准的格式,例如,所有的数值数据可以标准化到[0,1]区间内。

```python

from sklearn.preprocessing import MinMaxScaler

scaler = MinMaxScaler()

df_scaled = pd.DataFrame(scaler.fit_transform(df), columns=df.columns)

```

## 2.3 数据转换技巧

### 2.3.1 数据编码技术

对于分类变量,通常需要进行编码转换,以供算法处理。常见的编码技术有:

- **独热编码**(One-Hot Encoding):为每一个类别创建一个新的二进制列。

- **标签编码**(Label Encoding):将类别用数值表示。

```python

from sklearn.preprocessing import OneHotEncoder, LabelEncoder

# 独热编码示例

encoder = OneHotEncoder(sparse=False)

one_hot_encoded = encoder.fit_transform(df[['Category']])

df_encoded = pd.DataFrame(one_hot_encoded, columns=encoder.get_feature_names(['Category']))

# 标签编码示例

label_encoder = LabelEncoder()

df['Category'] = label_encoder.fit_transform(df['Category'])

```

### 2.3.2 数据离散化与分箱技术

连续变量往往需要离散化以便于模型处理,常见的方法有:

- **等频分箱**:将数据范围划分为具有相同数量观测值的区间。

- **等宽分箱**:数据范围被划分为具有相同宽度的区间。

```python

# 使用pandas的cut函数实现等宽分箱

df['Age_binned'] = pd.cut(df['Age'], bins=5, labels=False)

```

### 2.3.3 特征提取与构造

特征提取是从原始数据中提取有用信息的过程。通过构造特征可以提升模型性能。

- **自然语言处理中的TF-IDF**:用于文本数据,量化词在文本中的重要性。

- **图像处理中的特征检测**:如SIFT(尺度不变特征变换),用于图像识别。

```python

from sklearn.feature_extraction.text import TfidfVectorizer

# 将文本数据转换为TF-IDF矩阵

tfidf = TfidfVectorizer()

tfidf_matrix = tfidf.fit_transform(df['text'])

```

本章节展示了数据预处理中的核心概念与方法,通过构建合适的数据集以及处理数据中的缺失值、异常值和格式化,为数据建模打下了坚实的基础。接下来的章节将介绍数据预处理在实际应用中的具体实施。

# 3. 数据预处理实践应用

随着数据科学的快速发展,数据预处理已不再是一个简单的准备步骤,它正逐渐成为决定机器学习模型性能的关键环节。在本章节中,我们将深入探讨数据预处理的具体应用,并通过实例展示如何在真实世界项目中实施有效的数据清洗和增强策略。

## 3.1 数据清洗在机器学习中的应用实例

### 3.1.1 面对不同类型数据的清洗策略

在机器学习项目中,数据可能来自不同的源,包括结构化数据(如数据库中的表格数据)和非结构化数据(如文本、图像)。不同类型的数据需要不同的清洗策略。

- **结构化数据清洗**:

结构化数据清洗涉及到对表格数据的处理,如填充缺失值、删除重复记录以及纠正错误等。可以使用诸如Python的`pandas`库或R语言中的数据处理功能来实现。

- **非结构化数据清洗**:

非结构化数据清洗通常需要特定的处理方法。例如,对于文本数据,可能需要执行自然语言处理(NLP)技术来去除无关词汇(停用词)、纠正拼写错误、文本标准化等。对于图像数据,则可能需要进行格式转换、尺寸调整、归一化等操作。

### 3.1.2 清洗流程的编程实现

在实践中,数据清洗的编程实现是至关重要的。以下是一个使用Python和pandas库清洗数据的示例。

```python

import pandas as pd

# 读取数据集

df = pd.read_csv('data.csv')

# 缺失值处理:填充缺失值

df.fillna(df.mean(), inplace=True)

# 异常值处理:删除异常值

df = df[(df['value'] > df['value'].quantile(0.01)) & (df['value'] < df['value'].quantile(0.99))]

# 数据格式化:转换数据类型

df['date'] = pd.to_datetime(df['date'])

# 数据规范化:统一数据格式

df['category'] = df['category'].str.lower().str.strip()

# 输出清洗后的数据集

print(df.head())

```

以上代码展示了如何使用pandas处理常见的数据清洗问题,包括填充缺失值、删除异常值、数据类型转换以及字符串处理等。每一步操作之后,数据的质量得到了显著提升,为后续的数据分析和建模打下了良好的基础。

## 3.2 数据增强技术

### 3.2.1 数据增强的含义与目的

数据增强技术是通过一系列操作来人为地扩展数据集的大小和多样性,从而提高机器学习模型的泛化能力。对于图像和文本数据,数据增强尤为重要。

- **图像数据增强**:

图像数据增强包括旋转、翻转、缩放、裁剪等操作,这可以模拟不同拍摄条件下的图片变化,增加模型的鲁棒性。

- **文本数据增强**:

文本数据增强则可能包括同义词替换、句子重排、插入无关句子等,这样可以增加模型对文本数据多样性的理解能力。

### 3.2.2 不同类型数据的增强方法

- **图像数据增强示例**:

```python

from imgaug import augmenters as iaa

seq = iaa.Sequential([

iaa.Fliplr(0.5), # 水平翻转

iaa.Affine(rotate=(-45, 45)), # 旋转

])

# 对图像应用增强

images_augmented = seq.augment_images(images)

```

- **文本数据增强示例**:

```python

import nltk

from nltk.corpus import wordnet

def synonym_replacement(words, n=1):

words = words.split()

new_words = words.copy()

random = nltk.Random()

random.seed(0)

random.shuffle(new_words)

for _ in range(n):

synonym = False

while not synonym:

synonym = True

word = new_words[random.randint(0, len(new_words)-1)]

synonyms = wordnet.synsets(word)

if len(synonyms) > 0:

synonym = synonyms[0].lemmas()[0].name()

new_words = [ synonym if w == word else w for w in new_words ]

else:

synonym = False

return " ".join(new_words)

text_augmented = synonym_replacement("The cat is very small.")

```

## 3.3 数据预处理工具与库

### 3.3.1 常用数据预处理工具介绍

在数据预处理过程中,有许多工具可以帮助我们提高效率。除了编程语言本身提供的标准库之外,还有一些专门设计的数据处理工具,如`OpenRefine`(用于交互式数据清洗)、`Trifacta Wrangler`等。

### 3.3.2 数据预处理库的使用技巧

在Python中,除了`pandas`之外,还有许多其它优秀的数据预处理库。例如:

- **`NumPy`**:用于高效的数值处理和矩阵操作。

- **`Scikit-learn`**:提供了许多数据转换的工具,如标准化、归一化以及特征选择。

- **`Scikit-image`**:专用于图像处理的库,提供了丰富的图像增强和变换方法。

这些工具和库的正确使用对于实现高效且高质量的数据预处理至关重要。

本章提供了一个完整的数据预处理流程,从清洗到增强,再到使用各类工具和库。通过实例代码和逻辑分析,使读者能够了解如何在实际项目中应用数据预处理技术。下一章,我们将深入探讨更高级的数据清洗技术及其面临的挑战。

# 4. 数据清洗的高级技巧与挑战

## 4.1 高级数据预处理方法

### 4.1.1 降维技术与应用

数据集中的变量(特征)数量可能很多,但并非所有的变量都是对预测或分类任务有用的。降维技术能够在降低计算复杂性的同时,保留数据集的最重要信息。常用的技术有主成分分析(PCA)、线性判别分析(LDA)和 t分布随机邻域嵌入(t-SNE)。

主成分分析(PCA)是一种统计方法,它通过正交变换将一组可能相关的变量转换成一组线性不相关的变量,这些新变量称为主成分。通常,第一主成分具有最大的方差,第二主成分具有次大的方差,以此类推。这样,可以有效地降维,同时保留原始数据集最重要的变化。

在Python中实现PCA可以使用`sklearn.decomposition.PCA`。下面是一个简单的代码示例,展示了如何在数据集上应用PCA:

```python

from sklearn.decomposition import PCA

from sklearn.preprocessing import StandardScaler

import numpy as np

# 假设X是一个已经被清洗过且标准化的特征矩阵

X_std = StandardScaler().fit_transform(X)

# 设置PCA组件数量,这里为了简化举例,假设降维到2维空间

pca = PCA(n_components=2)

X_pca = pca.fit_transform(X_std)

# 查看新特征的解释方差比率

print(pca.explained_variance_ratio_)

```

### 4.1.2 特征选择的方法与评估

特征选择是选择数据集中最相关特征的过程,以提高模型的性能和解释性。特征选择的方法可以分为三种:过滤法(Filter)、包裹法(Wrapper)和嵌入法(Embedded)。

过滤法依赖于数据本身的统计测试来选择特征。它们是快速且独立于模型的选择方法。包裹法基于模型的性能来选择特征子集。最著名的包裹法之一是递归特征消除(RFE)。嵌入法在模型训练过程中结合特征选择,如使用L1正则化的线性模型。

下面是一个使用递归特征消除(RFE)的Python代码示例,展示了如何在支持向量机(SVM)分类器中选择特征:

```python

from sklearn.feature_selection import RFE

from sklearn.svm import SVC

# 创建一个SVC分类器实例

clf = SVC(kernel="linear")

# 使用RFE进行特征选择,选择前3个最重要的特征

rfe = RFE(estimator=clf, n_features_to_select=3, step=1)

rfe.fit(X_train, y_train)

# 输出被选中的特征编号

selected_features = np.where(rfe.support_)[0]

print("被选中的特征编号:", selected_features)

```

### 4.1.3 高级特征工程技术

特征工程技术是通过创造新的特征或者变换现有的特征来增强模型性能的过程。高级特征工程技术包括多项式特征、交互特征和派生特征等。

多项式特征是通过计算现有特征之间的乘积得到的,能够捕捉特征之间的非线性关系。交互特征是特定组合的特征,例如,将`温度`和`湿度`组合成一个新的特征`温度*湿度`。派生特征是根据业务逻辑或领域知识从现有特征派生出来的新特征,例如,将时间戳特征转换成`工作日`或`周末`的二进制特征。

在Python中,`sklearn.preprocessing`模块提供了`PolynomialFeatures`类,可以用来生成多项式和交互特征:

```python

from sklearn.preprocessing import PolynomialFeatures

# 创建一个PolynomialFeatures实例,这里以2阶多项式为例

poly = PolynomialFeatures(degree=2, include_bias=False)

# 假设X是一个已经被清洗过的特征矩阵

X_poly = poly.fit_transform(X)

# 查看生成的多项式特征

print(X_poly)

```

## 4.2 面临的挑战与解决方案

### 4.2.1 大数据环境下的数据清洗策略

在大数据环境下,数据量大、速度高、种类多,数据清洗面临诸多挑战。例如,数据可能包含来自多个源的噪声,数据量大导致传统方法效率低下等。在此背景下,需要采用更为高效的数据清洗策略。

数据流处理技术是应对大数据环境的一个有效解决方案。数据流通常只能被读取一次,因此需要实时或近实时的处理技术。Apache Kafka、Apache Storm和Apache Flink等技术可以用于处理实时数据流。

另一个重要策略是分布式数据清洗技术。使用如Apache Spark这样的分布式计算框架,可以在多个节点上并行处理数据,显著提高数据清洗的效率。

### 4.2.2 数据隐私与数据清洗的关系

数据隐私是指保护数据主体个人信息不被未经授权的访问和披露的原则。数据清洗过程中,处理个人数据时必须遵守相关隐私保护法律和规定。

一个解决方案是使用数据脱敏技术。数据脱敏是通过算法将敏感数据转换成非敏感形式,以确保在清洗过程中保护隐私。在Python中,可以使用`pandas`库和`sklearn.preprocessing`模块来实现简单的脱敏技术。

## 4.3 案例研究:机器学习项目的数据清洗全流程

### 4.3.1 项目背景与目标

为了说明数据清洗的全流程,我们可以考虑一个机器学习项目,该项目的目标是建立一个模型来预测客户是否会购买某个产品。数据集包含多个字段,如客户年龄、性别、购买历史等。

### 4.3.2 数据清洗策略的具体实施

在该项目中,数据清洗策略的实施步骤可能包括以下内容:

1. 数据导入:使用`pandas`库导入数据集。

2. 数据概览:使用`describe()`和`info()`方法快速查看数据的统计信息和字段类型。

3. 缺失值处理:根据字段的含义和重要性选择填充或删除缺失值。

4. 异常值处理:使用描述性统计分析和可视化方法检测和处理异常值。

5. 数据格式化:确保所有数据格式一致,并且符合分析需求。

6. 特征选择和转换:应用PCA或RFE等技术选择最重要的特征,并使用多项式特征来增强模型性能。

### 4.3.3 清洗结果的评估与反馈

在数据清洗完成后,需要评估清洗的效果。这可以通过比较清洗前后模型的性能来进行。如果性能未达到预期,可能需要重新审视清洗策略。通过迭代优化,不断提高数据的质量,最终达到项目目标。

清洗结果的评估通常涉及模型的准确度、精确度、召回率和F1分数等指标。可以通过交叉验证和混淆矩阵等方法进行评估。

通过本案例的研究,我们可以看到数据清洗是机器学习项目中不可或缺的一步,它直接影响到最终模型的性能。在整个数据科学的工作流程中,数据清洗占据了至关重要的地位。

# 5. 数据清洗的未来趋势与展望

随着数据量的激增和机器学习、人工智能技术的发展,数据清洗技术作为数据预处理的关键步骤,其重要性日益凸显。在未来,我们可以预见数据清洗将朝着更加自动化、智能化的方向发展,同时伴随着伦理和标准问题的不断探讨和完善。本章将深入探讨数据清洗的未来趋势,以及这些趋势对行业的深远影响。

## 5.1 自动化与智能化的数据清洗技术

### 5.1.1 机器学习在数据清洗中的应用前景

随着机器学习算法的不断完善,自动化数据清洗已成为可能。机器学习模型可以被训练来识别数据中的模式和异常值,从而自动完成数据清洗任务。例如,异常检测算法可以识别数据集中的异常记录,自动将其标记或删除。未来,我们可以期待更加精细和复杂的模型能够处理更高维度的数据集,同时提供实时的数据清洗功能。

```python

# 示例:使用简单的统计方法检测异常值

import numpy as np

# 假设data是已经收集的数据集

data = np.random.normal(0, 1, 1000)

# 定义一个简单的方法来检测异常值

def detect_outliers(data, threshold=3):

z_scores = np.abs((data - np.mean(data)) / np.std(data))

outliers = np.where(z_scores > threshold)

return data[outliers]

# 检测异常值

outliers = detect_outliers(data)

# 对于更复杂的数据集,可以使用机器学习模型进行异常检测

# 此处省略模型的训练与应用代码

```

### 5.1.2 智能化数据清洗流程的设计理念

智能化数据清洗流程不仅需要自动化,更需要智能化的决策支持。设计这样的流程需要深入理解数据的业务逻辑和清洗的上下文。例如,数据清洗流程可以内置规则库,根据业务规则自动推荐清洗策略。此外,智能化流程还应该能够学习和适应新的数据模式,通过持续学习不断完善其性能。

```mermaid

graph LR

A[开始] --> B[数据接入]

B --> C[数据概览分析]

C --> D[规则引擎]

D -->|匹配| E[应用规则进行清洗]

D -->|未匹配| F[自适应学习]

E --> G[清洗结果验证]

F -->|新规则| D

G --> H[结果应用]

H --> I[结束]

```

## 5.2 数据清洗技术的伦理和标准问题

### 5.2.1 数据质量与伦理标准

数据清洗不仅涉及技术问题,更是一个伦理问题。随着数据保护法规的不断出台,数据清洗技术必须遵守相关的伦理标准和隐私保护法律。确保数据清洗过程不损害个人隐私、不传播偏见,并保持数据的完整性和准确性是未来技术发展的关键方向。

### 5.2.2 数据清洗技术的行业标准与规范

行业标准和规范的制定对于数据清洗技术的健康发展至关重要。这不仅有助于提升数据质量,还能够推动整个行业向统一的数据处理标准迈进。国际标准化组织(ISO)和其他专业机构已经在这方面开展了工作,未来我们可以预见更多针对数据清洗的具体指南和标准将被制定和采纳。

## 5.3 发展趋势与行业洞察

### 5.3.1 数据清洗技术的最新研究方向

最新的研究方向正在尝试将数据清洗与其他数据处理技术相结合。例如,结合数据集成技术,可以在数据集成的过程中同时进行数据清洗。此外,研究者也在探索基于云计算的数据清洗服务,这将大大提升数据清洗的灵活性和可扩展性。

### 5.3.2 行业内的数据清洗实践案例分析

在实际应用中,一些行业已经实施了先进数据清洗技术。例如,在金融行业,为了提高信用评分模型的准确性,银行和金融机构投入大量资源进行数据清洗。在医疗行业,为了准确分析病例数据,数据清洗同样扮演着重要角色。这些案例展示了数据清洗技术如何对行业产生深远影响。

```table

| 行业 | 数据清洗应用领域 | 挑战与需求 |

|----------|---------------------------------|-----------------------------|

| 金融 | 信用评分、欺诈检测 | 准确性、实时性、隐私保护 |

| 医疗 | 病例数据分析、临床决策支持系统 | 数据质量、数据保护法规遵守 |

| 零售 | 客户关系管理、销售预测 | 数据完整性、个性化服务 |

| 制造业 | 产品质量控制、预测性维护 | 实时性、自动化、异常处理能力 |

| 社交媒体 | 舆情分析、用户行为分析 | 大数据处理、情感分析 |

```

随着技术的不断进步,数据清洗领域将不断涌现新的方法和技术,对于IT行业来说,掌握这些新技术是应对未来挑战的关键。同时,随着法规的完善和标准化进程的推进,数据清洗将在各个行业中发挥越来越重要的作用。

0

0