循环学习率优化策略:深度学习训练的终极指南

发布时间: 2024-08-21 07:36:53 阅读量: 19 订阅数: 30

PyTorch深度学习模型训练与部署实战指南

# 1. 深度学习训练中的优化策略**

深度学习模型的训练需要使用优化算法来最小化损失函数。常见的优化算法包括梯度下降法、动量法和RMSprop。这些算法通过迭代更新模型参数来逐步降低损失。

优化策略是指导优化算法如何更新参数的规则。循环学习率优化策略是一种先进的策略,它通过周期性地改变学习率来提高训练效率。

# 2. 循环学习率优化策略

### 2.1 循环学习率的概念和原理

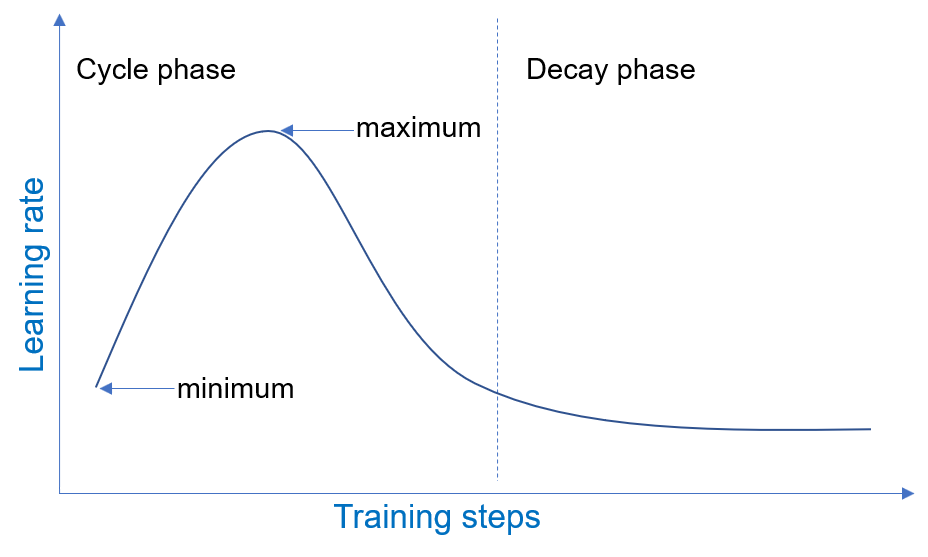

循环学习率(CLR)是一种优化策略,它通过周期性地改变学习率来提高深度学习模型的训练性能。CLR 的基本原理是,在训练过程中,学习率应该在较低值和较高值之间循环,以避免陷入局部极小值并促进模型收敛。

### 2.2 循环学习率的类型和选择

CLR 有两种主要类型:

- **三角形循环学习率 (TCLR)**:学习率从较低值上升到较高值,然后又下降到较低值,形成三角形图案。

- **余弦退火循环学习率 (CCLR)**:学习率遵循余弦函数,从较高值逐渐下降到较低值。

选择 CLR 类型取决于训练任务和模型的复杂性。 TCLR 通常适用于具有大量训练数据的任务,而 CCLR 更适用于具有较少训练数据的任务。

### 2.3 循环学习率的超参数调整

CLR 的超参数包括:

- **最大学习率 (lr_max)**:学习率的最高值。

- **最小学习率 (lr_min)**:学习率的最低值。

- **周期长度 (N)**:学习率循环的步数。

- **阶段数 (M)**:训练过程中的循环次数。

这些超参数的调整需要根据训练任务和模型的性能进行实验。一般来说,lr_max 和 lr_min 应设置在合理的范围内,以避免过拟合或欠拟合。周期长度和阶段数应根据训练数据的规模和模型的复杂性进行调整。

**代码示例:**

```python

import tensorflow as tf

# 定义三角形循环学习率

lr_schedule = tf.keras.optimizers.schedules.TriangleLR(

max_learning_rate=0.1,

min_learning_rate=0.001,

cycle_length=100,

name="triangle_lr"

)

# 定义优化器

optimizer = tf.keras.optimizers.Adam(learning_rate=lr_schedule)

```

**逻辑分析:**

此代码定义了一个三角形循环学习率调度器,最大学习率为 0.1,最小学习率为 0.001,周期长度为 100 步。该调度器将被用于 Adam 优化器,它将根据循环学习率策略动态调整学习率。

# 3.1 计算机视觉任务

在计算机视觉任务中,循环学习率 (CLR) 已被证明可以提高图像分类、目标检测和语义分割模型的性能。

**图像分类**

图像分类任务涉及将图像分配到预定义的类别中。CLR 已被用于训练图像分类模型,例如 ResNet、Inception 和 VGGNet。研究表明,CLR 可以加快训练速度,同时提高模型的准确性。

**目标检测**

目标检测任务涉及在图像中定位和分类对象。CLR 已被用于训练目标检测模型,例如 Faster R-CNN、YOLO 和 SSD。研究表明,CLR 可以提高目标检测模型的平均精度 (mAP),同时减少训练时间。

**语义分割**

语义分割任务涉及将图像中的每个像素分配到相应的语义类别。CLR 已被用于训练语义分割模型,例如 FCN、U-Net 和 DeepLab。研究表明,CLR 可以提高语义分割模型的像素精度和平均交并比 (mIoU)。

### 3.2 自然语言处理任务

在自然语言处理 (NLP) 任务中,CLR 已被证明可以提高文本分类、机器

0

0