市场情绪分析案例:TextBlob在金融领域的文本分析

发布时间: 2024-10-04 20:03:42 阅读量: 56 订阅数: 25

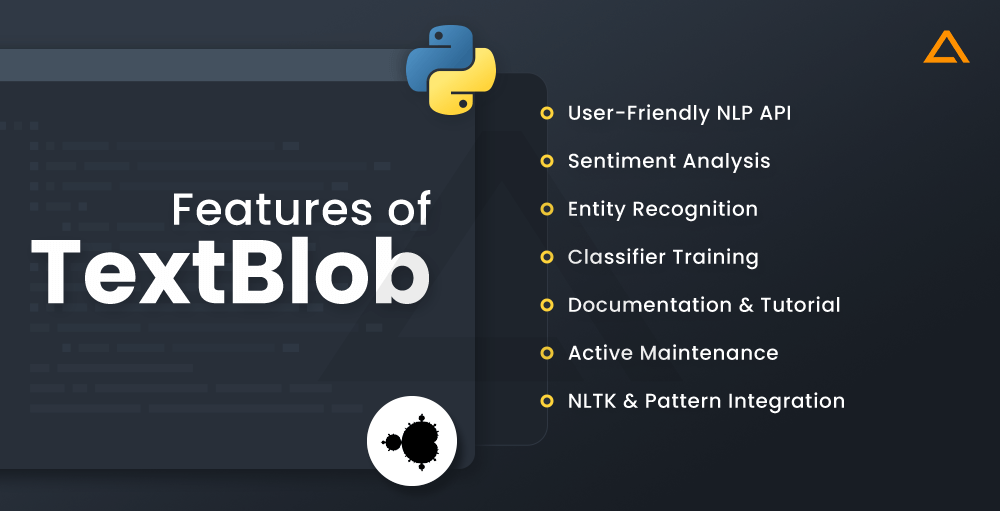

# 1. 市场情绪分析简介与TextBlob概述

市场情绪分析是金融分析的一个分支,它试图通过研究投资者行为、新闻报道和社交媒体情绪来预测市场的动向。TextBlob是一个用于处理文本数据的Python库,它简化了自然语言处理(NLP)任务,特别适合于情绪分析等应用。在本文中,我们将探讨TextBlob如何被用来对市场情绪进行基本分析,并提供一些实际案例来展示其功能。通过本章内容,读者将对TextBlob有一个初步的了解,并期待后续章节中详细介绍其在市场情绪分析中的应用。

# 2. TextBlob基础理论与实践

在第二章中,我们将深入探讨TextBlob库,这是一款用于处理文本数据并提供自然语言处理功能的Python库。TextBlob不仅简化了NLP任务,还提供了丰富的API来执行诸如词性标注、句法分析和情感分析等操作。我们从TextBlob库的安装开始,逐步深入到文本处理和情感分析的核心功能,并通过实践案例来展示其应用。

## 2.1 TextBlob库的安装与配置

### 2.1.1 环境搭建与依赖安装

在开始使用TextBlob之前,您需要确保您的Python环境已经准备好。TextBlob支持Python 3.6及以上版本,并且依赖于`numpy`和`nltk`等库。可以通过以下步骤来安装和配置您的环境:

1. 更新`pip`到最新版本以确保兼容性。

2. 安装TextBlob库本身。

3. 安装其他依赖库,如`nltk`,它包含了大量用于NLP的资源。

接下来的代码块展示了如何执行这些步骤:

```bash

python -m pip install --upgrade pip

pip install textblob

pip install nltk

```

在安装`nltk`后,您还需要下载特定的数据包,这些数据包包含用于文本处理的各种模型和字典。可以通过Python的交互式解释器来下载这些数据:

```python

import nltk

nltk.download('punkt')

nltk.download('averaged_perceptron_tagger')

```

### 2.1.2 TextBlob库的初始化与版本检查

一旦安装了TextBlob及其依赖,您就可以在Python中导入并使用它了。TextBlob库可以通过一行简单的代码来初始化,从而开始执行各种文本处理任务。

```python

from textblob import TextBlob

# 创建一个TextBlob实例

blob = TextBlob("I love writing code in Python!")

# 输出TextBlob的版本信息

print(TextBlob.__version__)

```

### 代码逻辑说明

上述代码块展示了如何导入TextBlob库,并创建一个`TextBlob`实例。`TextBlob`对象能够执行多种NLP操作,而打印出版本号可以确保我们使用的是当前安装的版本。

接下来,我们将深入TextBlob库中,探索其基本的文本处理功能,包括文本清洗与分词,以及词性标注与句法分析。

## 2.2 TextBlob的基本文本处理功能

### 2.2.1 文本清洗与分词

在处理文本数据时,经常需要先进行清洗和分词。文本清洗涉及去除无用字符或标点符号,而分词则是将文本拆分成单词或短语等更小的单元。TextBlob通过一个简单的API实现了这些功能。

```python

from textblob import TextBlob

blob = TextBlob("TextBlob is amazingly simple to use. Just import and analyze!")

# 文本清洗

cleaned_text = blob.correct()

print(cleaned_text)

# 分词

words = blob.words

print(words)

```

### 代码逻辑说明

在这里,我们使用`correct`方法对文本进行了简单的清洗,它会自动纠正常见的拼写错误。分词则通过访问`words`属性来获取分词后的单词列表。

### 2.2.2 词性标注与句法分析

TextBlob也提供了词性标注(Part-of-Speech Tagging, POS Tagging)和句法分析功能,这些功能对于理解文本内容和结构非常有用。

```python

blob = TextBlob("TextBlob is amazingly simple to use. Just import and analyze!")

# 词性标注

tags = blob.tags

print(tags)

# 句法分析

parse_tree = blob.parse()

print(parse_tree)

```

### 代码逻辑说明

通过`tags`属性,TextBlob为每个词提供了词性标注,这对于后续的语义分析非常关键。而`parse`方法则返回了一个句法分析树,展示了句子的句法结构。

上述内容介绍了TextBlob的安装、初始化、文本清洗与分词以及词性标注与句法分析等基础文本处理功能。在下一节中,我们将着重探讨TextBlob在情感分析领域的应用,这是市场情绪分析的核心技术之一。

## 2.3 TextBlob的情感分析实践

### 2.3.1 极性评分与主体性评分的原理

情感分析是使用算法来识别和提取文本中的主观信息。TextBlob使用极性评分和主体性评分来进行情感分析。极性评分是一个介于-1(非常负面)和1(非常正面)之间的分数,表示一段文本的情感倾向。主体性评分则是一个介于0(完全客观)和1(完全主观)之间的分数,表示文本的主观程度。

```python

from textblob import TextBlob

blob = TextBlob("I love writing code in Python! It's a beautiful language.")

# 极性评分和主体性评分

polarity = blob.sentiment.polarity

subjectivity = blob.sentiment.subjectivity

print("Polarity:", polarity)

print("Subjectivity:", subjectivity)

```

### 代码逻辑说明

上述代码演示了如何计算文本的情感极性评分和主体性评分。通过`sentiment`属性可以访问这些评分,其中包含`polarity`和`subjectivity`两个字段。

### 2.3.2 实际文本情感分析案例演示

情感分析的实际应用可以用于多种场景,例如分析社交媒体上的评论、评估客户反馈等。以下是TextBlob在实际文本情感分析中的一个案例。

```python

from textblob import TextBlob

# 示例文本

text = [

"I can't believe how great this product is!",

"The quality of the service was below expectations.",

"I'm extremely happy with my new car."

]

# 对每条文本进行情感分析

for sentence in text:

blob = TextBlob(sentence)

print(f"Text: {sentence}")

print(f"Polarity: {blob.sentiment.polarity}, Subjectivity: {blob.sentiment.subjectivity}")

print()

```

### 代码逻辑说明

这段代码对一个文本列表中的每条文本执行了情感分析。TextBlob的`sentiment`属性用于获取每条文本的情感极性评分和主体性评分。

情感分析是TextBlob的亮点之一,它为我们提供了快速准确地进行市场情绪分析的工具。通过下一章的高级技巧和实际应用,我们将进一步展示如何将TextBlob应用于更复杂的市场情绪分析任务。

# 3. 市场情绪分析的高级技巧

随着市场情绪分析在商业决策中的作用日益增强,分析方法的深入与细化成为了核心话题。在本章节中,我们将探讨一些高级技巧,它们涉及时间序列数据的处理、多源数据的综合分析以及情绪分析结果的可视化和解释。

## 3.1 时间序列数据的情绪分析

### 3.1.1 时间序列数据的处理与格式化

在金融和商业领域,情绪分析经常涉及到大量的时间序列数据。这些数据包括了过去一段时间内的股票价格、社交媒体帖子、新闻报道等,它们随时间变化,形成了一条条的时间序列。要对这些时间序列数据进行情绪分析,首先需要处理和格式化数据。

数据处理的第一步是数据清洗,去除无关数据、纠正错误信息、填补缺失值等

0

0