【声学模型全攻略】:15个实用技巧让你成为语音识别高手

发布时间: 2024-09-06 19:28:46 阅读量: 91 订阅数: 38

# 1. 声学模型的基础知识与原理

## 1.1 什么是声学模型

声学模型是语音识别系统中的一个关键组成部分,其目的在于建立声学信号与语言学信息之间的映射关系。简单来说,声学模型将声音转化为可理解的文字或命令,是将人声这种复杂信号转换成计算机可以处理的数据结构的过程。

## 1.2 声学模型的工作原理

声学模型通常基于统计模型,如隐马尔可夫模型(HMM),或者基于深度学习的模型,如循环神经网络(RNN)和卷积神经网络(CNN)。这些模型通过分析大量的语音数据,学习音素(语音的基本单位)的统计特性,并尝试识别出语音信号中的模式。

## 1.3 声学模型的重要性

在语音识别技术中,声学模型是将声音波形转换为文字输出的核心。好的声学模型能够提高识别的准确性,增强语音识别系统的鲁棒性,使其能更好地理解和处理不同的语音环境,从而提升用户体验。

## 1.4 发展历程与技术趋势

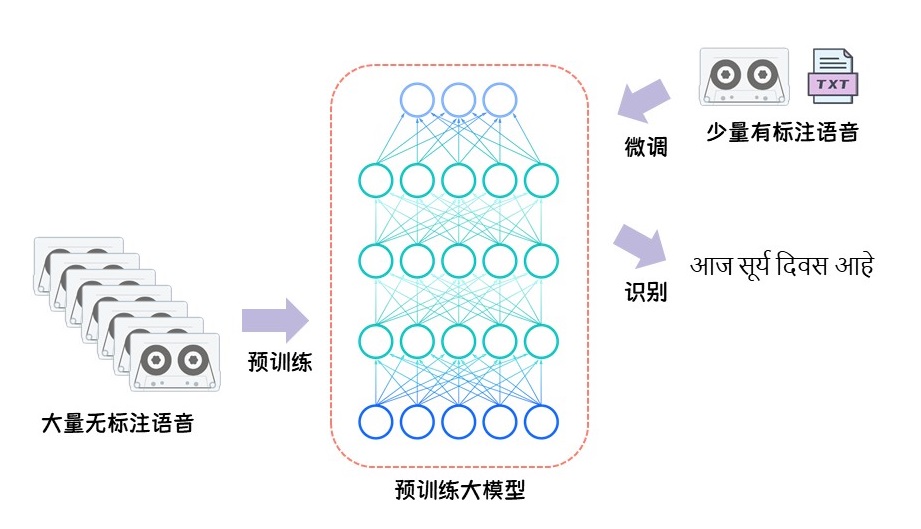

从传统的Gaussian Mixture Models (GMM)到深度学习模型,声学模型的发展经历了多次技术革新。当前的研究方向包括了无监督学习、端到端的系统以及跨模态学习等,进一步提高了模型对语言的理解能力和对环境的适应能力。未来,声学模型有望在自然语言处理领域发挥更大的作用。

# 2. 构建和训练声学模型的步骤

## 2.1 声学数据的准备与预处理

### 2.1.1 选择合适的数据集

声学模型的构建和训练第一步是选择合适的数据集,这通常包括语音数据和对应的文本数据。数据集的质量直接关系到模型的性能。数据集应涵盖多种发音、语调、口音等,并且应足够大,以便模型可以学习到语音的多样性。例如,对于一个通用的语音识别模型,可能需要包含各种方言和口音的广泛语音数据。

选择数据集时还应考虑数据的代表性,确保覆盖了模型将来可能遇到的各种语音场景。此外,版权和隐私问题也不容忽视,使用公开的数据集或确保拥有使用权是必要的前提条件。

```mermaid

graph LR

A[开始选择数据集] --> B[确定语音识别任务]

B --> C[采集语音样本]

C --> D[版权和隐私审核]

D --> E[预处理与标准化]

E --> F[准备对应文本数据]

F --> G[构建初步数据集]

G --> H{评估数据质量}

H -- "满足要求" --> I[数据集完善]

H -- "不满足要求" --> J[重新采集或补充]

```

### 2.1.2 数据清洗与格式转换

获得数据集后,接下来是数据清洗和格式转换。清洗工作包括移除背景噪音、消除口误、剔除重复或过短的样本。格式转换则确保所有数据符合模型输入要求,比如音频文件的格式、采样率、声道数等。

```markdown

假设我们有一个初步的数据集 `raw_dataset.wav`,我们首先使用 `sox` 工具清理背景噪音,接着使用 Python 脚本将数据转换为模型所需的格式。

```

```bash

# 使用 Sox 清理噪音,假设 `clean噪音.wav` 是清理后的文件

sox raw_dataset.wav clean噪音.wav silence 1 0.1 1% 1 0.5 2%

# 使用 Python 脚本调整格式

python convert_format.py --input clean噪音.wav --output clean噪音.flac --format flac

```

### 2.1.3 特征提取技术

预处理的最后一步是特征提取。特征提取是将原始音频信号转换为一系列数值特征的过程,这些特征要能够代表音频中的声学信息。常见的声学特征包括梅尔频率倒谱系数(MFCCs)、线性预测系数(LPCs)、梅尔滤波器组能量(FBANKs)等。

```python

import librosa

# 加载音频文件

y, sr = librosa.load('clean噪音.flac')

# 提取MFCC特征

mfccs = librosa.feature.mfcc(y=y, sr=sr, n_mfcc=13)

# 将特征保存为文件

np.save('mfccs.npy', mfccs)

```

在这段代码中,我们使用 `librosa` 库加载了一个名为 `clean噪音.flac` 的文件,并提取了13个梅尔频率倒谱系数(MFCCs)。这些特征随后被保存为 `.npy` 文件,以便之后用于模型训练。

## 2.2 声学模型的构建

### 2.2.1 模型选择与设计

在声学模型的设计阶段,通常需要决定使用何种类型的神经网络。循环神经网络(RNN)、长短期记忆网络(LSTM)、门控循环单元(GRU)以及卷积神经网络(CNN)等都是可能的选择。此外,研究人员也在探索基于注意力机制和变换器(Transformer)的声学模型。

模型的复杂度应当与数据集的大小、计算资源和期望的性能相匹配。大型复杂模型虽然可能带来更好的准确性,但也需要更多的数据和更强的计算能力。

### 2.2.2 训练算法和超参数调整

模型确定后,需要选择合适的训练算法和超参数。超参数包括学习率、批次大小、迭代次数、优化器类型等。调整超参数通常需要多次尝试和错误,可以使用网格搜索、随机搜索或更高级的优化技术如贝叶斯优化。

```python

from keras.callbacks import EarlyStopping

# 设置训练参数

batch_size = 64

epochs = 50

patience = 10

# 使用 EarlyStopping 防止过拟合

early_stopping = EarlyStopping(monitor='val_loss', patience=patience)

# 编译模型

***pile(loss='categorical_crossentropy', optimizer='adam', metrics=['accuracy'])

# 训练模型

history = model.fit(X_train, y_train, validation_data=(X_val, y_val), batch_size=batch_size, epochs=epochs, callbacks=[early_stopping])

```

以上代码展示了如何在 Keras 深度学习框架中编译模型,并使用 `EarlyStopping` 确保模型在验证集上的性能不再提升时停止训练。

### 2.2.3 模型的验证与测试

在模型训练完成后,需要对其进行验证和测试。验证通常在训练过程中完成,以监控模型在未见过的验证数据上的性能。测试则是在所有训练结束后,使用完全独立的测试数据集来评估模型的泛化能力。

测试时使用的一些性能指标包括准确率、精确率、召回率、F1分数和字错误率(WER)。这些指标可以帮助我们理解模型在实际应用中的表现。

## 2.3 模型的优化与调参

### 2.3.1 误差分析与改进策略

误差分析是识别和理解模型在哪些方面表现不佳的过程。这可能涉及到分析错误预测的类型、频率以及它们与输入数据的关系。通过分析误差,我们可以有针对性地改进模型的结构或参数。

### 2.3.2 超参数调优的方法

超参数调优是提高模型性能的常用方法之一。常用的方法包括网格搜索和随机搜索。网格搜索穷举所有可能的参数组合,而随机搜索在可能的参数空间内随机抽取组合进行尝试。近年来,贝叶斯优化由于其高效的搜索策略而变得越来越流行。

### 2.3.3 过拟合与欠拟合的处理

处理过拟合可以采用多种策略,包括数据增强、提前停止、正则化和丢弃法等。数据增强通过添加更多变化的数据来增加模型的泛化能力。提前停止可以在验证集的性能不再提升时停止训练。正则化方法如 L1/L2 正则化和丢弃法可以减少模型复杂度,防止过拟合。

对于欠拟合,我们可以通过增加模型复杂度、训练时间、输入特征数量或者调整数据预处理策略来解决。

在下一章节,我们将讨论声学模型在实际项目中的应用,包括语音识别系统的集成、不同场景的模型调整以及模型的部署与维护。

# 3. 声学模型在实际项目中的应用

声学模型是语音技术的核心,它在项目中的实际应用直接决定了语音识别系统的质量和性能。本章将从语音识别系统的集成、针对不同场景的模型调整,以及模型的部署与维护三个方面进行探讨。

## 3.1 语音识别系统的集成

在第三章的开篇,我们需要了解声学模型在语音识别系统中扮演的角色,以及它如何与其他模块协同工作以实现有效的语音识别。

### 3.1.1 声学模型在语音识别中的作用

声学模型的核心任务是将音频信号中的声学特征映射到对应的语言单元上,如音素、字或者词。为了达到这个目的,声学模型需要进行大量训练,以学习不同声学特征与语言单元之间的关联性。在实际的语音识别系统中,声学模型通常与其他模块如语言模型、解码器以及后处理模块共同工作,以提高识别的准确性和理解能力。

在语音识别过程中,声学模型首先处理输入的音频信号,提取声学特征向量,然后根据训练好的模型将这些特征向量转化为语言单元的得分或者概率。得分或概率信息随后被传递到语言模型,用于评估不同单词序列的自然度,最后由解码器结合语言模型的得分来决定最有可能的输出序列。

### 3.1.2 与其他模块的协同工作

在语音识别系统中,声学模型并非独立工作,而是与语言模型、解码器、后处理等多个模块紧密协同。语言模型预测给定的词序列出现的可能性,对声学模型提供的可能性进行补充。解码器则负责根据声学模型和语言模型提供的信息,采用搜索算法找到最有可能的词序列。

声学模型与语言模型的配合是通过解码器来实现的。例如,一个常见的解码算法是基于维特比(Viterbi)算法的动态规划方法,它能够找到在给定声学模型和语言模型概率下的最可能词序列。

```python

# 伪代码展示了基于维特比算法的解码过程

def decode(viterbi_matrix, emission_scores, transition_matrix, states):

# 初始化第一个时间步

viterbi_matrix[0] = emissions_scores[0] * transition_matrix[initial_state]

# 递归解码

for t in range(1, len(emission_scores)):

for current_state in states:

# 计算最优路径

best_path = max(viterbi_matrix[t-1] * transition_matrix[current_state]) + emission_scores[t][current_state]

viterbi_matrix[t][current_state] = best_path

# 找到最终路径

best_path = max(viterbi_matrix[-1])

return best_path

```

在上述的伪代码中,`viterbi_matrix`表示维特比矩阵,`emission_scores`为声学模型输出的概率,`transition_matrix`为语言模型给出的状态转移概率,`states`为所有可能的状态。解码器通过这个过程计算出最优的词序列。

## 3.2 针对不同场景的模型调整

声学模型面对的是多变的实际使用环境,因此需要根据不同的使用场景进行优化,以提高鲁棒性和准确性。

### 3.2.1 噪音环境下的性能优化

噪音环境是语音识别系统常见的一大挑战。在这种环境下,声学模型需要有足够的能力过滤掉噪音,提高信噪比,以准确识别语音内容。为了优化噪音环境下的性能,可以采取以下几种策略:

1. 数据增强:在训练数据中加入各种噪音,以使模型能够学习识别在噪音背景下的语音特征。

2. 噪音抑制算法:使用预先训练好的噪音抑制模型,预先处理输入的音频信号。

3. 多任务学习:在声学模型训练阶段同时训练其他相关任务,如语音分离,提升模型对噪音的敏感度。

```python

# 代码示例:数据增强中加入白噪音的过程

import numpy as np

import soundfile as sf

def add_white_noise(audio_path, noise_level):

# 加载原始音频

data, rate = sf.read(audio_path)

# 生成白噪音

noise = np.random.normal(0, 1, size=data.shape) * noise_level

# 加入白噪音

data_noisy = data + noise

return data_noisy, rate

# 使用数据增强函数

data_noisy, rate = add_white_noise("clean_audio.wav", noise_level=0.05)

```

在上述代码中,`add_white_noise`函数接受原始音频路径和噪声级别作为参数,生成加入了白噪音的音频信号。

### 3.2.2 多语言和方言处理

由于不同语言和方言具有不同的声学特征,单一的声学模型很难适应多种语言和方言的识别需求。为了处理多语言和方言,通常采用以下几种方法:

1. 多任务学习:训练时同时考虑多种语言或方言,以共享语言共性并保持语言特性。

2. 语言适应:使用少量目标语言数据,通过迁移学习对声学模型进行微调。

3. 方言识别:先通过方言识别模块识别说话者的方言,再切换到对应的声学模型进行处理。

### 3.2.3 实时处理与延迟优化

实时语音识别是许多应用中必不可少的功能。为了实现高效实时处理,需要关注以下几点:

1. 流式处理:采用流式声学模型来实现低延迟处理。

2. 硬件加速:使用专用硬件,如DSP或FPGA,以加速计算。

3. 算法优化:优化算法以减少计算复杂度,例如使用注意力机制而不是循环神经网络(RNN)。

## 3.3 模型的部署与维护

部署和维护声学模型是保证其在实际应用中长期稳定工作的关键环节。对于不同的平台,部署策略和模型维护的方式也有所不同。

### 3.3.1 部署到不同平台的策略

在部署声学模型到不同平台时,需要考虑平台特性,如计算能力和环境限制。策略包括:

1. 轻量化模型:针对移动和边缘设备,设计轻量化的声学模型,减少模型大小和运算量。

2. 模型转换:将模型转换为特定平台支持的格式,例如TensorFlow Lite用于移动设备。

3. 云服务:对于计算能力较强的平台,可以使用云端服务器运行复杂的声学模型。

### 3.3.2 模型的持续更新与维护

随着时间的推移和技术的进步,声学模型需要不断更新和维护来适应新的需求和挑战:

1. 持续学习:采用在线学习或增量学习机制,不断利用新的数据对模型进行优化。

2. 版本控制:实现模型版本的管理和回滚机制,以便出现问题时能够快速恢复。

3. 用户反馈:收集用户反馈,作为模型迭代和优化的重要输入。

通过上述的介绍和示例代码,我们可以看到声学模型不仅仅是一个独立的技术,它需要与多个系统和算法模块相互配合,共同工作以满足不同的实际应用需求。在不同的使用场景中,还需要对声学模型进行有针对性的调整和优化,以提升其在现实世界中的鲁棒性和准确性。

# 4. 声学模型的高级技巧与工具

## 4.1 利用深度学习提升性能

### 4.1.1 深度学习架构的选择

深度学习在声学模型中的应用显著提升了语音识别的准确性。选择合适的深度学习架构对于优化声学模型至关重要。在众多架构中,卷积神经网络(CNNs)、循环神经网络(RNNs)、长短期记忆网络(LSTMs)和Transformer架构是目前最流行的深度学习模型。

CNNs擅长提取局部特征,对语音信号中的频谱特征提取十分有效。RNNs能够处理序列数据,而LSTMs在处理长序列数据时能记住重要信息并避免传统RNNs的梯度消失问题。Transformer模型则通过自注意力机制捕获长距离依赖关系,展现了在处理语音信号方面的巨大潜力。

在选择架构时,开发者需要考虑应用的特定需求,例如延迟、计算资源以及实时性要求。通常,端到端的深度学习模型能够自动提取特征,减少了人工干预的需要,但可能需要更大的数据集和计算资源。

```python

# 代码示例:使用Keras构建一个简单的LSTM模型用于声学特征提取

from keras.models import Sequential

from keras.layers import LSTM, Dense, Dropout

# 构建模型架构

model = Sequential()

model.add(LSTM(256, input_shape=(timesteps, input_dim)))

model.add(Dropout(0.2))

model.add(Dense(num_classes, activation='softmax'))

# 编译模型

***pile(loss='categorical_crossentropy', optimizer='adam', metrics=['accuracy'])

```

以上代码块展示了一个基本的LSTM模型的搭建,其中`timesteps`是输入序列的时间步长,`input_dim`是特征维度,`num_classes`是输出分类数。模型包含一个LSTM层,一个Dropout层用于防止过拟合,以及一个全连接层用于输出分类结果。

### 4.1.2 端到端的声学模型

端到端的声学模型将传统语音识别流程中的多个步骤整合为一个单一的深度学习模型。这种模型通常能够直接从原始音频信号到最终的文本输出进行映射,避免了传统多阶段处理中可能引入的误差累积。

端到端模型的一个典型例子是基于连接时序分类(CTC)损失函数的模型。CTC允许模型在训练过程中自动学习如何对齐输入信号与输出标签,无需显式地对齐数据。另一个例子是基于注意力机制的模型,它能够自适应地关注输入信号的不同部分以提高识别准确性。

实现端到端模型的关键在于足够大的训练数据集以及强大的计算能力。这种方法能够显著简化声学模型的开发流程,并有可能实现最佳性能。

```python

# 代码示例:使用Keras实现一个基于CTC的端到端模型

from keras.layers import Input, LSTM, Dense, TimeDistributed, Lambda

from keras.models import Model

# 定义输入层

input_data = Input(shape=(None, input_dim))

# 定义LSTM层

lstm_out = LSTM(n_units)(input_data)

# 定义输出层

output = TimeDistributed(Dense(num_classes, activation='softmax'))(lstm_out)

# 定义CTC损失函数

labels = Input(name='the_labels', shape=[max_string_len], dtype='float32')

input_length = Input(name='input_length', shape=[1], dtype='int64')

label_length = Input(name='label_length', shape=[1], dtype='int64')

loss_out = Lambda(ctc_lambda_func, output_shape=(1,), name='ctc')([lstm_out, labels, input_length, label_length])

# 构建模型

model = Model(inputs=[input_data, labels, input_length, label_length], outputs=loss_out)

```

在此代码示例中,我们首先构建了包含LSTM层的模型,然后定义了输出层。接着,我们使用了一个自定义的损失函数`ctc_lambda_func`,该函数基于CTC损失函数的实现,可以整合到模型中以实现端到端的训练。

## 4.2 利用端点检测改善识别效果

### 4.2.1 端点检测技术原理

在语音处理中,端点检测是指确定语音信号中有效语音开始和结束的点。这对于语音识别系统至关重要,因为它能够帮助系统区分语音和非语音部分,减少无效处理和提高识别效率。

端点检测通常利用信号的特征,比如能量、零交叉率以及频谱特征,通过设置阈值或使用机器学习算法来检测语音段的开始和结束。一种常见方法是基于能量的端点检测,它根据语音信号的能量水平判断语音的活跃度。

在深度学习时代,端点检测通常作为声学模型训练的一部分,与语音识别任务共享网络结构。端点检测模型被训练来识别特定的信号模式,这些模式与实际语音活动相关联,以此来减少识别过程中的无效处理。

```python

# 代码示例:基于能量阈值的简单端点检测

import numpy as np

def endpoint_detection(signal, energy_threshold=0.01):

energy = np.sum(np.abs(signal)**2) / len(signal)

if energy > energy_threshold:

return True

else:

return False

# 假设signal是已经加载的语音信号

signal = load_audio_signal('path_to_audio_file')

is_speech = endpoint_detection(signal)

```

上述代码块定义了一个简单的端点检测函数`endpoint_detection`,它计算语音信号的能量并与预设阈值进行比较,以判断是否为语音段。

### 4.2.2 实践中的端点检测应用

在实际应用中,端点检测通常嵌入到语音识别流程中。语音活动检测(VAD)是端点检测的一种实践应用,VAD可以降低背景噪声的影响,提高识别系统的鲁棒性。

在实际的语音识别系统中,VAD常通过更复杂的算法实现,例如使用高斯混合模型(GMM)或深度学习来区分语音和非语音。这些算法通常在后台运行,作为识别流程的一部分,当检测到语音时才激活识别器,这有助于减少计算资源的浪费。

```python

# 代码示例:实现一个简单的语音活动检测器

from scipy.io import wavfile

from pydub import AudioSegment

def vad(signal, energy_threshold=0.01, min_speech_duration=1000):

speech_segments = []

start = 0

is_speech = False

for i in range(0, len(signal)):

if endpoint_detection(signal[i], energy_threshold):

if not is_speech:

start = i

is_speech = True

else:

if is_speech and (i - start) > min_speech_duration:

speech_segments.append(signal[start:i])

is_speech = False

return speech_segments

# 加载语音信号

fs, signal = wavfile.read('path_to_audio_file.wav')

signal = np.array(signal, dtype=np.float64)

# 获取语音段

speech_segments = vad(signal)

```

在此代码示例中,`vad`函数遍历信号,使用`endpoint_detection`来检测语音段,保存超过最小持续时间(`min_speech_duration`)的语音段。`min_speech_duration`帮助过滤掉短时的噪声。

## 4.3 高级声学特征和模型

### 4.3.1 声谱特征的提取技术

声谱特征的提取是语音识别中的核心步骤之一,这些特征能够表示语音信号在频域中的分布,对于声学模型的训练至关重要。常见的声谱特征包括梅尔频率倒谱系数(MFCCs)、频谱质心、频谱能量、频谱平坦度等。

MFCCs是目前最流行的声谱特征,它们基于人耳的听觉感知特性,能够有效反映语音信号的特征。MFCCs提取过程中通常包括预加重、窗函数应用、快速傅里叶变换(FFT)、梅尔滤波器组和离散余弦变换(DCT)等步骤。

提取声谱特征时,需要精心选择参数,例如帧长、帧移、滤波器组的数量,这些都可能影响最终特征的有效性。另外,合适的特征归一化也是必不可少的,它有助于减少不同信道间的差异,提升模型的泛化能力。

```python

# 代码示例:使用Python提取MFCC特征

import librosa

# 加载音频文件

audio_path = 'path_to_audio_file.wav'

y, sr = librosa.load(audio_path)

# 提取MFCC特征

mfccs = librosa.feature.mfcc(y=y, sr=sr, n_mfcc=13, n_fft=2048, hop_length=512, n_mels=40)

# 展示MFCCs

print(mfccs)

```

代码块中使用`librosa`库提取MFCC特征,`n_mfcc`参数代表要提取的MFCC系数数量,`n_fft`和`hop_length`分别定义了FFT的窗口长度和帧移。`n_mels`定义了梅尔滤波器组的数量。提取的MFCCs对于声学模型的训练非常有价值。

### 4.3.2 模型集成与多模型融合

模型集成是提高声学模型性能的有效策略之一。它通过结合多个模型的预测来减少方差,提升模型的鲁棒性和准确性。在实践中,模型集成通常涉及不同类型或结构的模型,例如不同参数的深度学习模型,或者深度学习模型与传统的声学模型的结合。

模型集成可以通过简单的投票机制,也可以通过更复杂的融合策略实现,比如使用逻辑回归或神经网络来融合不同模型的输出。集成学习方法如bagging和boosting也能被应用于声学模型集成。

```python

# 代码示例:实现简单模型投票集成

from sklearn.ensemble import VotingClassifier

from sklearn.linear_model import LogisticRegression

from sklearn.svm import SVC

from sklearn.tree import DecisionTreeClassifier

# 假设有三个训练好的模型:model1, model2, model3

model1 = LogisticRegression()

model2 = SVC()

model3 = DecisionTreeClassifier()

# 构建投票集成模型

ensemble = VotingClassifier(estimators=[('lr', model1), ('svm', model2), ('tree', model3)], voting='soft')

# 使用集成模型进行预测

predictions = ensemble.predict(X_test)

```

在此代码示例中,我们使用了`sklearn.ensemble.VotingClassifier`创建了三个不同模型的投票集成。使用`voting='soft'`允许模型权重依赖于它们的预测概率,这是融合不同模型输出的一种有效方法。通过集成不同模型,可以显著提高识别系统的准确性和鲁棒性。

# 5. 解决声学模型常见问题

在这一章中,我们将详细讨论解决声学模型在实际应用和维护过程中遇到的常见问题。这包括调试与问题诊断、性能评估、以及兼容性与标准化问题。我们将探索解决这些问题的方法,工具和最佳实践,确保模型能够顺利运行,提供最佳的性能。

## 5.1 声学模型的调试与问题诊断

声学模型的调试与问题诊断是确保模型能够正确执行的关键步骤。它涉及了识别和解决在数据准备、训练和部署过程中可能遇到的各种问题。

### 5.1.1 错误分析与调试工具

错误分析对于调试声学模型至关重要,因为它有助于识别问题发生的根源。首先,需要收集模型的输出结果以及相关的日志信息,然后通过比较输出结果和预期结果来找出偏差。

```python

# 伪代码示例:错误分析逻辑

# 代码块注释:该段伪代码演示了一个典型的错误分析过程,用于识别声学模型的常见错误。

def analyze_errors(model_output, expected_output):

errors = []

for i in range(len(model_output)):

if model_output[i] != expected_output[i]:

errors.append((model_output[i], expected_output[i], i))

return errors

# 假设模型输出和期望输出

model_output = [...] # 模型输出结果列表

expected_output = [...] # 预期的输出结果列表

# 调用错误分析函数

errors = analyze_errors(model_output, expected_output)

# 输出错误详情

for error in errors:

print(f"Error found at index {error[2]}: Model output {error[0]}, Expected {error[1]}")

```

在上面的伪代码中,`analyze_errors`函数将模型输出与期望输出进行比较,并收集任何差异。这为开发者提供了一种量化和定位错误的方法。

### 5.1.2 常见问题的排查流程

排查声学模型的问题通常需要一个系统化的方法。这通常开始于检查数据集的完整性、模型的训练过程和测试环境。一个详细的问题排查流程有助于快速定位和解决问题。

```mermaid

graph LR

A[问题排查开始] --> B{数据集检查}

B --> |完整性缺失| C[修复或补充数据]

B --> |格式问题| D[数据格式转换]

B --> |数据不一致| E[数据清洗和标准化]

E --> F{模型训练检查}

F --> |训练未收敛| G[调整学习率和优化器]

F --> |过拟合| H[增加数据增强或简化模型]

F --> |欠拟合| I[优化特征提取或增加模型复杂度]

I --> J{测试环境检查}

J --> |部署问题| K[更新部署脚本或配置]

J --> |兼容性问题| L[调整模型以适应新环境]

```

在上图所示的流程图中,问题排查流程被分解为几个阶段,每个阶段都关注不同的问题域。通过这些步骤,可以系统地诊断和解决声学模型在部署过程中可能遇到的问题。

## 5.2 声学模型的性能评估

性能评估是判断声学模型是否达到设计目标的重要环节。评估指标与测试方法的选择对于准确反映模型性能至关重要。

### 5.2.1 评估指标与测试方法

声学模型的性能评估通常包括准确性、召回率、精确率和F1分数等指标。这些指标有助于全面评价模型对语音信号的识别能力。

```markdown

评估声学模型性能时,一般采用以下指标:

- **准确性(accuracy)**: 表示模型正确识别的样本数量与总样本数量的比例。

- **召回率(recall)**: 表示模型正确识别的正样本数量与实际正样本数量的比例。

- **精确率(precision)**: 表示模型正确识别的正样本数量与模型识别为正样本的总数量的比例。

- **F1分数(F1-score)**: 是精确率和召回率的调和平均数,综合考虑了两者的影响。

评估方法通常包括交叉验证、独立测试集测试等。

```

评估指标和测试方法的选择依赖于具体的应用场景和需求。例如,在实时语音识别系统中,低延迟和实时性可能比高准确性更重要。

### 5.2.2 性能提升的有效途径

为了提升声学模型的性能,可以从数据、模型架构、训练过程等多个维度进行优化。

```markdown

一些提升声学模型性能的有效途径包括:

- **数据增强(data augmentation)**: 通过人工制造或引入更多变化来增加训练数据的多样性,有助于模型更好地泛化。

- **特征工程(feature engineering)**: 设计和选择更有代表性的特征,有助于提升模型对关键信号的感知能力。

- **模型结构优化(structure optimization)**: 通过引入先进的神经网络架构如Transformer或CNN,可提高模型的表达能力。

- **超参数调整(hyperparameter tuning)**: 通过网格搜索、随机搜索或贝叶斯优化等方法,找到最佳的超参数配置,从而获得更好的模型性能。

```

性能提升的途径依赖于对问题的深入理解,通常需要结合实验和经验来确定最佳的优化策略。

## 5.3 声学模型的兼容性与标准化

兼容性与标准化是声学模型成功集成到不同系统与平台的关键因素。解决这些问题确保了模型可以广泛地应用于多样化的环境和设备。

### 5.3.1 兼容性问题的解决

兼容性问题通常与硬件、操作系统或软件库的版本有关。解决这些问题需要仔细规划,以确保声学模型可以在不同的系统上无缝运行。

```markdown

兼容性问题的解决方案包括:

- **交叉编译(cross-compiling)**: 为不同的目标平台生成模型可执行文件,确保模型能够在目标系统上运行。

- **容器化(containers)**: 使用Docker等容器技术封装模型和运行环境,可以确保跨平台的一致性和可移植性。

- **模型转换(model conversion)**: 将模型转换为特定平台支持的格式,如ONNX到TensorRT,确保模型在边缘设备上高效执行。

```

### 5.3.2 标准化流程与最佳实践

标准化流程确保声学模型在开发和部署过程中遵循一致的质量标准和实践。这有助于提高模型的可维护性和可靠性。

```markdown

标准化流程包括:

- **代码审查(code review)**: 定期进行代码审查,确保代码质量,避免代码错误和潜在的安全风险。

- **文档(documentation)**: 提供完整的开发文档和用户手册,帮助开发者理解模型的工作原理和部署步骤。

- **单元测试(unit testing)**: 编写单元测试,确保模型的关键组件能够正确执行。

- **集成测试(integration testing)**: 对模型与外部系统集成的部分进行测试,确保不同组件间的协同工作。

- **持续集成/持续部署(CI/CD)**: 通过自动化测试和部署流程,确保模型的更新和维护能够快速且高效地完成。

```

通过遵循上述标准化流程,声学模型的开发和维护将更加高效和系统化。

综上所述,解决声学模型的常见问题需要细致的调试、全面的性能评估以及对兼容性和标准化的深入理解。通过持续的优化和标准化实践,我们可以确保声学模型能够在不同的应用场景中提供稳定且可靠的服务。

# 6. 声学模型的未来趋势与研究方向

随着人工智能技术的不断进步,声学模型作为语音处理领域的核心技术之一,正面临着前所未有的发展机遇。本章节将探讨声学模型技术的最新进展,开源社区与学术研究的动态,以及未来可能的研究方向和挑战。

## 6.1 声学模型技术的最新进展

声学模型作为理解人类语音的重要技术,在过去几十年中已经取得了巨大的进步。随着深度学习技术的兴起,声学模型的性能得到了显著提升。

### 6.1.1 人工智能在声学模型中的应用

人工智能特别是深度学习技术的应用,让声学模型从传统的基于知识的系统转变为基于数据驱动的模型。通过大量的语音数据训练,深度神经网络可以捕获复杂的特征并优化模型性能。

#### 案例分析:端到端的声学模型

端到端的声学模型是一种新型的深度学习架构,它可以直接从语音波形到最终的输出(如文字或命令)进行建模,省去了传统声学模型中的多个中间步骤。这极大地简化了模型结构并提升了识别效率。

```python

# 伪代码:端到端声学模型的构建示例

import tensorflow as tf

from tensorflow.keras.layers import Dense, LSTM

# 假设已有预处理后的语音数据和对应的标签

input_data, labels = load_preprocessed_data()

# 构建模型结构

model = tf.keras.Sequential([

LSTM(256, return_sequences=True),

LSTM(256),

Dense(num_classes, activation='softmax')

])

# 编译模型

***pile(loss='categorical_crossentropy', optimizer='adam', metrics=['accuracy'])

# 训练模型

model.fit(input_data, labels, epochs=30, batch_size=32)

# 评估模型性能

# ...

```

### 6.1.2 前沿技术对声学模型的影响

前沿技术,如量子计算、边缘计算和增强学习等,对声学模型的发展产生了积极的影响。它们不仅提供了新的算法和计算模型,而且为声学模型的实时处理和个性化训练带来了可能。

## 6.2 开源社区与学术研究动态

开源社区和学术研究是推动声学模型发展的重要力量。它们不仅提供了创新的平台,还为研究者和开发者之间的知识交流建立了桥梁。

### 6.2.1 参与开源项目与贡献

许多开源项目如Kaldi、ESPnet等都是声学模型研究与应用的重要资源。参与这些项目不仅可以获取最新的研究进展,还能与其他研究者一起协作解决问题。

#### 实践技巧:贡献到开源项目

- Fork感兴趣的开源项目仓库。

- 在本地环境中进行修改或添加新功能。

- 提交Pull Request(PR)以共享你的工作。

- 参与讨论和代码审查过程。

### 6.2.2 学术论文与会议资源

最新的学术研究成果往往首先发表在国际会议和学术期刊上。了解这些资源是声学模型研究者不可或缺的一部分工作。

#### 学术资源推荐

- IEEE ICASSP(国际声学、语音与信号处理会议)

- Interspeech(国际语音通信学会)

- 论文预印本平台如arXiv和SSRN

## 6.3 未来研究方向与展望

尽管声学模型技术已经取得了长足的进步,但仍存在许多挑战和提升空间。未来的研究方向可能会集中在以下几个方面。

### 6.3.1 声学模型的发展潜力

声学模型仍将在准确性、鲁棒性和适用性上有所突破。例如,自适应算法和在线学习技术能够让声学模型更好地适应不同用户的语音特性。

### 6.3.2 面临的挑战与机遇

声学模型在小型化、高效能、隐私保护等方面仍面临挑战。此外,多模态交互和情感识别等新兴领域的研究也将为声学模型的发展带来新的机遇。

### 结语

本章总结了声学模型的技术进展和未来的研究方向。通过分析最新的技术趋势和学术动态,我们可以预见声学模型在人工智能领域的巨大潜力。作为一名IT领域的专业人员,紧跟这些趋势是十分必要的,以便在这一领域中保持竞争力和创新能力。

0

0