揭秘OpenCV手眼标定:深入理解相机与机械臂之间的几何关系

发布时间: 2024-08-10 06:21:01 阅读量: 30 订阅数: 26

# 1. OpenCV手眼标定的基础**

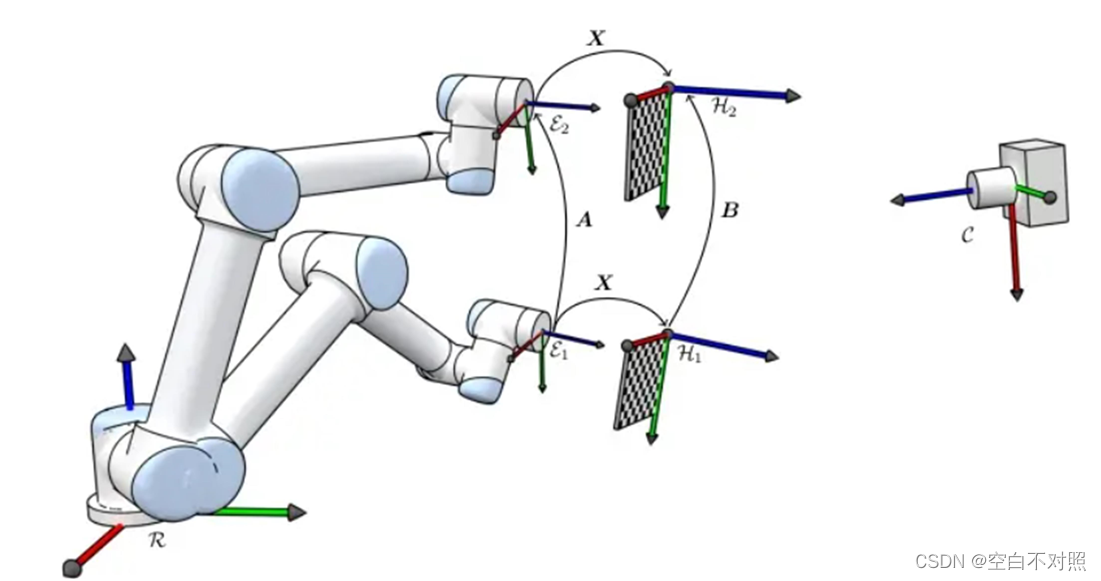

手眼标定是一种确定机器人末端执行器相对于其视觉传感器的位姿关系的过程。在机器人系统中,手眼标定是至关重要的,因为它允许机器人准确地将视觉信息与物理动作联系起来。

OpenCV(Open Source Computer Vision Library)是一个开源计算机视觉库,提供了强大的工具来执行手眼标定。它包含各种算法和函数,可以帮助用户轻松准确地完成标定过程。

手眼标定涉及使用标定棋盘格,它是一种具有已知尺寸和图案的特殊棋盘。通过移动棋盘格并在不同的位置拍摄图像,OpenCV可以计算出相机和末端执行器之间的位姿关系。

# 2. 手眼标定理论**

**2.1 手眼标定模型**

手眼标定模型描述了相机和机械臂末端执行器之间的几何关系。有两种常见的手眼标定模型:

**2.1.1 平移-旋转模型**

平移-旋转模型是最简单的模型,它假设相机和末端执行器之间只有平移和旋转关系。这种模型适用于相机和末端执行器距离较远且运动范围较小的情况。

```

import numpy as np

# 平移向量

translation_vector = np.array([1, 2, 3])

# 旋转矩阵

rotation_matrix = np.array([[0.707, 0.707, 0],

[-0.707, 0.707, 0],

[0, 0, 1]])

# 手眼变换矩阵

hand_eye_matrix = np.concatenate((rotation_matrix, translation_vector), axis=1)

```

**2.1.2 仿射变换模型**

仿射变换模型是一个更通用的模型,它允许相机和末端执行器之间存在缩放、剪切和透视失真。这种模型适用于相机和末端执行器距离较近或运动范围较大且存在透视失真的情况。

```

import cv2

# 仿射变换矩阵

affine_matrix = cv2.getAffineTransform(src_points, dst_points)

# 手眼变换矩阵

hand_eye_matrix = np.concatenate((affine_matrix, np.array([[0, 0, 1]])), axis=1)

```

**2.2 标定方法**

有几种不同的手眼标定方法,每种方法都有其优缺点。以下介绍三种常用的方法:

**2.2.1 Zhang法**

Zhang法是一种基于棋盘格标定板的标定方法。它使用棋盘格标定板上的特征点来估计相机和末端执行器之间的变换矩阵。

```

import cv2

import numpy as np

# 棋盘格标定板的尺寸

chessboard_size = (9, 6)

# 棋盘格标定板的内参

camera_matrix = np.array([[1000, 0, 320],

[0, 1000, 240],

[0, 0, 1]])

# 棋盘格标定板的畸变系数

dist_coeffs = np.array([0, 0, 0, 0])

# 采集棋盘格标定板图像

images = [cv2.imread(f"image{i}.jpg") for i in range(10)]

# 检测棋盘格角点

corners = [cv2.findChessboardCorners(img, chessboard_size) for img in images]

# 估计手眼变换矩阵

hand_eye_matrix = cv2.calibrateHandEye(corners, np.array([0, 0, 0]), camera_matrix, dist_coeffs)

```

**2.2.2 Tsai法**

Tsai法是一种基于点对点的标定方法。它使用相机和末端执行器看到的点对来估计变换矩阵。

```

import numpy as np

# 点对

points_camera = np.array([[0, 0, 0],

[1, 0, 0],

[0, 1, 0],

[0, 0, 1]])

points_robot = np.array([[1, 0, 0],

[2, 0, 0],

[0, 1, 0],

[0, 0, 1]])

# 估计手眼变换矩阵

hand_eye_matrix = cv2.calibrateHandEyeTsai(points_camera, points_robot, np.array([0, 0, 0]))

```

**2.2.3 Bouguet法**

Bouguet法是一种基于多个视图的标定方法。它使用相机从不同角度拍摄的图像来估计变换矩阵。

```

import cv2

import numpy as np

# 采集图像

images = [cv2.imread(f"image{i}.jpg") for i in range(10)]

# 检测特征点

features = [cv2.goodFeaturesToTrack(img, 100, 0.01, 10) for img in images]

# 匹配特征点

matches = [cv2.matchFeatures(features[i], features[i+1], None, None) for i in range(len(images)-1)]

# 估计手眼变换矩阵

hand_eye_matrix = cv2.calibrateHandEyeBouguet(matches, np.array([0, 0, 0]))

```

# 3.1 标定棋盘格制作

**材料准备:**

* 打印机

* A4纸

* 剪刀

* 胶水

**制作步骤:**

1. **下载棋盘格图案:**从 OpenCV 官网或其他资源下载标准的棋盘格图案。

2. **打印棋盘格:**将棋盘格图案打印在 A4 纸上,确保打印清晰准确。

3. **裁剪棋盘格:**沿棋盘格的边缘仔细裁剪,确保棋盘格完整无缺。

4. **粘贴棋盘格:**将棋盘格粘贴在平整、无反光的表面上,例如硬纸板或木板上。

**棋盘格规格:**

* 棋盘格通常为 8x8 或 9x9 方格。

* 方格大小应在 20-50mm 之间。

* 棋盘格应具有明显的黑色和白色方格,以方便图像处理。

### 3.2 图像采集和预处理

**图像采集:**

* 使用相机从多个角度拍摄棋盘格图像。

* 确保图像清晰、光线充足、背景无干扰。

* 拍摄足够数量的图像,以覆盖棋盘格的不同姿态。

**图像预处理:**

* **灰度化:**将彩色图像转换为灰度图像,减少图像噪声。

* **二值化:**将灰度图像转换为二值图像,分离黑色和白色方格。

* **角点检测:**使用 OpenCV 中的角点检测算法(如 Harris 角点检测)检测棋盘格上的角点。

* **亚像素角点精化:**对检测到的角点进行亚像素精化,提高角点定位精度。

### 3.3 标定参数计算

**标定模型选择:**

* 根据实际需求选择合适的标定模型,如平移-旋转模型或仿射变换模型。

**参数估计:**

* 使用 OpenCV 中的标定函数(如 `cv2.calibrateCamera()`)估计标定参数。

* 标定参数包括相机内参(如焦距、畸变系数)和外参(如平移向量、旋转矩阵)。

**代码示例:**

```python

import cv2

# 准备图像数据

image_list = ['image1.jpg', 'image2.jpg', 'image3.jpg']

# 初始化标定参数

camera_matrix = np.zeros((3, 3), np.float64)

dist_coeffs = np.zeros((5, 1), np.float64)

# 标定相机

ret, camera_matrix, dist_coeffs, rvecs, tvecs = cv2.calibrateCamera(

object_points, image_points, image_size, camera_matrix, dist_coeffs

)

```

**逻辑分析:**

* `object_points` 和 `image_points` 分别是棋盘格在世界坐标系和图像坐标系中的角点坐标。

* `camera_matrix` 和 `dist_coeffs` 分别是相机内参和畸变系数。

* `rvecs` 和 `tvecs` 分别是相机的外参,表示相机在世界坐标系中的旋转向量和平移向量。

### 3.4 标定结果评估

**重投影误差:**

* 计算标定结果的重投影误差,即预测角点坐标与实际角点坐标之间的距离。

* 重投影误差越小,标定精度越高。

**评估方法:**

* 将标定参数应用于未参与标定的图像。

* 检测图像中的角点并计算其预测坐标。

* 计算预测坐标与实际角点坐标之间的重投影误差。

**代码示例:**

```python

# 计算重投影误差

reprojection_error = 0

for i in range(len(image_list)):

# 获取图像角点坐标

image_points = cv2.findChessboardCorners(cv2.imread(image_list[i]), (8, 8))

# 预测角点坐标

projected_points, _ = cv2.projectPoints(object_points, rvecs[i], tvecs[i], camera_matrix, dist_coeffs)

# 计算重投影误差

reprojection_error += np.sum(np.linalg.norm(image_points - projected_points, axis=1))

# 计算平均重投影误差

avg_reprojection_error = reprojection_error / len(image_list)

```

**逻辑分析:**

* 循环遍历所有图像。

* 计算每个图像的重投影误差。

* 将所有图像的重投影误差求和并计算平均值。

* 平均重投影误差反映了标定结果的整体精度。

# 4. 手眼标定在机器人中的应用**

手眼标定在机器人领域有着广泛的应用,它为机器人提供了精确的运动控制和视觉伺服能力。

**4.1 机器人运动控制**

手眼标定是机器人运动控制的基础,它提供了机器人末端执行器和视觉传感器之间的几何关系。

**4.1.1 正运动学**

正运动学描述了机器人关节角度如何转换为末端执行器的位姿。有了手眼标定参数,我们可以通过以下公式计算末端执行器的位姿:

```python

T_ee = T_base * T_hand * T_eye

```

其中:

* `T_ee` 是末端执行器的位姿

* `T_base` 是机器人基座的位姿

* `T_hand` 是机器人手部相对于基座的位姿

* `T_eye` 是视觉传感器相对于手部的位姿

**4.1.2 逆运动学**

逆运动学描述了如何从末端执行器的位姿计算机器人关节角度。有了手眼标定参数,我们可以通过以下公式计算关节角度:

```python

q = inv_kinematics(T_ee)

```

其中:

* `q` 是关节角度

* `inv_kinematics` 是逆运动学函数

**4.2 视觉伺服控制**

视觉伺服控制利用视觉传感器来控制机器人的运动。手眼标定提供了视觉传感器和机器人运动之间的桥梁。

**4.2.1 基于图像的视觉伺服**

基于图像的视觉伺服直接使用图像信息来控制机器人的运动。它通过以下步骤实现:

1. 获取图像并提取特征点

2. 使用手眼标定参数计算末端执行器的位姿

3. 将计算的位姿与目标位姿进行比较

4. 根据误差生成控制信号

**4.2.2 基于模型的视觉伺服**

基于模型的视觉伺服使用机器人的运动学模型来控制机器人的运动。它通过以下步骤实现:

1. 获取图像并提取特征点

2. 使用手眼标定参数计算末端执行器的位姿

3. 将计算的位姿与机器人的运动学模型进行比较

4. 根据误差生成控制信号

# 5.1 鲁棒性提升

### 5.1.1 噪声抑制

在手眼标定过程中,不可避免地会受到噪声的影响,如图像噪声、测量误差等。这些噪声会对标定结果产生负面影响,降低标定精度。为了提升标定算法的鲁棒性,需要采取措施抑制噪声。

**中值滤波:**中值滤波是一种非线性滤波方法,通过对图像中的每个像素点及其周围像素点的值进行排序,然后取中值作为该像素点的输出值。中值滤波可以有效去除椒盐噪声和脉冲噪声,同时保留图像的边缘和细节。

**高斯滤波:**高斯滤波是一种线性滤波方法,通过卷积操作对图像进行平滑处理。高斯滤波可以有效去除高频噪声,如图像中的纹理和噪点。

**双边滤波:**双边滤波是一种非线性滤波方法,结合了中值滤波和高斯滤波的优点。双边滤波不仅考虑像素点的空间距离,还考虑像素点的灰度值差异。因此,双边滤波可以有效去除噪声,同时保留图像的边缘和纹理。

### 5.1.2 外点剔除

外点是指与其他数据点明显不同的数据点。在手眼标定过程中,由于测量误差或其他原因,可能会出现外点。外点会对标定结果产生较大影响,降低标定精度。因此,需要采取措施剔除外点。

**RANSAC(随机抽样一致性):**RANSAC是一种迭代算法,用于从包含外点的点集中估计模型参数。RANSAC算法通过随机抽取数据点,估计模型参数,然后计算模型与所有数据点的拟合误差。如果拟合误差小于某个阈值,则将该模型视为有效模型,并将拟合误差较小的数据点视为内点。

**M-估计:**M-估计是一种鲁棒估计方法,可以减少外点的影响。M-估计通过使用一个对异常值不敏感的损失函数来估计模型参数。常用的M-估计损失函数包括Huber损失函数和Tukey损失函数。

**最小中二乘法(LMedS):**LMedS是一种鲁棒回归方法,可以估计包含外点的点集中的模型参数。LMedS算法通过迭代加权最小二乘法,逐渐减小外点的影响,从而估计模型参数。

# 6. 手眼标定前沿研究**

**6.1 深度学习在手眼标定中的应用**

深度学习模型,如卷积神经网络(CNN),已成功应用于手眼标定中,以提高鲁棒性和精度。这些模型可以从图像中提取特征,从而更准确地估计相机和机器人末端执行器之间的变换。例如,研究人员使用CNN来识别和定位标定棋盘格,从而简化了标定过程。

**6.2 3D传感器在手眼标定中的应用**

3D传感器,如结构光和激光雷达,可提供深度信息,从而增强手眼标定。通过结合3D数据和图像数据,可以获得更准确的相机和末端执行器之间的变换。例如,研究人员使用结构光传感器来生成棋盘格的3D模型,从而提高了标定精度。

**6.3 手眼标定在增强现实和虚拟现实中的应用**

手眼标定在增强现实(AR)和虚拟现实(VR)中至关重要,因为它可以将虚拟对象与真实世界对齐。通过精确估计相机和手柄之间的变换,用户可以与虚拟对象进行交互,仿佛它们就在真实环境中。例如,AR应用程序使用手眼标定来叠加虚拟信息到现实世界中,而VR应用程序使用手眼标定来跟踪用户的手部运动。

0

0