【TensorFlow核心解码】:全面解析数据流图与会话管理

发布时间: 2024-09-30 08:25:30 阅读量: 78 订阅数: 49

# 1. TensorFlow概述与安装

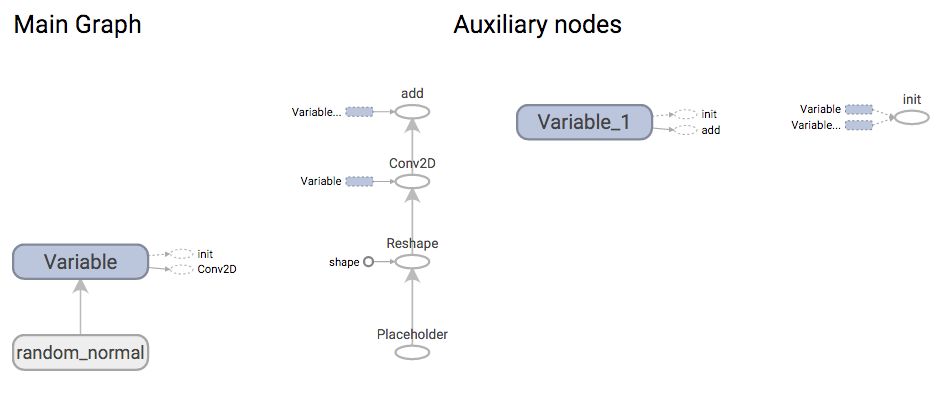

TensorFlow是由谷歌开发的一个开源机器学习框架,广泛用于研究和生产。它采用了数据流图(Data Flow Graphs)的计算模型,这种模型适用于大规模的数值计算。数据流图是一个有向图,其中的节点(Nodes)代表数学运算,而边(Edges)代表在节点之间传递的多维数据数组,即张量(Tensors)。这种设计使得TensorFlow在构建、训练和部署机器学习模型时具备高度的灵活性和可扩展性。

TensorFlow支持多种语言编写API,包括Python、C++、Java等。接下来,我们将介绍TensorFlow在Python环境中的安装和基本配置。

## TensorFlow的安装

安装TensorFlow可以通过以下两种主要方式:

### 使用pip安装

在Python环境中使用pip安装是最简便的方法。打开终端或命令提示符,并输入以下命令:

```bash

pip install tensorflow

```

### 使用conda安装

如果你使用的是Anaconda环境,可以通过conda进行安装:

```bash

conda install -c conda-forge tensorflow

```

安装完成后,你可以通过以下Python代码测试TensorFlow是否正确安装:

```python

import tensorflow as tf

print(tf.__version__)

```

如果安装成功,你将看到TensorFlow的版本号打印在终端或命令提示符中。

## 验证安装

为了确保TensorFlow安装无误并能正常工作,可以运行一个简单的程序。例如,创建一个常量张量并打印它:

```python

hello = tf.constant('Hello, TensorFlow!')

print(hello.numpy())

```

如果程序能够正常运行并打印出"Hello, TensorFlow!",那么你的TensorFlow安装就成功了,现在可以开始进一步探索TensorFlow的强大功能了。

# 2. 数据流图(Data Flow Graphs)的构建与理解

## 2.1 图的定义与组件

### 2.1.1 节点(Nodes)和边(Edges)

数据流图是TensorFlow的核心概念之一,它由节点(Nodes)和边(Edges)组成,用于表示计算任务的结构。在TensorFlow中,节点代表操作(Operations),边代表操作之间传递的多维数组,即张量(Tensors)。

**节点(Nodes):** 节点执行一个操作,如加法、乘法或矩阵运算。每个操作会输出一个或多个张量,它们作为后续操作的输入。

```mermaid

graph TD

A[输入数据] -->|操作| B[加法]

B -->|结果| C[输出数据]

```

**边(Edges):** 边表示张量从一个节点流向另一个节点的数据流。边反映了张量的形状和数据类型信息。

**代码示例:**

```python

import tensorflow as tf

# 创建常量节点

node1 = tf.constant(3.0, dtype=tf.float32)

node2 = tf.constant(4.0) # 也可以省略dtype

# 创建加法操作节点

node3 = tf.add(node1, node2)

# 运行会话并打印结果

with tf.Session() as sess:

result = sess.run(node3)

print(result) # 输出张量值

```

在本段代码中,`node1` 和 `node2` 是输入节点,`tf.add` 是执行加法操作的节点,而 `node3` 则是表示这个加法操作结果的节点。通过创建会话运行图时,TensorFlow会执行数据流图中从输入节点到输出节点的全部操作。

### 2.1.2 操作(Operations)和张量(Tensors)

操作是数据流图的执行单元,TensorFlow定义了大量的操作来支持各种数值计算。这些操作可以是简单的数学运算,如加法、乘法,也可以是复杂的操作,如矩阵乘法、卷积操作等。而张量则是多维数组的数据结构,它在网络中的流动形成了数据流图的边。

**操作(Operations):**TensorFlow的操作分为两类:一类是低级操作,直接对应于底层库的函数;另一类是高级操作,用于构建复杂的计算流程。例如,`tf.matmul` 是矩阵乘法的操作,而 `tf.nn.relu` 是执行ReLU激活函数的操作。

**张量(Tensors):**张量可以是零维的(标量),一维的(向量),二维的(矩阵)或更高维的数组。张量在图中传输数据,每个张量都有一个数据类型和一个形状。

**代码示例:**

```python

# 创建矩阵乘法操作节点

mat1 = tf.constant([[1.0, 2.0], [3.0, 4.0]])

mat2 = tf.constant([[1.0, 1.0], [2.0, 2.0]])

# 执行矩阵乘法

product = tf.matmul(mat1, mat2)

# 运行会话并打印结果

with tf.Session() as sess:

result = sess.run(product)

print(result) # 输出矩阵乘法结果

```

在本段代码中,我们定义了两个矩阵的常量节点,并通过 `tf.matmul` 创建了一个矩阵乘法的操作节点 `product`。当执行会话时,TensorFlow会完成矩阵乘法的操作,并输出张量值。

### 表格展示操作和张量的属性

| 属性 | 描述 |

| ------------ | ------------------------------------------------------------ |

| 数据类型 | 张量中元素的数据类型,例如 float32, int32, string 等。 |

| 形状 | 张量的维度结构,如[3]表示一维数组,[3, 3]表示3x3的二维数组。 |

| 值 | 存储在张量中的实际数值。 |

| 名称 | 每个操作生成的张量可以有一个可选的名称,用于调试和图可视化。 |

| 操作依赖关系 | 张量的计算依赖于其源操作,定义了操作之间的执行顺序。 |

理解了节点和边的关系,以及操作和张量的基本概念,接下来我们将探讨如何构建这些数据流图。

# 3. 会话管理(Session Management)的机制与实践

在TensorFlow中,会话(Session)是执行计算操作的运行环境,负责在图(Graph)中运行节点并计算结果。会话提供了与底层C++运行时的接口,负责图的构建、初始化和资源管理。

## 3.1 TensorFlow会话的概念

### 3.1.1 会话的作用与生命周期

会话的作用是运行TensorFlow图中的操作,执行图的节点计算,以及在设备(如CPU或GPU)上进行实际计算。一个会话封装了与计算设备的交互,并负责创建、计算和释放资源。

一个会话的生命周期通常包括三个阶段:创建、使用和销毁。创建会话时,TensorFlow会分配必要的资源,如内存和处理器时间。使用会话执行计算任务,最后在不再需要时销毁会话释放资源。

### 3.1.2 创建和配置会话

默认情况下,TensorFlow提供一个会话对象来执行图中的操作。可以使用`tf.Session()`创建一个新的会话实例:

```python

import tensorflow as tf

# 创建图

graph = tf.Graph()

with graph.as_default():

# 创建张量

a = tf.constant(5.0)

b = tf.constant(6.0)

c = a * b

# 创建会话

sess = tf.Session(graph=graph)

```

上面的代码创建了一个图并分配给变量`graph`。然后在该图的上下文中定义了两个张量`a`和`b`,以及它们的乘法操作`c`。`tf.Session()`用于创建一个会话,并通过`graph=graph`参数将图与会话关联。

配置会话时,可以指定一个图,也可以使用默认图,这在简单模型或脚本中非常方便。在更复杂的设置中,可能需要多个图以及对应多个会话。

## 3.2 会话中的计算执行

### 3.2.1 运行模型与计算

使用会话运行模型时,需要提供计算图以及希望运行的操作节点。`run()`方法是会话中执行操作的主要方法。

```python

# 使用会话运行计算

result = sess.run(c)

print("计算结果:", result)

```

`sess.run()`的调用执行了张量`c`的乘法操作,并打印了结果。这是最简单的操作执行示例,而在实际应用中,`run()`方法通常用于训练模型的周期、评估模型或者预测操作。

### 3.2.2 变量的初始化与分配

变量是TensorFlow中用于存储模型参数的特殊张量,它们在默认图构建阶段被创建。但变量需要初始化才能在会话中使用。

```python

# 创建变量

W = tf.Variable(tf.random_normal([1, 2]), name="weights")

b = tf.Variable(tf.random_normal([1]), name="bias")

# 初始化所有全局变量

sess.run(tf.global_variables_initializer())

```

这里`tf.global_variables_initializer()`用于初始化所有全局变量。在会话中运行初始化操作之前,这些变量是未分配的,无法参与计算。

## 3.3 资源管理与优化

### 3.3.1 会话资源的释放与管理

正确管理会话资源对于保持高效运行至关重要,需要在不再需要时释放资源。可以通过关闭会话来释放与之关联的所有资源:

```python

# 关闭会话并释放资源

sess.close()

```

在Python脚本结束时,应调用`close()`方法来释放资源。但为了更加方便地管理资源,TensorFlow也提供了`with`语句,它可以在代码块执行完毕后自动调用`close()`方法:

```python

# 使用with语句自动管理会话资源

with tf.Session(graph=graph) as sess:

result = sess.run(c)

print("计算结果:", result)

# 会话自动关闭

```

### 3.3.2 图的优化与内存控制

TensorFlow提供了多种方法来优化图的执行和内存使用。图优化包括合并操作、简化计算等,可以提升计算效率并减少内存消耗。例如,使用`tf.OptimizeForGraph()`可以对图进行优化。

内存控制方面,TensorFlow允许开发者显式地控制哪些操作和变量应保留在内存中,哪些可以释放。这对于处理大规模模型或有限硬件资源的情况下尤为重要。

会话管理和资源控制是TensorFlow应用中的关键部分,合理配置可以显著提高模型的性能和资源使用效率。在后续章节中,我们将探讨如何处理数据、进行数学计算以及构建和训练模型,所有这些操作都依赖于有效的会话管理实践。

# 4. 数据处理与输入管道

### 4.1 数据的表示与转换

在TensorFlow中,数据以张量的形式存在。张量(Tensor)是一个多维数组,可以视为不同类型的数值数据的容器。理解如何创建、操作和转换张量是进行有效数据处理的基础。

#### 4.1.1 张量的创建和操作

要创建一个张量,TensorFlow提供了多种函数,其中最常见的是`tf.constant`。下面的代码展示了如何创建一个常量张量:

```python

import tensorflow as tf

# 创建一个常量张量

tensor = tf.constant([[1, 2], [3, 4]])

# 输出张量信息

print(tensor)

```

```shell

tf.Tensor(

[[1 2]

[3 4]], shape=(2, 2), dtype=int32)

```

在这个例子中,`tf.constant`函数创建了一个形状为`(2, 2)`、数据类型为`int32`的二维张量。张量的操作包括索引、切片、拼接等。这些操作能够让我们访问或修改张量的部分或全部内容。

#### 4.1.2 数据预处理与增强

为了提高模型的泛化能力,常常需要对数据进行预处理和增强。TensorFlow提供了`tf.data.Dataset` API,用于高效地加载和预处理数据。预处理可以包括归一化、数据增强(如图像翻转、旋转)等。

```python

# 示例:对图像数据进行预处理

def preprocess_image(image):

image = tf.image.resize(image, [height, width]) # 调整图像大小

image /= 255.0 # 归一化

return image

# 使用tf.data.Dataset API

dataset = dataset.map(preprocess_image)

```

在这个例子中,我们定义了一个`preprocess_image`函数,用于调整图像大小并归一化像素值。之后,我们使用`tf.data.Dataset.map`函数来应用这个预处理函数到数据集中的每个元素。

### 4.2 输入函数与数据管道

在处理大量数据时,有效地加载和处理数据至关重要。TensorFlow的`tf.data` API提供了一种构建灵活和可复用数据输入管道的方式。

#### 4.2.1 使用`tf.data` API构建输入管道

`tf.data` API允许开发者构建一个包含数据预处理步骤的数据管道,使得数据加载与模型训练分离。下面展示了如何构建一个简单的数据管道:

```python

# 构建一个简单的数据管道

dataset = tf.data.Dataset.from_tensor_slices((images, labels))

dataset = dataset.shuffle(buffer_size=10000) # 打乱数据

dataset = dataset.batch(batch_size) # 批量处理

dataset = dataset.repeat(count=None) # 重复数据集

```

在上面的代码中,我们首先从张量片段创建了一个`Dataset`对象。然后使用`shuffle`、`batch`和`repeat`方法来增加数据集的多样性和容量。

#### 4.2.2 并行读取与数据预处理

为了提高数据加载速度,TensorFlow支持并行读取数据,并在多个CPU核心上并行执行数据预处理。这可以通过`tf.data.Dataset.prefetch`方法实现:

```python

dataset = dataset.prefetch(buffer_size=tf.data.experimental.AUTOTUNE)

```

在这个例子中,`prefetch`方法允许数据集在执行计算的同时预取数据。`buffer_size`参数设置为`tf.data.experimental.AUTOTUNE`可以让TensorFlow自动调整缓冲区大小,以最优的方式平衡数据加载时间和计算时间。

### 4.3 高级数据处理技术

在某些情况下,需要执行更复杂的数据操作。TensorFlow提供了一系列高级数据处理技术,包括映射、过滤、批处理和混洗。

#### 4.3.1 数据集的映射与过滤

映射(Map)操作允许对数据集中的每个元素应用一个函数,而过滤(Filter)操作则用于选择符合特定条件的元素。

```python

# 映射与过滤示例

dataset = dataset.map(lambda x, y: (x*2, y)) # 映射:将x的值乘以2

dataset = dataset.filter(lambda x, y: x > 20) # 过滤:只保留x大于20的元素

```

在这个例子中,我们通过`map`函数将图像数据`x`放大两倍,并通过`filter`函数筛选出图像像素值大于20的样本。

#### 4.3.2 批处理与数据集的混洗

为了训练模型,需要将数据集划分为多个批次。同时,为了提高模型的泛化能力,常常需要在每个训练周期开始前混洗数据集。

```python

# 批处理与数据集混洗示例

dataset = dataset.batch(batch_size)

dataset = dataset.shuffle(buffer_size)

```

在这段代码中,我们首先使用`batch`方法将数据集划分为固定大小的批次。然后通过`shuffle`方法对数据集进行混洗,以打乱元素的顺序,减少训练过程中的顺序偏差。

### 张量操作与输入管道的总结

在本章节中,我们深入探讨了TensorFlow中数据表示与转换的技术,如何使用`tf.data` API构建高效的数据输入管道,以及如何应用高级数据处理技术以适应复杂的场景。理解这些概念对于构建和训练高性能的TensorFlow模型是至关重要的。接下来,我们将进一步深入到张量操作和数学计算的世界,探讨如何在TensorFlow中实现更复杂的数学运算和自定义操作。

# 5. 张量操作与数学计算

## 5.1 张量基础

### 5.1.1 张量的数据类型与属性

在TensorFlow中,张量是多维数组,它是数据的基本单位。张量的属性包括数据类型、秩(或维度)和形状。张量的数据类型可能包括32位浮点数(tf.float32)、64位整数(tf.int64)、字符串(tf.string)等。理解这些基本属性对于进行数学计算和数据操作至关重要。

张量的秩是指它有多少维度。一个标量(0维张量)表示单一的数值,而向量(1维张量)有单一的维度,矩阵(2维张量)有两个维度。高维张量可以有三个维度或更多,它们在深度学习中非常常见,用于表示图像(高度、宽度、颜色通道)或序列数据(时间步长、特征维度)等。

张量的形状是一个整数元组,表示每个维度的大小。例如,一个形状为(3, 2)的张量有3行2列。

```python

import tensorflow as tf

# 创建张量的示例

scalar = tf.constant(7) # 标量

vector = tf.constant([1, 2, 3]) # 1维张量

matrix = tf.constant([[1, 2], [3, 4], [5, 6]]) # 2维张量

tensor = tf.constant([[[1, 2], [3, 4]], [[5, 6], [7, 8]]]) # 3维张量

```

### 5.1.2 张量的操作与变换

TensorFlow提供了广泛的张量操作函数,包括但不限于索引、切片、广播、数学运算等。这些操作允许用户对张量进行各种变换,从而准备数据或构建复杂计算。

例如,可以使用切片来提取张量的一部分:

```python

# 提取张量的子集

slice_tensor = tensor[:, 0, :]

```

或者使用tf.math模块中的函数来执行数学操作:

```python

# 对张量执行数学运算

addition = tf.math.add(tensor, matrix)

multiplication = tf.math.multiply(tensor, scalar)

```

### 5.1.3 张量形状操作

张量的形状操作包括重塑(reshape)、展平(flatten)、扩展(expand_dims)等。这些操作对于在不同类型的网络层之间传递数据至关重要。

```python

# 张量形状操作示例

reshaped = tf.reshape(tensor, [2, -1]) # 重新调整形状

flattened = tf.reshape(tensor, [-1]) # 展平张量

expanded = tf.expand_dims(flattened, axis=1) # 在指定维度扩展张量

```

## 5.2 数学计算库

### 5.2.1 线性代数运算

TensorFlow在`tf.linalg`模块中提供了丰富的线性代数运算函数。这些函数能够执行矩阵乘法、矩阵求逆、特征值分解等操作,是构建深度学习模型的基础。

例如,矩阵乘法操作如下:

```python

# 矩阵乘法操作

matrix_a = tf.constant([[1, 2], [3, 4]])

matrix_b = tf.constant([[5, 6], [7, 8]])

matrix_product = tf.linalg.matmul(matrix_a, matrix_b)

```

### 5.2.2 概率分布与随机数生成

TensorFlow的`tf.distributions`模块提供了构建概率模型所需的各种概率分布对象。这些分布包括正态分布、均匀分布、伯努利分布等。同时,`tf.random`模块提供了随机数生成函数,可以生成符合特定分布的随机数。

```python

# 随机数生成和概率分布操作示例

normal_dist = tf.distributions.Normal(loc=0.0, scale=1.0)

random_normal = normal_dist.sample(shape=[10])

uniform_dist = tf.distributions.Uniform(low=0.0, high=1.0)

random_uniform = uniform_dist.sample(shape=[10])

```

## 5.3 自定义数学操作

### 5.3.1 实现自定义操作

在TensorFlow中,你可以使用Python实现自定义操作,并通过tf.function装饰器来提升性能。在某些情况下,可能需要封装特定的数学计算,实现这些计算的自定义操作可以提高灵活性和效率。

```python

# 自定义数学操作示例

@tf.function

def custom_multiply(x, y):

# 实现自定义乘法操作

return tf.multiply(x, y)

# 调用自定义操作

result = custom_multiply(matrix_a, matrix_b)

```

### 5.3.2 封装与优化自定义操作

在实现自定义操作时,还可以考虑如何有效地封装这些操作,以便在模型中重用。此外,TensorFlow提供了多个优化器,比如自动微分器`tf.GradientTape`,可以用来计算自定义操作的梯度,进而用于优化算法。

```python

# 使用自动微分器进行梯度计算

x = tf.Variable(1.0)

with tf.GradientTape() as tape:

result = custom_multiply(x, x)

gradient = tape.gradient(result, x)

```

在本章节中,我们深入探讨了TensorFlow中的张量操作与数学计算。从张量的基础属性开始,到数学计算库提供的强大功能,再到如何实现和优化自定义操作。这一系列内容对于理解和实现深度学习模型的数学基础至关重要,而且这些知识可以广泛应用于各种算法和项目中。

# 6. 模型构建与训练

## 6.1 构建深度学习模型

深度学习模型的构建是通过层(Layers)的堆叠实现的。这些层可以是简单的线性变换,也可以是复杂的结构,比如卷积层、循环层等。自定义层是深度学习中一个非常重要的技能,它允许我们根据具体问题设计特定的网络结构。

### 6.1.1 层(Layers)的使用与自定义

在 TensorFlow 中,我们通常使用 `tf.keras.layers` 来添加层。这里我们以一个简单的全连接层(Dense Layer)为例:

```python

from tensorflow.keras.layers import Dense

from tensorflow.keras.models import Sequential

model = Sequential([

Dense(128, activation='relu', input_shape=(input_dim,)),

Dense(10, activation='softmax')

])

```

如果需要自定义层,可以通过继承 `tf.keras.layers.Layer` 类并实现 `__init__`, `build`, 和 `call` 方法来完成。下面是一个自定义一个简单的自定义激活层的例子:

```python

import tensorflow as tf

from tensorflow.keras.layers import Layer

import tensorflow.keras.backend as K

class MyActivation(Layer):

def __init__(self, activation_function, **kwargs):

super(MyActivation, self).__init__(**kwargs)

self.activation = tf.keras.activations.get(activation_function)

def call(self, inputs):

return self.activation(inputs)

```

### 6.1.2 模型的保存与恢复

为了能够保存和之后恢复训练好的模型,我们可以使用 TensorFlow 的 `model.save` 和 `tf.keras.models.load_model` 方法。

保存模型示例代码:

```python

model.save('my_model.h5')

```

恢复模型示例代码:

```python

from tensorflow.keras.models import load_model

restored_model = load_model('my_model.h5')

```

## 6.2 训练过程与优化器

训练深度学习模型本质上是一个优化问题,即通过优化算法来最小化损失函数,这样可以使得模型的预测值更接近真实值。

### 6.2.1 训练循环的实现

在 TensorFlow 中,通常会使用 `***pile` 方法配置训练参数,然后使用 `model.fit` 方法来训练模型。

```***

***pile(optimizer='adam',

loss='sparse_categorical_crossentropy',

metrics=['accuracy'])

history = model.fit(train_data, train_labels, epochs=10, validation_data=(test_data, test_labels))

```

### 6.2.2 损失函数与优化算法

损失函数用于衡量模型的预测值与真实值之间的差异。在 TensorFlow 中,提供了许多内置的损失函数,如 `tf.keras.losses.SparseCategoricalCrossentropy`。

优化器则是用来更新模型的权重,使损失函数值下降。常用的优化器包括 `SGD`, `RMSprop`, 和 `Adam`。它们的配置方式都很相似:

```python

optimizer = tf.keras.optimizers.Adam(learning_rate=0.001)

```

## 6.3 模型评估与测试

评估指标用于衡量模型在测试集上的表现,常见的评估指标包括准确率(Accuracy)、精确率(Precision)、召回率(Recall)等。

### 6.3.1 评估指标与测试集分析

在 TensorFlow 中,使用 `model.evaluate` 方法进行模型测试和评估指标的计算:

```python

test_loss, test_accuracy = model.evaluate(test_data, test_labels)

```

### 6.3.2 模型的泛化与调优

模型的泛化能力是指模型在未见过的数据上的表现能力。为了提高模型的泛化能力,可以采用多种策略,例如数据增强、正则化、调整模型复杂度等。

```python

from tensorflow.keras.callbacks import EarlyStopping

from tensorflow.keras.regularizers import l2

# 添加L2正则化

model.add(Dense(64, activation='relu', kernel_regularizer=l2(0.01)))

# 使用早停策略防止过拟合

early_stopping = EarlyStopping(monitor='val_loss', patience=3)

model.fit(train_data, train_labels, epochs=50, validation_split=0.2, callbacks=[early_stopping])

```

在本章中,我们学习了如何构建深度学习模型,以及如何通过训练过程和优化器来提升模型性能。我们还探索了模型评估和测试的重要性,以及如何对模型进行泛化和调优以适应不同的数据集。在下一章节中,我们将深入了解高级数据处理技术,以及如何通过 TensorFlow 的高级API进一步优化我们的数据处理流程。

0

0