【大数据高效处理】:TensorFlow数据管道构建技巧

发布时间: 2024-09-30 09:23:17 阅读量: 51 订阅数: 49

大数据流式计算:关键技术及系统实例 .docx

# 1. 大数据高效处理的重要性及应用场景

在信息技术的洪流中,大数据已不再是新奇之物,而成为我们生活中不可或缺的一部分。大数据的高效处理,对于IT行业意味着能够快速地从海量信息中提取价值,支持决策制定,增强业务竞争力。本章节将探讨大数据高效处理的重要性,并分析其在不同领域的应用场景。

大数据的高效处理是许多行业和业务流程中的关键点,它确保数据能够快速被处理,实时分析和反馈结果。从商业智能到人工智能,数据处理效率直接决定了企业的敏捷性与创新能力。

大数据应用场景繁多,涵盖了金融分析、智能推荐、网络监控、健康医疗、交通预测等众多领域。例如,在金融行业,通过高效处理大数据,可以识别欺诈行为,优化投资组合;在健康医疗领域,大数据技术能辅助疾病诊断,实现个性化医疗。

在这一章中,我们将对大数据处理的重要性及其在各个行业中的具体应用进行详细解析,以展示其价值和潜力。

# 2. TensorFlow基础和数据管道概念

## 2.1 TensorFlow简介

### 2.1.1 TensorFlow的发展历史和核心特性

TensorFlow是一个开源的机器学习框架,由Google Brain团队于2015年发布,用于研究和生产。它在设计时就考虑了可扩展性,因此无论是在桌面计算机、服务器还是移动设备上,TensorFlow都能够高效运行。核心特性如下:

- **多语言支持**:TensorFlow不仅支持Python,还支持C++, Java, Go等语言,提供了丰富的API。

- **强大的计算图**:TensorFlow使用数据流图进行计算,这种计算方式具有高度的灵活性和效率。

- **易于部署**:TensorFlow提供了丰富的工具和API,使得模型可以轻松部署到不同的平台。

- **社区和生态系统**:TensorFlow拥有庞大的社区支持和生态系统,提供了大量的教程、工具和资源。

### 2.1.2 TensorFlow与大数据处理的关联

在大数据处理方面,TensorFlow通过其数据管道(data pipeline)概念提供了强大的支持。数据管道是一种高效的批量处理方式,可以自动处理数据的收集、处理、分析和模型训练等过程。TensorFlow利用其数据管道可以实现以下功能:

- **高效的批处理**:通过TensorFlow的批处理机制,可以高效地处理大规模数据集。

- **分布式计算**:TensorFlow支持分布式计算,可以在多台机器上分配任务,大幅提高数据处理速度。

- **实时数据处理**:TensorFlow提供了实时数据处理的能力,适合流处理和实时分析。

## 2.2 数据管道的理论基础

### 2.2.1 数据管道的定义和作用

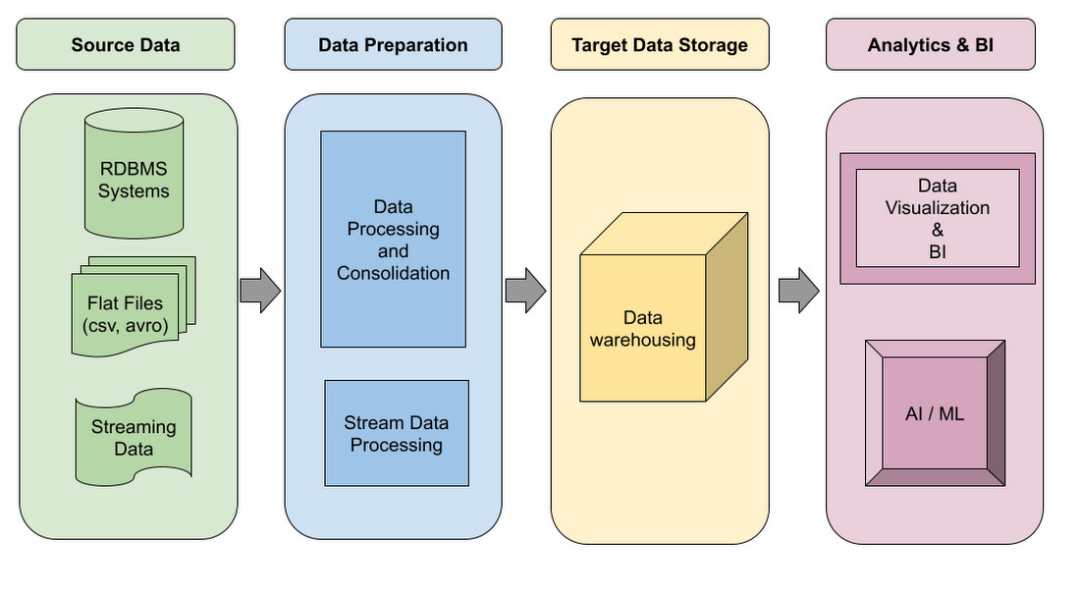

数据管道(Data Pipeline)是指数据从源头到最终目的地的整个传输和处理流程。它包括数据的采集、清洗、转换、加载等步骤。数据管道的作用主要体现在以下几个方面:

- **数据整合**:整合来自不同来源的数据,为数据处理和分析提供统一的接口。

- **数据质量控制**:通过清洗和转换步骤,保证数据的质量,提高分析结果的准确性。

- **自动化流程**:数据管道通常是自动化的,减少了人工干预,提高了效率。

- **可扩展性**:数据管道可以根据数据量和复杂性的增长而扩展,适应不断变化的需求。

### 2.2.2 数据管道在TensorFlow中的实现框架

在TensorFlow中,数据管道是通过Estimator API和tf.data模块来实现的。tf.data模块提供了一系列构建灵活、高效的数据管道的工具,使得数据输入到模型训练的整个过程可以被优化。

主要组件包括:

- **Dataset API**:TensorFlow中的Dataset API用于构建高效的数据输入管道,可以将多种数据源(如文本文件、CSV文件、数据库)转换成统一的Dataset对象。

- **数据转换**:对数据进行批处理、映射、并行读取等操作,提高数据处理的效率。

- **性能优化**:tf.data模块中的缓存和异步输入等功能,可以进一步优化数据管道的性能。

## 2.3 数据管道的设计原则和流程

### 2.3.1 设计高效数据管道的策略

设计一个高效的数据管道需要遵循以下策略:

- **最小化数据移动**:尽可能在接近数据存储的位置进行数据处理,减少数据在网络中的传输。

- **并行处理**:利用多线程或多进程进行数据读取和预处理,提高数据处理的吞吐量。

- **流水线化**:采用流水线的方式组织数据处理流程,保证各个环节可以连续工作,减少空闲时间。

- **弹性设计**:在设计数据管道时考虑系统的可扩展性,能够根据计算能力动态调整资源。

### 2.3.2 数据管道的典型流程分析

数据管道的典型流程包括以下几个步骤:

1. **数据采集**:从不同来源收集数据。

2. **数据清洗**:去除数据中的噪声和异常值,统一数据格式。

3. **数据转换**:将清洗后的数据转换为适合后续处理的格式。

4. **数据加载**:将处理后的数据加载到内存中,为分析和训练模型做准备。

流程图如下所示:

```mermaid

graph LR

A[数据采集] --> B[数据清洗]

B --> C[数据转换]

C --> D[数据加载]

D --> E[模型训练/数据分析]

```

每个步骤都需要仔细设计,以保证数据管道的效率和准确性。接下来的章节中,我们将深入探讨如何在TensorFlow中实践这些数据管道的设计策略和流程。

# 3. TensorFlow数据管道的实践技巧

随着大数据技术的不断发展,数据管道成为连接数据获取与数据处理之间不可或缺的一环。在TensorFlow框架中,数据管道的实践技巧不仅包括输入输出机制的设计,还包括数据预处理技术的应用和并行处理与性能优化。本章将详细介绍如何在TensorFlow中实践这些技巧,从而构建高效的大数据处理管道。

## 3.1 数据管道的输入输出机制

数据管道的首要任务是实现数据的输入和输出。这部分机制需要确保数据能够顺畅地流入处理流程,并且能够有效地输出到需要的地方。TensorFlow提供了丰富的工具来实现高效和可扩展的数据输入输出。

### 3.1.1 输入管道的构建和优化方法

在TensorFlow中,输入管道负责数据的读取、预处理和批量化。输入管道的构建直接影响到整个数据处理流程的效率和可扩展性。以下是构建高效输入管道的一些技巧:

- 使用`tf.data` API:TensorFlow的`tf.data` API提供了一种灵活的方式来构建复杂的数据输入管道。它允许开发者创建可重用的数据管道,这些数据管道可以轻松地进行批处理、缓存、映射和重复使用。

```python

import tensorflow as tf

# 使用tf.data创建输入管道

dataset = tf.data.Dataset.from_tensor_slices((data, labels))

dataset = dataset.map(preprocessing_function)

dataset = dataset.batch(batch_size)

dataset = dataset.repeat()

```

- 并行数据读取:为了避免数据输入成为瓶颈,TensorFlow支持多线程并行读取。通过设置`num_parallel_calls`参数,可以同时读取多个数据样本,显著提高输入效率。

```python

dataset = dataset.map(preprocessing_function, num_parallel_calls=tf.data.AUTOTUNE)

```

### 3.1.2 输出管道的设计与实现

输出管道负责将模型的预测结果导出到所需的位置,如文件系统、数据库或发送到另一个服务。有效的输出管道设计能够确保数据被正确地导出和使用。设计输出管道时,应该考虑以下几个方面:

- 数据导出格式:根据应用场景的不同,数据可能需要以不同的格式输出,如CSV、JSON、TFRecord等。TensorFlow提供了相应的方法来支持这些格式的输出。

```python

# 将预测结果保存为CSV文件

def export_to_csv(dataset, output_path):

writer = tf.data.experimental.CsvDatasetWriter(output_path, record_defaults)

for data, labels in dataset:

writer.write((data, labels))

```

- 异步导出:为了避免预测过程中的I/O延迟影响整体性能,可以使用异步的方式来写入数据。TensorFlow支持通过异步IO来实现这一点。

```python

# 使用异步方式写入数据

dataset = dataset.map(lambda data, labels: (data, labels), num_parallel_calls=tf.data.AUTOTUNE)

dataset = dataset.apply(tf.data.experim

```

0

0