【数据分析必备】:5分钟掌握异常检测技术,提升数据洞察力

发布时间: 2024-09-07 16:08:45 阅读量: 63 订阅数: 38

# 1. 异常检测技术概述

异常检测是数据科学中不可或缺的一部分,它在网络安全、金融欺诈检测、医疗健康数据分析等领域扮演着至关重要的角色。本章节旨在为读者提供对异常检测技术的初步认识,包括它的定义、应用领域和基本工作原理。

## 异常检测的定义与重要性

异常检测,或称为离群点检测,是指在数据集中识别出不符合预期模式的数据点。这些离群点可能代表了罕见事件、异常情况或错误,具有高度的业务价值。在商业和安全领域,快速准确地识别异常能够帮助预防重大损失。

## 应用领域

异常检测在多个行业有广泛应用,例如:

- 在金融行业,异常检测用于识别欺诈行为和市场操纵;

- 在网络安全领域,它帮助检测入侵活动和恶意软件;

- 在医疗健康数据分析中,异常检测可以提前预警某些疾病的发展趋势。

## 基本工作原理

异常检测的工作原理通常涉及以下三个步骤:

1. 数据预处理:清洗和转换数据,以便于分析;

2. 特征选择:确定哪些数据特征对检测异常最为重要;

3. 模型应用:使用统计方法、机器学习或深度学习算法来分析数据并识别异常点。

本章将为读者介绍异常检测的基础知识,并为后续章节中对更深入的理论和技术进行探讨奠定基础。

# 2. 异常检测的理论基础

异常检测是数据分析的重要组成部分,其目的是识别数据集中的异常或离群点。为了有效地进行异常检测,理解其理论基础至关重要。本章将探讨统计学和机器学习算法在异常检测中的应用,以及如何通过评价指标来衡量异常检测的性能。

### 2.1 统计学在异常检测中的应用

统计学提供了检测异常值的多种方法,它们依赖于数据集的统计特性。理解数据的分布和参数是识别异常值的关键。

#### 2.1.1 描述性统计与异常值判断

描述性统计通过汇总数据集的主要特性来描述数据,如均值、中位数、众数、方差、标准差等。异常值往往是与大多数数据点有显著差异的点。

例如,假设我们有一个数据集表示某个月的每日销售额。我们可以使用描述性统计来理解数据的中心趋势和分散程度,然后定义一个阈值(例如,均值加减三倍标准差),来判断哪些销售数据点可能属于异常。

```python

import numpy as np

# 假设数据集是每日销售额

sales_data = np.array([100, 120, 110, 130, 125, 135, 140, 130, 125, 115, 105, 108, 110, 109, 111, 98, 96, 95, 97, 100, 200, 210])

# 计算均值和标准差

mean_sales = np.mean(sales_data)

std_dev_sales = np.std(sales_data)

# 定义异常值判断阈值

threshold = mean_sales + 3 * std_dev_sales

# 判断并打印异常值

outliers = sales_data[sales_data > threshold]

print("异常值:", outliers)

```

在这段代码中,我们首先计算了销售额数据集的均值和标准差,然后设置了一个异常值判断的标准,即超出均值加三倍标准差的数据点。最后,我们找出了这些异常值并打印出来。

#### 2.1.2 假设检验与p值在异常检测中的角色

假设检验是统计学中一种用来判断数据是否支持某个假定结论的方法。在异常检测中,我们通常检验一个数据点是否符合数据集的分布假设。p值是在原假设成立的情况下,观察到当前样本统计量或更极端情况出现的概率。

例如,我们可能对数据集的正态分布进行假设检验,检验某个数据点是否不符合正态分布假设,即为异常值。如果p值低于我们设定的显著性水平(通常为0.05),我们拒绝原假设,认为该点为异常值。

```python

from scipy import stats

# 假设有一个数据点

single_point = 200

# 进行单尾检验

t_stat, p_value = stats.ttest_1samp(sales_data, single_point)

# 假设检验阈值

alpha = 0.05

# 判断并打印结果

if p_value < alpha:

print(f"数据点 {single_point} 是异常值(p值为 {p_value})")

else:

print(f"数据点 {single_point} 不是异常值(p值为 {p_value})")

```

在这段代码中,我们使用单样本t检验来判断一个特定的数据点是否属于同一分布。如果p值小于显著性水平(alpha),我们则判断该数据点为异常值。

### 2.2 机器学习算法简介

机器学习为异常检测提供了强大的算法,可以处理高维数据和复杂的模式识别任务。根据是否需要标注数据,这些算法可以分为监督式和无监督式。

#### 2.2.1 监督式学习与无监督式学习在异常检测中的差异

监督式学习在异常检测中需要一个已经标注好的数据集,其中包含正常和异常样本。这种方法可以训练一个分类器来识别新样本是否异常。

相比之下,无监督式学习不需要标注数据,它尝试发现数据中的模式和结构,从而检测出与这些模式不符的异常数据点。

```mermaid

graph LR

A[数据集] -->|监督式学习| B[训练分类器]

A -->|无监督式学习| C[数据结构和模式识别]

B --> D[新样本分类]

C --> E[检测异常点]

```

在上面的mermaid流程图中,我们可以看到监督式和无监督式学习在异常检测中的工作流程。监督式学习通过训练分类器对新样本进行分类,而无监督式学习通过识别数据中的模式来检测异常点。

#### 2.2.2 常见的机器学习算法和它们的特点

一些常见的机器学习算法包括支持向量机(SVM)、K最近邻(KNN)、决策树、随机森林等。

- **支持向量机(SVM)**:SVM是一种广泛使用的算法,特别是在高维空间中的分类问题。它通过寻找一个超平面来最大化数据点之间的边界,从而区分正常数据和异常数据。

- **K最近邻(KNN)**:KNN是基于实例的学习算法,它根据数据点的K个最近邻点的类别来预测该点的类别。它通常用于无监督学习场景,其中异常点将具有与周围邻居不同的类别。

- **决策树**:决策树通过一系列的问题来构建树形结构,每个内部节点表示对数据特征的测试,每个叶节点表示一个类别。它可以用于异常检测,通过训练模型来判断新样本是否异常。

- **随机森林**:随机森林是一种集成学习方法,它构建多个决策树并结合它们的预测。它适用于大规模数据集,并且具有良好的泛化能力。

```python

from sklearn.svm import OneClassSVM

from sklearn.neighbors import KNeighborsClassifier

from sklearn.tree import DecisionTreeClassifier

from sklearn.ensemble import RandomForestClassifier

# 数据集准备(模拟数据)

# 假设我们有一个已经标注好的数据集,其中0表示正常数据,1表示异常数据

X_train = np.random.rand(100, 5) # 特征数据

y_train = np.zeros(100) # 正常标签

y_train[5:] = 1 # 异常标签

# 分别使用SVM、KNN、决策树和随机森林进行异常检测模型的训练

# 这里我们只展示SVM模型的代码

svm_model = OneClassSVM(gamma='auto')

svm_model.fit(X_train)

# 使用模型预测新样本是否异常

new_sample = np.random.rand(1, 5)

if svm_model.predict(new_sample) == -1:

print("新样本是异常点")

else:

print("新样本是正常点")

```

在这段代码中,我们使用了一个简单的SVM模型作为示例,展示如何使用这个模型来检测新样本是否为异常点。我们只展示了SVM的训练和预测过程,但实际上KNN、决策树和随机森林的训练和预测过程也是类似的。

### 2.3 异常检测的评价指标

评价指标是衡量异常检测算法性能的关键。它们可以帮助我们理解算法在识别异常方面的能力。

#### 2.3.1 精确度、召回率与F1得分

- **精确度(Precision)**:精确度是正确预测的异常样本数与所有预测为异常样本数的比例。它衡量了模型对于所有预测为异常的数据中,真正异常的比例有多高。

- **召回率(Recall)**:召回率是指正确预测的异常样本数与实际异常样本总数的比例。它衡量了模型对于全部异常样本中,能够被正确识别的比例有多高。

- **F1得分**:F1得分是精确度和召回率的调和平均值,是衡量模型性能的一个综合指标。

```python

from sklearn.metrics import precision_score, recall_score, f1_score

# 假设y_true是真实的标签,y_pred是模型预测的标签

y_true = np.array([0, 0, 1, 0, 1, 1, 0, 0, 0, 1])

y_pred = np.array([0, 0, 1, 0, 0, 1, 0, 0, 0, 0])

# 计算精确度、召回率和F1得分

precision = precision_score(y_true, y_pred)

recall = recall_score(y_true, y_pred)

f1 = f1_score(y_true, y_pred)

print(f"精确度: {precision}")

print(f"召回率: {recall}")

print(f"F1得分: {f1}")

```

在这段代码中,我们使用sklearn库来计算精确度、召回率和F1得分,来衡量一个模型的性能。

#### 2.3.2 ROC曲线和AUC值的理解与应用

- **ROC曲线**:ROC(Receiver Operating Characteristic)曲线是通过不同阈值绘制的真正类率(TPR)与假正类率(FPR)的关系图。它展示了模型在不同分类阈值下的表现。

- **AUC值**:AUC(Area Under Curve)是ROC曲线下的面积,用于量化模型的分类能力。AUC值越接近1,模型的性能越好。

```python

from sklearn.metrics import roc_curve, auc

import matplotlib.pyplot as plt

# 假设我们有一个模型的预测概率和真实的标签

y_scores = np.array([0.1, 0.4, 0.35, 0.8])

y_true = np.array([0, 0, 1, 1])

# 计算ROC曲线和AUC值

fpr, tpr, thresholds = roc_curve(y_true, y_scores)

roc_auc = auc(fpr, tpr)

# 绘制ROC曲线

plt.figure()

plt.plot(fpr, tpr, color='darkorange', lw=2, label='ROC curve (area = %0.2f)' % roc_auc)

plt.plot([0, 1], [0, 1], color='navy', lw=2, linestyle='--')

plt.xlim([0.0, 1.0])

plt.ylim([0.0, 1.05])

plt.xlabel('False Positive Rate')

plt.ylabel('True Positive Rate')

plt.title('Receiver Operating Characteristic')

plt.legend(loc="lower right")

plt.show()

```

在这段代码中,我们首先使用`roc_curve`函数计算出ROC曲线的相关参数,然后使用`auc`函数计算出AUC值,并绘制出ROC曲线图。通过ROC曲线,我们可以直观地看到模型在不同阈值下的分类效果。

# 3. 常用异常检测技术实践

## 3.1 基于统计的方法

在异常检测领域中,统计方法是最基本也是最直观的技术之一。它主要依赖于数据的数学属性和分布特性来识别异常值。接下来将深入探讨两种统计方法:Z分数与IQR方法。

### 3.1.1 Z分数与IQR方法的实践

#### *.*.*.* Z分数方法

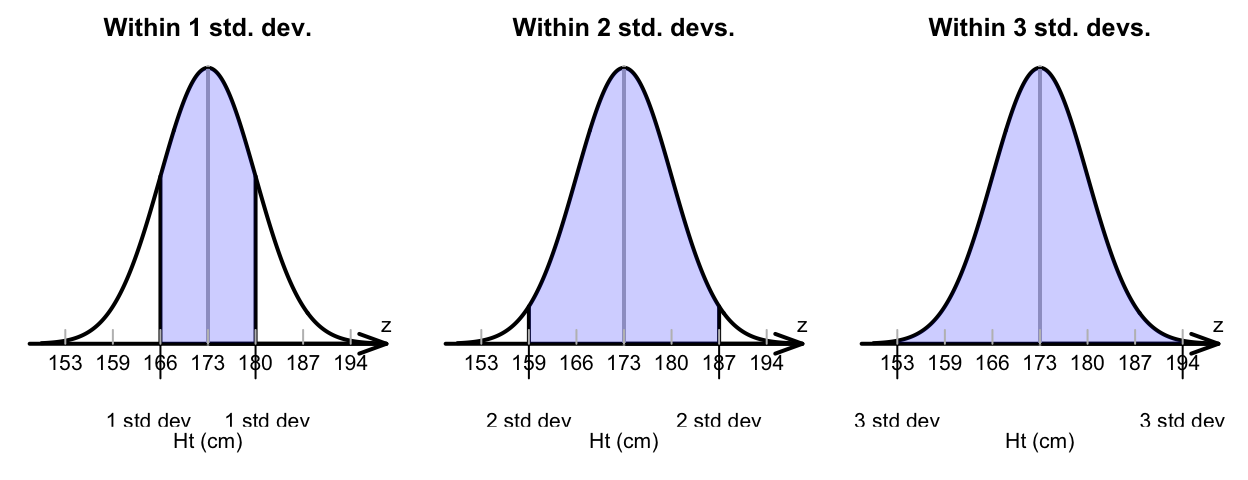

Z分数(或标准分数)是一种衡量数据点偏离其平均值的标准方法。它能够告诉我们一个数据点距离均值有多少标准差。该方法在假设数据呈正态分布时效果最佳。其计算公式为:

Z = (X - μ) / σ

其中,X是观察值,μ是均值,σ是标准差。

#### *.*.*.* IQR方法

四分位距(Interquartile Range,IQR)方法是另一种基于统计的异常值检测技术,主要用于衡量数据的离散程度。通过计算第三四分位数(Q3)与第一四分位数(Q1)之间的距离,然后找到“外群”数据点。一般认为,任何低于Q1 - 1.5 * IQR或高于Q3 + 1.5 * IQR的数据点都是异常值。

#### *.*.*.* 实践应用

为了演示Z分数和IQR方法的应用,我们使用Python中的pandas和scipy库进行数据分析:

```python

import pandas as pd

from scipy import stats

# 生成正态分布数据

data = pd.Series(stats.norm.rvs(size=1000))

# 应用Z分数方法

z_scores = (data - data.mean()) / data.std()

outliers_z = (abs(z_scores) > 3)

# 应用IQR方法

q1 = data.quantile(0.25)

q3 = data.quantile(0.75)

iqr = q3 - q1

outliers_iqr = (data < (q1 - 1.5 * iqr)) | (data > (q3 + 1.5 * iqr))

# 输出异常值

print(f"Z分数方法识别的异常值: {data[outliers_z].shape[0]}")

print(f"IQR方法识别的异常值: {data[outliers_iqr].shape[0]}")

```

#### *.*.*.* 结果分析

在这段代码中,我们首先生成了一组正态分布的数据,然后分别应用了Z分数和IQR方法来识别异常值。通过比较结果,我们可以发现两种方法识别出的异常值数量可能不同。在实际应用中,根据数据的特性和需求选择合适的方法。

### 3.1.2 时间序列数据的季节性分解

时间序列数据通常包含趋势、季节性和随机成分。对这些数据进行季节性分解,有助于我们识别非季节性的异常变化。

#### *.*.*.* 分解方法

季节性分解通常包括三个主要部分:趋势(T)、季节性(S)和残差(R)。分解方法有加法模型和乘法模型两种。加法模型适用于数据变化幅度相对稳定时,乘法模型适用于数据变化幅度与水平成正比时。

#### *.*.*.* 实践应用

下面是一个使用Python中的statsmodels库对时间序列数据进行季节性分解的示例:

```python

import pandas as pd

import matplotlib.pyplot as plt

from statsmodels.tsa.seasonal import seasonal_decompose

# 创建示例时间序列数据

index = pd.date_range('2020-01-01', freq='M', periods=24)

data = pd.Series(range(24) + np.random.normal(0, 1, 24), index=index)

# 应用季节性分解

result = seasonal_decompose(data, model='additive', period=12)

# 可视化结果

result.plot()

plt.show()

```

#### *.*.*.* 结果分析

通过季节性分解,我们能够分离出时间序列数据中的季节性、趋势和随机成分。这有助于我们更清楚地看到数据中的异常波动,特别是在排除了季节性影响之后。

## 3.2 基于机器学习的方法

在本章的第二部分中,我们将研究基于机器学习的异常检测技术,特别是K均值聚类和随机森林算法。

### 3.2.1 K均值聚类在异常检测中的运用

K均值聚类是一种常用的无监督学习算法,它将数据点根据相似性聚集成K个簇。异常点通常是那些离其最近簇的中心距离较远的点。

#### *.*.*.* K均值聚类算法

K均值算法的工作原理是首先随机选择K个数据点作为初始聚类中心,然后迭代地将数据点分配到最近的聚类中心,并重新计算每个聚类的中心,直至满足停止条件。

#### *.*.*.* 实践应用

下面是如何在Python中使用K均值聚类算法进行异常检测的示例:

```python

from sklearn.cluster import KMeans

import numpy as np

# 假设data是一个二维特征数组,其中包含我们的观测值

data = np.array([[1.0, 2.0], [1.5, 1.8], [5.0, 8.0], [8.0, 8.0], [1.0, 0.6]])

# 使用KMeans聚类

kmeans = KMeans(n_clusters=2, random_state=0).fit(data)

# 确定异常值

labels = kmeans.labels_

distances = kmeans.transform(data)

outliers = (distances[:, 1] > distances[:, 0] * 1.5).astype(bool)

# 输出异常值

print(f"异常值的索引: {np.where(outliers)[0]}")

```

#### *.*.*.* 结果分析

通过计算每个数据点到其最近聚类中心的距离,并与阈值进行比较,我们能够识别出异常点。在这个案例中,我们使用了一个简单的阈值比较方法,但在实际应用中,可能需要进行更复杂的计算和调整。

### 3.2.2 随机森林和孤立森林算法的比较与选择

随机森林和孤立森林是两种不同的算法,它们在异常检测中都有广泛的应用,但各有优势和局限。

#### *.*.*.* 随机森林算法

随机森林是一种集成学习方法,通过构建多个决策树,并将它们的预测结果进行投票或平均来提高准确率和防止过拟合。在异常检测中,随机森林可以利用特征的重要性评分来识别异常。

#### *.*.*.* 孤立森林算法

孤立森林是一种特别适合异常检测的算法。它的工作原理是随机选择特征和随机选择一个分裂值来进行“孤立”。异常点通常位于树的根部附近,因为它们更容易被孤立。

#### *.*.*.* 实践应用

这里我们使用Python的scikit-learn库比较随机森林和孤立森林在异常检测中的表现:

```python

from sklearn.ensemble import RandomForestRegressor

from sklearn.ensemble import IsolationForest

import numpy as np

# 创建数据

data = np.random.normal(0, 10, (100, 2))

outliers = np.random.normal(0, 100, (10, 2))

# 添加异常值到数据

data = np.vstack([data, outliers])

# 随机森林

rf = RandomForestRegressor(n_estimators=100, random_state=42)

rf.fit(data[:, :1])

rf.predict(data[:, :1])

# 孤立森林

iso = IsolationForest(random_state=42)

iso.fit(data[:, :1])

scores = iso.decision_function(data[:, :1])

# 输出结果

outliers_rf = rf.predict(outliers[:, :1])

outliers_iso = scores[-10:]

print(f"随机森林异常值评分: {outliers_rf}")

print(f"孤立森林异常值评分: {outliers_iso}")

```

#### *.*.*.* 结果分析

在这段代码中,我们首先创建了一个含有异常值的数据集。接着,我们分别应用了随机森林和孤立森林算法,并输出了两种算法对异常值的评分。通常情况下,异常值的评分将低于正常值,这一特性可以用于区分正常数据和异常数据。

## 3.3 实时异常检测系统构建

在本章节的最后部分,我们将探讨如何构建一个实时异常检测系统,重点在于实时数据流的处理技术和系统设计。

### 3.3.1 实时数据流的处理技术

实时数据流处理技术要求系统能够快速地处理和分析数据,以便迅速做出决策。这通常需要低延迟的数据处理框架。

#### *.*.*.* 处理框架

Apache Kafka和Apache Flink是目前比较流行的实时数据处理框架。Kafka主要用于数据流的传输,而Flink支持复杂的事件处理,特别适合实时分析。

#### *.*.*.* 实践应用

下面是一个使用Apache Flink进行实时异常检测的简单示例:

```python

from pyflink.datastream import StreamExecutionEnvironment

from pyflink.table import StreamTableEnvironment

from pyflink.table.descriptors import Schema, OldCsv, FileSystem

# 创建流执行环境

env = StreamExecutionEnvironment.get_execution_environment()

t_env = StreamTableEnvironment.create(env)

# 定义输入路径和模式

input_path = "path_to_input_stream"

input_schema = Schema()

input_schema.field("value", "INT")

input_schema.field("timestamp", "TIMESTAMP(3)")

# 定义输出路径和模式

output_path = "path_to_output_stream"

output_schema = Schema()

output_schema.field("timestamp", "TIMESTAMP(3)")

output_schema.field("is_anomaly", "BOOLEAN")

# 创建表描述符并连接到文件系统

t_env.connect(FileSystem().path(input_path)) \

.with_format(OldCsv()

.field("value", "INT")

.field_delimiter("\t")

.field("timestamp", "TIMESTAMP(3)")) \

.with_schema(Schema()

.field("value", "INT")

.field("timestamp", "TIMESTAMP(3)")) \

.create_temporary_table("input_table")

t_env.connect(FileSystem().path(output_path)) \

.with_format(OldCsv()

.field_delimiter("\t")

.field("timestamp", "TIMESTAMP(3)")

.field("is_anomaly", "BOOLEAN")) \

.with_schema(output_schema) \

.create_temporary_table("output_table")

# 实时异常检测逻辑(示例)

query = """

SELECT timestamp,

value > 1000 AS is_anomaly

FROM input_table

# 执行查询并输出结果

t_env.sql_query(query).insert_into("output_table")

# 启动流执行环境

env.execute("Real-time Anomaly Detection")

```

#### *.*.*.* 结果分析

在上述代码中,我们创建了一个简单的实时异常检测系统,通过设定阈值来判断数据是否异常,并将结果输出。这个例子虽然简单,但展示了实时数据处理框架的基本使用方法和实时异常检测的实现思路。

### 3.3.2 实时异常检测系统的设计与实现

实时异常检测系统的设计需要考虑到数据的实时性、系统的可伸缩性、容错性以及易用性。

#### *.*.*.* 系统架构

一个好的实时异常检测系统通常包含数据收集、数据存储、数据处理、模型训练和结果展示等模块。每个模块都需要精心设计,确保数据能够实时流动和处理。

#### *.*.*.* 关键特性

实时异常检测系统的关键特性包括数据的实时采集、快速的事件响应、准确的预测能力以及灵活的规则调整。

#### *.*.*.* 实践应用

为了实现一个高效、可靠的实时异常检测系统,需要采用合适的架构和工具。在实践中,可能需要自定义一些组件来满足特定的需求。比如,为了提高系统的容错性,可以引入消息队列来缓冲数据。

#### *.*.*.* 结果分析

设计和实现一个实时异常检测系统是一个复杂的过程,需要仔细规划和持续优化。通过不断收集反馈和监控系统性能,我们可以进一步优化系统的稳定性和效率。

至此,我们已经对基于统计和机器学习的异常检测技术进行了深入的探讨,并且了解了构建实时异常检测系统的基础知识。这些知识为我们后续深入理解和应用高级异常检测策略打下了坚实的基础。

# 4. 高级异常检测策略

随着数据量的不断增长以及数据复杂性的提升,传统的异常检测方法在某些场景下已难以满足需求。高级异常检测策略通常涉及深度学习技术、多维数据处理方法和强大的可视化技术,旨在提升检测的准确性和效率。

## 4.1 深度学习在异常检测中的应用

深度学习模型因其在模式识别和特征学习方面的能力而成为异常检测领域的新宠。其中一个值得关注的技术是自编码器,而生成对抗网络(GAN)同样在异常检测中显示出潜力。

### 4.1.1 自编码器的异常检测机制

自编码器是一种神经网络,其目的是通过学习输入数据的压缩表示来重建输入。异常检测中使用自编码器的基本思想是:正常数据可以通过训练好的自编码器有效地重建,而异常数据由于其与训练数据的统计分布差异较大,重建误差会显著增加。

自编码器通常由编码器和解码器两部分组成,编码器将输入数据压缩成低维表示,解码器再将这个表示解压缩回原始数据。训练完成后,如果新数据的重建误差大于预设的阈值,则可以认为该数据为异常。

```python

from keras.layers import Input, Dense

from keras.models import Model

# 设定输入数据维度

input_dim = 28 * 28

encoding_dim = 64

# 构建自编码器模型

input_img = Input(shape=(input_dim,))

encoded = Dense(encoding_dim, activation='relu')(input_img)

decoded = Dense(input_dim, activation='sigmoid')(encoded)

autoencoder = Model(input_img, decoded)

***pile(optimizer='adam', loss='binary_crossentropy')

# 自编码器的训练过程略去,假定模型已经训练完成并保存为autoencoder_model.h5

from keras.models import load_model

# 加载已训练的自编码器模型

autoencoder = load_model('autoencoder_model.h5')

import numpy as np

# 假定X_test是待检测的数据集,形状为(n_samples, 784)

X_test = np.random.random((100, input_dim))

# 重建数据并计算重建误差

decoded_imgs = autoencoder.predict(X_test)

reconstruction_error = np.mean(np.power(X_test - decoded_imgs, 2), axis=1)

```

在上述代码中,我们构建了一个简单的自编码器模型,并加载了一个已经训练好的模型。我们对一组测试数据进行重建,并计算每条数据的重建误差。这些误差可以帮助我们识别异常数据点。

### 4.1.2 利用生成对抗网络(GAN)进行异常检测

生成对抗网络(GAN)由生成器和判别器组成,生成器负责生成尽可能接近真实数据分布的数据,而判别器的任务是区分真实数据和生成的数据。在异常检测中,可以训练GAN识别数据集中的正常模式。正常数据可以通过GAN生成,异常数据则会因为与生成器学到的分布差异较大而被判别器检测为异常。

```python

from keras.layers import Dense, Reshape

from keras.models import Sequential

from keras.optimizers import Adam

# GAN结构的简单示例

def build_gan(generator, discriminator):

model = Sequential()

model.add(generator)

discriminator.trainable = False

model.add(discriminator)

return model

def build_discriminator(input_shape):

model = Sequential()

model.add(Dense(128, input_shape=input_shape, activation='relu'))

model.add(Dense(1, activation='sigmoid'))

***pile(optimizer=Adam(), loss='binary_crossentropy')

return model

# 假设input_shape是数据的形状

input_shape = (input_dim,)

discriminator = build_discriminator(input_shape)

discriminator.summary()

generator = build_generator() # 生成器模型由其它函数构建,这里省略

gan = build_gan(generator, discriminator)

***pile(optimizer=Adam(), loss='binary_crossentropy')

# GAN训练过程省略,假定模型已经训练完成并保存为gan_model.h5

# 加载训练完成的GAN模型

gan = load_model('gan_model.h5')

# 使用GAN进行异常检测

discriminator_output = gan.predict(X_test)

```

在上述代码中,我们构建了一个简单的GAN结构,并假设已经有了训练好的生成器和判别器。我们利用GAN模型来对测试数据进行异常检测,判别器的输出可以反映数据是否异常。

## 4.2 多维数据的异常检测技术

多维数据异常检测需要处理高维度空间中的数据点,这对传统方法提出了挑战。主成分分析(PCA)和基于密度的异常检测方法在处理这类数据时表现突出。

### 4.2.1 PCA在多维异常检测中的应用

主成分分析(PCA)是一种常用的数据降维方法,它通过线性变换将数据转换到新的坐标系统中,使得数据的方差最大。在PCA变换后,可以通过分析主成分的方差解释率来识别异常点。方差解释率低的主成分往往包含异常信息。

```python

import numpy as np

from sklearn.decomposition import PCA

# 假设X是已经标准化的多维数据集,维度较高

X = np.random.rand(100, 500)

# 应用PCA进行降维

pca = PCA(n_components=0.95) # 保留95%的方差

X_pca = pca.fit_transform(X)

# 分析主成分的方差解释率

explained_variance = pca.explained_variance_ratio_

# 输出方差解释率

print(explained_variance)

```

通过观察每个主成分的方差解释率,如果某个主成分的方差解释率远低于其他主成分,这可能是异常数据点的信号。

### 4.2.2 基于密度的异常检测方法

基于密度的异常检测方法,如局部异常因子(Local Outlier Factor,LOF),利用数据的空间局部密度来检测异常。在密度高的区域,数据点的局部异常因子接近1;在密度低的区域(异常点区域),该因子大于1。

```python

from sklearn.neighbors import LocalOutlierFactor

# 假设X是待检测的数据集

X = np.random.rand(100, 10)

# 初始化LOF模型

lof = LocalOutlierFactor(n_neighbors=20, contamination=0.1)

# 对数据集进行异常检测

labels = lof.fit_predict(X)

# 输出异常检测结果

print(labels)

```

在这个例子中,`labels`数组中的-1表示检测到的异常点,1表示正常点。`n_neighbors`参数定义了用于计算局部异常因子的邻居数,而`contamination`参数表示数据集中异常值的期望比例。

## 4.3 异常检测的可视化技术

异常检测结果的可视化可以帮助分析人员更直观地理解数据和检测出的异常。合适的数据可视化工具能够极大地简化对异常数据的理解和处理。

### 4.3.1 可视化工具的选择与使用

选择合适的可视化工具对于异常检测结果的展示至关重要。Matplotlib和Seaborn是两个广泛使用的Python可视化库,它们提供了丰富的图形功能,能够帮助数据科学家创建直观的图表来展示异常检测的结果。

```python

import matplotlib.pyplot as plt

import seaborn as sns

# 假设reconstruction_error是通过自编码器模型计算得到的重建误差

reconstruction_error = np.random.random(100)

# 使用Seaborn绘制重建误差的分布图

sns.set(style='whitegrid')

sns.distplot(reconstruction_error, hist=True, kde=False, bins=int(180/5), color='blue',

hist_kws={'linewidth': 15,'alpha': 1})

plt.title('Distribution of Reconstruction Error')

plt.xlabel('Reconstruction Error')

plt.ylabel('Frequency')

plt.show()

```

在上述代码中,我们使用Seaborn的`distplot`函数绘制了重建误差的分布图,从而直观地展示了异常点。

### 4.3.2 异常检测结果的可视化展示

除了分布图,散点图、箱型图等也可以用于展示异常检测的结果。例如,可以使用散点图在原始数据的空间中展示异常点和正常点的分布情况。

```python

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

# 假设X包含原始数据的两个特征

X = np.random.rand(100, 2)

# 假设labels包含100个数据点的异常检测结果

labels = np.random.choice([1, -1], 100)

# 将X和labels转换为DataFrame,便于使用Pandas的绘图功能

df = pd.DataFrame(X, columns=['Feature1', 'Feature2'])

df['Label'] = labels

# 绘制散点图展示异常点

sns.scatterplot(data=df, x='Feature1', y='Feature2', hue='Label', style='Label',

palette={1: 'green', -1: 'red'}, s=100, legend='full')

plt.title('Scatter plot of Data Points with Anomalies')

plt.show()

```

通过颜色和形状区分正常点和异常点,我们可以直观地看到异常点在数据集中的分布,这对于异常检测的进一步分析和决策非常有用。

通过这些可视化手段,异常检测的决策者能够更加清晰地把握异常点的分布情况和特点,从而做出更加科学的决策。

# 5. 异常检测案例分析

异常检测技术并非空中楼阁,它是基于真实世界的数据集和实际问题而存在的。为了更好地理解异常检测技术如何应用于实际,本章将深入探讨三个不同领域的案例分析:金融、网络安全和医疗健康数据。每个案例都会展示异常检测技术在解决特定问题中的实际应用,并分析实施过程中遇到的挑战与解决方案。

## 金融领域的异常检测案例

金融领域对于异常检测的需求尤其迫切,因为欺诈行为可能会造成巨大的经济损失。本小节将重点分析信用卡欺诈检测和股票市场异常行为识别两个具体案例。

### 5.1.1 信用卡欺诈检测的策略与技术

信用卡欺诈检测是金融领域中一个典型的异常检测应用场景。每当持卡人进行交易时,系统需要迅速判断该交易是否正常。使用异常检测技术,可以对历史数据进行学习,并识别出那些与正常模式不一致的行为。

#### 实践步骤

1. **数据收集**:首先,需要收集历史交易数据,包括交易金额、时间、地点、商家类型等信息。

2. **数据预处理**:对数据进行清洗,处理缺失值、异常值以及进行特征编码等。

3. **特征选择**:选择与欺诈行为最相关的特征,例如交易频率、交易地点的变化等。

4. **模型训练**:运用机器学习算法,如随机森林、梯度提升决策树等,来训练检测模型。

5. **模型评估**:使用交叉验证等技术对模型进行评估,特别是关注精确度、召回率和F1得分等指标。

6. **部署与监控**:将训练好的模型部署到生产环境,并持续监控其性能,确保检测系统的准确性。

#### 代码实现

下面是一个简单的随机森林模型用于信用卡欺诈检测的示例:

```python

from sklearn.ensemble import RandomForestClassifier

from sklearn.model_selection import train_test_split

from sklearn.metrics import classification_report

# 假设X是特征矩阵,y是标签,1表示欺诈行为,0表示正常交易

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 初始化随机森林分类器

clf = RandomForestClassifier(n_estimators=100, random_state=42)

clf.fit(X_train, y_train)

# 进行预测

predictions = clf.predict(X_test)

# 输出模型性能报告

print(classification_report(y_test, predictions))

```

在实际应用中,模型需要针对真实数据集进行调优,并结合业务知识对特征进行细致的选择。此外,信用卡欺诈检测模型需要能够处理不平衡数据,因为欺诈交易相对于正常交易来说通常是非常少的。

### 5.1.2 股票市场异常行为的识别方法

股票市场中的异常行为可能暗示着市场操纵、内幕交易或其他不正常现象。利用异常检测技术可以辅助监管机构监控市场动态,提前发现并处理不正常行为。

#### 实践步骤

1. **时间序列分析**:分析股票价格或交易量等时间序列数据,寻找异常波动。

2. **市场基准对比**:将特定股票的行为与市场基准指数进行对比分析,以识别异常。

3. **行为模式识别**:利用统计学方法,如Z分数和IQR,来识别异常点。

4. **机器学习辅助**:使用聚类算法如K均值或孤立森林来识别潜在的异常行为群组。

#### 代码实现

使用Python的`sklearn`库来实现基于聚类的异常行为识别:

```python

from sklearn.cluster import KMeans

from sklearn.preprocessing import StandardScaler

import pandas as pd

# 假设df是包含股票价格和交易量等特征的DataFrame

df = pd.read_csv('stock_data.csv')

# 特征标准化

scaler = StandardScaler()

df_scaled = scaler.fit_transform(df)

# 使用K均值聚类算法

kmeans = KMeans(n_clusters=3, random_state=42)

df['cluster'] = kmeans.fit_predict(df_scaled)

# 输出聚类结果中的异常行为群组(假设为最大群组)

print(df[df['cluster'] == df['cluster'].max()])

```

在上述代码中,我们首先对数据进行了标准化处理,然后使用K均值算法对数据进行聚类。聚类完成后,可以进一步分析每个群组中的数据,特别关注那些与其他数据有明显差异的群组。这可能暗示了异常行为的存在。

## 网络安全中的异常检测实践

网络安全是另一个异常检测技术应用的热点领域。本小节将探讨入侵检测系统的构建和针对DDoS攻击的异常检测案例。

### 5.2.1 入侵检测系统的构建与优化

入侵检测系统(IDS)旨在监控网络流量,以识别和响应可疑活动。构建高效的IDS需要融合多种技术和方法,包括异常检测技术。

#### 实践步骤

1. **网络流量数据收集**:记录网络流量数据,包括源IP、目的IP、端口号、传输协议等。

2. **流量特征提取**:从原始数据中提取有用的特征,例如数据包大小、传输速率、连接频率等。

3. **异常检测模型训练**:利用机器学习或深度学习模型来训练异常检测模型。

4. **实时检测与响应**:将训练好的模型部署到实时监控系统中,实现对潜在攻击行为的即时检测与响应。

#### 代码实现

这里是一个使用孤立森林算法进行网络流量异常检测的简单示例:

```python

from sklearn.ensemble import IsolationForest

import pandas as pd

from sklearn.metrics import classification_report

# 加载数据集

df = pd.read_csv('network_traffic.csv')

# 特征提取(示例中已经完成)

# features = extract_features(df)

# 初始化孤立森林模型

clf = IsolationForest(n_estimators=100, contamination=0.01, random_state=42)

# 训练模型

clf.fit(df)

# 预测

predictions = clf.predict(df)

# 输出分类报告

print(classification_report(df['actual_label'], predictions))

```

### 5.2.2 针对DDoS攻击的异常检测案例

分布式拒绝服务攻击(DDoS)是一种常见的网络攻击方式,它通过发送大量请求到目标服务器,使其无法处理合法用户的请求。对于DDoS攻击,异常检测技术可以作为一种有效的防御手段。

#### 实践步骤

1. **流量监控**:持续监控进出网络的数据包。

2. **异常模式识别**:使用统计和机器学习方法识别流量中的异常模式。

3. **阈值设定**:设定合理的阈值,用于触发警报机制。

4. **实时响应机制**:一旦检测到异常模式,实时响应并采取措施。

#### 代码实现

对于DDoS攻击的异常检测,可以使用基于密度的方法来识别异常的流量模式:

```python

from sklearn.neighbors import LocalOutlierFactor

import numpy as np

# 假设df是包含流量特征的DataFrame

X = df[['packets_per_second', 'connections_per_second']]

# 初始化局部异常因子模型

clf = LocalOutlierFactor(n_neighbors=20, contamination=0.01)

# 拟合模型并预测

scores = clf.fit_predict(X)

outliers = X[scores == -1]

# 输出异常检测结果

print(outliers)

```

在此代码段中,我们使用`LocalOutlierFactor`方法来识别网络流量中的异常点。参数`n_neighbors`表示局部区域的邻近点数,`contamination`是数据集中异常值的比例。该方法特别适用于检测局部密度异常变化的场景,如DDoS攻击。

## 医疗健康数据分析中的异常检测

在医疗领域,异常检测技术可以用于分析病人的健康状况,以便早期发现疾病并采取治疗措施。本小节将介绍医疗数据的异常检测重要性以及基于异常检测的早期疾病预警系统。

### 5.3.1 医疗数据的异常检测重要性

医疗数据通常包括患者的生理参数(如心率、血压)、生化指标(如血红蛋白、血糖水平)等。对这些数据进行异常检测具有重要的临床意义,它可以帮助医生及早识别出异常体征,并作出相应的诊断和治疗。

#### 实践步骤

1. **数据收集**:从医疗机构的数据库中收集相关的医疗记录。

2. **数据预处理**:进行数据清洗,确保数据质量。

3. **特征工程**:提取与疾病相关的特征,并进行标准化处理。

4. **模型训练与评估**:使用适合的机器学习算法进行模型训练,并评估其性能。

5. **模型部署**:将经过验证的模型部署到医院的临床辅助决策系统中。

### 5.3.2 基于异常检测的早期疾病预警系统

早期疾病预警系统对于提高患者的生存率和生活质量至关重要。通过对病人的健康数据进行实时监控,异常检测技术可以预警那些偏离正常生理范围的健康指标。

#### 实践步骤

1. **实时数据采集**:使用穿戴式设备或医院设备实时采集患者的健康数据。

2. **异常检测算法应用**:运用统计学方法或机器学习算法对采集的数据进行分析。

3. **阈值设定与警报机制**:根据专家知识设定合理的健康指标阈值,并建立预警机制。

4. **临床验证与优化**:与临床医生合作,验证预警系统的准确性和实用性,并根据反馈进行优化。

#### 代码实现

这里提供一个简单的使用滑动窗口统计方法进行健康数据异常检测的示例:

```python

import numpy as np

import pandas as pd

# 假设df是包含患者健康数据的DataFrame,'heart_rate'是心率数据列

df = pd.read_csv('patient_data.csv')

# 使用滑动窗口计算心率的均值和标准差

df['rolling_mean'] = df['heart_rate'].rolling(window=10).mean()

df['rolling_std'] = df['heart_rate'].rolling(window=10).std()

# 异常阈值设定(根据历史数据统计结果设定)

upper_threshold = 1.5 * df['rolling_std'] + df['rolling_mean']

lower_threshold = -1.5 * df['rolling_std'] + df['rolling_mean']

# 标记异常值

df['is_outlier'] = (df['heart_rate'] > upper_threshold) | (df['heart_rate'] < lower_threshold)

# 输出异常检测结果

print(df[df['is_outlier']])

```

以上代码利用滑动窗口计算心率的动态均值和标准差,并设定异常阈值。任何超出阈值范围的心率数据点都会被标记为异常。

异常检测技术在医疗健康数据分析中具有广阔的应用前景。随着可穿戴设备的普及和医疗数据量的增加,这些技术将变得越来越重要,并有望成为未来医疗健康领域不可或缺的一部分。

通过本章的案例分析,我们已经看到异常检测技术是如何在不同领域解决实际问题的。这些案例涉及多个行业,从金融到网络安全再到医疗健康,异常检测都有其独特的应用方式和挑战。在接下来的章节中,我们将深入探讨异常检测技术的未来趋势和可能的发展方向,以期为读者提供更广阔的视角和启发。

# 6. 异常检测的自动化与智能化优化

## 6.1 自动化异常检测的优势与实践

在面对日益增长的数据量和多样性时,自动化异常检测成为必要手段,它能够大幅提高检测效率和准确性,减少人为干预,提升系统的响应速度和处理能力。自动化异常检测的优势主要体现在以下几个方面:

- **减少人工干预**:自动化系统能够24/7不间断运行,减少对人工操作的依赖。

- **实时性**:可以实时监控数据流,迅速识别并响应异常事件。

- **一致性**:避免了因个人经验不同而带来的判断差异。

- **规模性**:自动化系统可以处理海量数据,适用于大数据环境。

在实践层面,自动化异常检测系统通常需要包含以下几个关键组件:

- **数据接入与预处理模块**:负责实时采集数据,并进行必要的清洗和转换。

- **特征提取与选择模块**:从原始数据中提取有助于异常检测的特征,并进行特征选择。

- **模型训练与更新模块**:基于最新的数据和反馈不断优化模型。

- **异常检测与决策模块**:运用训练好的模型对实时数据进行检测,并作出决策。

- **告警与响应机制**:一旦检测到异常,系统会即时通知相关人员或系统,并采取相应的应对措施。

## 6.2 智能化优化策略在异常检测中的应用

智能化优化策略是指通过集成先进的算法和智能学习技术来不断改进异常检测系统的性能。这些策略通常包括以下几个方面:

- **模型自我调整**:基于反馈循环,系统能够自动调整算法参数或选择更优的模型结构。

- **持续学习**:系统能够从新的数据中学习,不断更新知识库,以适应数据变化的趋势。

- **多模型集成**:利用多种异常检测模型的互补性,通过集成学习提升整体性能。

- **上下文感知**:结合领域知识和上下文信息,使检测更加精准。

在智能化优化策略的实际应用中,我们可以考虑以下步骤:

1. **实时数据收集与分析**:收集各类实时数据源,分析其特征和分布。

2. **动态模型选择**:根据数据类型和特征,实时选择合适的检测模型。

3. **在线学习与模型更新**:使用在线学习算法,如小批量梯度下降、在线集成学习等,根据新数据实时更新模型。

4. **智能决策与告警系统**:基于检测结果,智能决策系统可以决定是否触发告警,并采取进一步的行动。

## 6.3 智能化异常检测系统的构建

构建一个智能化的异常检测系统需要结合最新的AI技术和数据处理能力。一个典型的智能化异常检测系统的构建流程如下:

1. **数据准备**:包含数据采集、清洗、预处理等步骤。

2. **特征工程**:确定最佳的特征组合来表征数据。

3. **模型选择与训练**:选取适合的算法进行模型训练。

4. **模型评估与优化**:使用交叉验证、网格搜索等方法,评估模型性能并进行优化。

5. **集成学习策略**:将多个模型的预测结果集成,提升异常检测的精度。

6. **自动化与智能化优化**:实现模型自动更新、参数自动调整等智能化功能。

7. **部署与监控**:将模型部署至生产环境,并设置监控机制以跟踪系统性能。

在构建智能化异常检测系统时,还需要关注以下几个方面:

- **系统灵活性**:系统应能快速适应新场景和新数据。

- **可解释性**:模型的决策过程应该是可解释的,以便于后续的审计和优化。

- **隐私与合规**:确保系统遵守相关法律法规,特别是数据隐私保护。

以上就是关于异常检测在自动化与智能化优化方面的详细讨论。这些先进的技术不仅能够帮助我们更加高效地处理异常,还能够在数据驱动的决策中提供强大的支持。随着技术的不断进步,我们可以预见异常检测将会在各个领域发挥更加重要的作用。

0

0