文本分析中的自组织映射(SOM):文本理解的秘密武器

发布时间: 2024-08-21 06:32:54 阅读量: 34 订阅数: 25

# 1. 文本分析概述

文本分析是利用计算机技术对文本数据进行处理、分析和理解的过程,旨在提取文本中的有用信息和知识。文本分析在各个领域都有着广泛的应用,例如自然语言处理、信息检索、文本挖掘和机器翻译等。

文本分析技术主要包括文本预处理、文本向量化、文本聚类、文本分类、文本情感分析等。文本预处理是对文本数据进行清洗和转换,以去除噪声和冗余信息,为后续分析做好准备。文本向量化是将文本数据转换为计算机可处理的数值形式,以便进行机器学习和数据挖掘。文本聚类是将文本数据划分为不同的组,以便发现文本之间的相似性和差异性。文本分类是将文本数据归类到预先定义的类别中,以便进行文本分类和预测。文本情感分析是识别和分析文本中表达的情感和态度,以便进行情感分析和舆情监测。

# 2. 自组织映射(SOM)理论基础

### 2.1 SOM的原理和算法

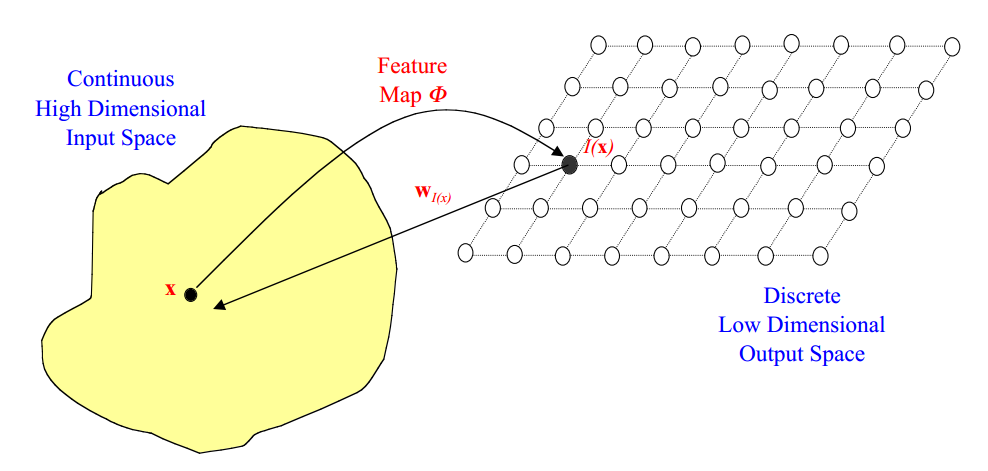

自组织映射(SOM)是一种无监督学习算法,它可以将高维数据映射到低维空间(通常是二维或三维),同时保留输入数据的拓扑结构。SOM的原理是通过竞争学习,将数据样本分配到输出空间中的神经元,并不断调整神经元的权重,使相似的样本映射到相邻的神经元。

SOM算法的步骤如下:

1. **初始化:**随机初始化输出空间中的神经元权重。

2. **选择:**从训练集中随机选择一个样本。

3. **竞争:**计算每个神经元与样本之间的距离,并选择距离最小的神经元作为获胜神经元。

4. **合作:**更新获胜神经元及其邻域内神经元的权重,使它们更接近样本。

5. **重复:**重复步骤2-4,直到满足停止条件(例如,达到最大迭代次数或误差收敛)。

### 2.2 SOM的拓扑结构和学习规则

**拓扑结构:**

SOM通常采用网格或六边形结构,其中每个神经元与相邻的神经元连接。这种拓扑结构可以保留输入数据的拓扑关系。

**学习规则:**

SOM使用高斯邻域函数来更新神经元的权重,该函数定义了神经元之间的影响范围。权重更新规则如下:

```python

w_ij(t+1) = w_ij(t) + α(t) * h_ij(t) * (x_i(t) - w_ij(t))

```

其中:

* `w_ij` 是神经元 `i` 在特征 `j` 上的权重

* `α(t)` 是学习率,随着时间递减

* `h_ij(t)` 是高斯邻域函数,定义为:

```

h_ij(t) = exp(-||r_i - r_j||^2 / (2σ^2(t)))

```

其中:

* `r_i` 和 `r_j` 是神经元 `i` 和 `j` 的位置

* `σ(t)` 是邻域宽度,随着时间递减

通过不断更新权重,SOM可以将相似的样本映射到相邻的神经元,形成一个拓扑映射。

# 3.1 文本预处理和向量化

在将文本数据输入 SOM 模型之前,需要对其进行预处理和向量化。文本预处理的目的是去除文本中的噪声和不相关信息,从而提高模型的性能。

#### 文本预处理

文本预处理通常包括以下步骤:

1. **分词:**将文本拆分为单个单词或词组。

2. **停用词去除:**删除常见的无意义单词,如“the”、“of”、“and”。

3. **词干化:**将单词还原为其词根,以减少单词变体的影响。

4. **正则化:**将单词转换为小写,并去除标点符号和特殊字符。

#### 文本向量化

文本向量化是将预处理后的文本转换为数字向量的过程。这对于 SOM 模型至关重要,因为它允许模型将文本数据映射到高维空间中。常用的文本向量化技术包括:

1. **词袋模型:**将文本表示为单词的集合,每个单词的权重为其在文本中出现的次数。

2. **TF-IDF 模型:**考虑单词在文本和语料库中的频率,赋予罕见单词更高的权重。

3. **Word2Vec 模型:**使用神经网络学习单词的分布式表示,捕获单词之间的语义关系。

### 3.2 SOM对文本的聚类和可视化

SOM 是一种无监督学习算法,可以将高维数据映射到低维(通常是二维)空间中。这使得它非常适合对文本进行聚类和可视化。

#### 聚类

SOM 可以将文本数据聚类为相似组。每个簇代表文本中的一组相关主题或概念。聚类过程涉及以下步骤:

0

0