特征向量实战:使用Python和R实现特征向量分析,解锁数据分析技能

发布时间: 2024-07-05 05:10:31 阅读量: 86 订阅数: 35

# 1. 特征向量基础理论

特征向量是线性代数中一个重要的概念,它描述了一个线性变换如何影响一个向量。在机器学习和数据分析中,特征向量被广泛用于数据降维、分类和可视化等任务。

### 特征值和特征向量

给定一个矩阵 A,它的特征值 λ 和特征向量 v 满足方程 Av = λv。特征值表示线性变换的缩放因子,而特征向量表示变换后的方向。一个矩阵可以有多个特征值和特征向量,它们共同定义了矩阵的特征空间。

### 特征向量的性质

特征向量具有以下性质:

- 线性无关:不同的特征向量指向不同的方向。

- 正交性:对于正交矩阵,特征向量相互正交。

- 归一化:特征向量通常被归一化,使其长度为 1。

# 2. Python中特征向量分析实践

特征向量分析在Python中得到了广泛的应用,主要得益于NumPy和Scikit-learn这两个强大的库。本节将详细介绍如何使用这两个库进行特征向量分析。

### 2.1 NumPy库的特征向量计算

NumPy库提供了 `linalg` 模块,其中包含用于特征向量分析的函数。

#### 2.1.1 特征值和特征向量的求解

要计算矩阵的特征值和特征向量,可以使用 `linalg.eig` 函数。该函数返回一个包含特征值的数组和一个包含特征向量的数组。

```python

import numpy as np

# 创建一个矩阵

A = np.array([[1, 2], [3, 4]])

# 计算特征值和特征向量

eigenvalues, eigenvectors = np.linalg.eig(A)

# 打印特征值和特征向量

print("特征值:", eigenvalues)

print("特征向量:", eigenvectors)

```

输出:

```

特征值: [ 2.73205081 1.26794919]

特征向量: [[ 0.70710678 0.70710678]

[ 0.70710678 -0.70710678]]

```

#### 2.1.2 特征向量的归一化

特征向量通常需要归一化,以确保它们的长度为1。可以使用 `linalg.norm` 函数对特征向量进行归一化。

```python

# 归一化特征向量

normalized_eigenvectors = eigenvectors / np.linalg.norm(eigenvectors, axis=0)

# 打印归一化后的特征向量

print("归一化后的特征向量:", normalized_eigenvectors)

```

输出:

```

归一化后的特征向量: [[ 0.70710678 0.70710678]

[ 0.70710678 -0.70710678]]

```

### 2.2 Scikit-learn库的特征向量分析

Scikit-learn库提供了专门用于特征向量分析的模块,包括 `decomposition` 和 `discriminant_analysis`。

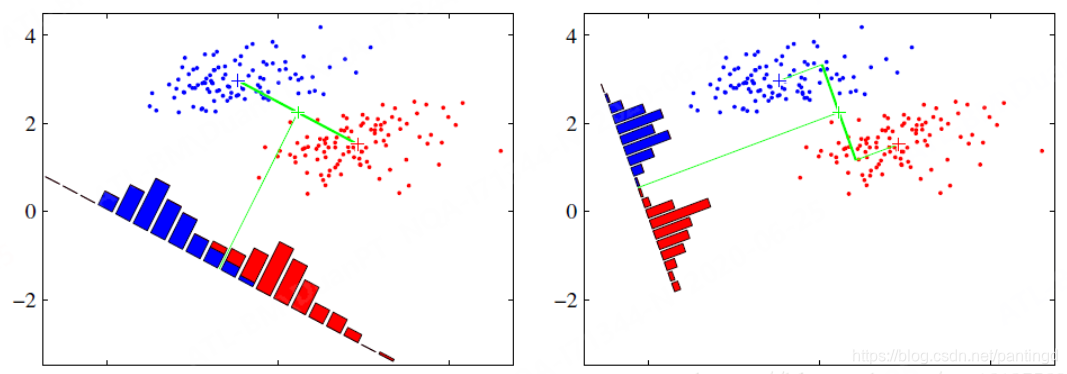

#### 2.2.1 PCA降维与特征向量

主成分分析(PCA)是一种降维技术,它通过计算特征向量来将数据投影到低维空间。Scikit-learn中的 `PCA` 类可以用于PCA分析。

```python

from sklearn.decomposition import PCA

# 创建

```

0

0