GBM梯度提升机在决策树集成中的作用:提升模型泛化能力,增强预测准确性

发布时间: 2024-08-21 19:04:09 阅读量: 13 订阅数: 13

# 1. 决策树集成概述**

决策树集成是一种机器学习技术,它通过将多个决策树模型组合起来,以提高模型的预测性能。决策树集成可以显著提升模型的泛化能力,增强预测准确性,在各种机器学习任务中得到广泛应用。

决策树集成背后的基本思想是:通过组合多个决策树模型,可以减少单个决策树模型的偏差和方差。偏差是指模型预测值与真实值之间的系统性差异,而方差是指模型预测值的随机波动。通过集成多个决策树模型,我们可以降低偏差和方差,从而提高模型的整体预测性能。

# 2.1 GBM算法原理

GBM(Gradient Boosting Machine)梯度提升机是一种集成学习算法,它通过迭代地训练弱学习器(决策树)来构建强学习器。

GBM算法的基本原理如下:

1. **初始化:**初始化一个常数模型,作为预测值。

2. **迭代:**

- 对于第m次迭代:

- 计算当前模型的负梯度,即残差。

- 使用残差作为训练目标,训练一个新的弱学习器(决策树)。

- 将新弱学习器的预测值添加到当前模型中,更新模型预测值。

3. **重复步骤2,直到达到最大迭代次数或其他停止条件。**

GBM算法通过迭代地拟合残差,逐步提升模型的预测能力。

### 2.1.1 决策树弱学习器

GBM中使用的弱学习器通常是决策树。决策树是一种非参数监督学习算法,它将数据递归地分割成更小的子集,直到满足停止条件。

在GBM中,决策树的停止条件通常是达到最大深度或叶子节点中的样本数小于某个阈值。

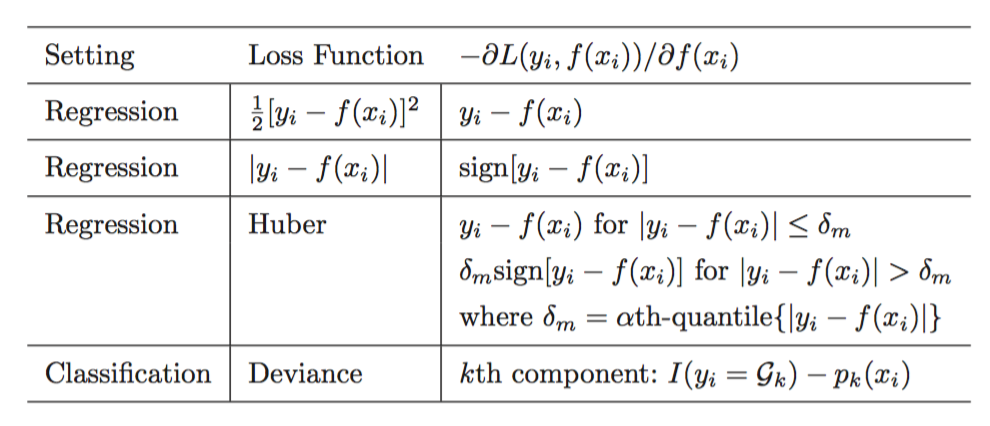

### 2.1.2 负梯度计算

GBM算法的关键步骤之一是计算负梯度。负梯度表示当前模型预测值与真实值之间的残差。

对于第m次迭代,负梯度计算公式为:

```

r_m(x) = -[y - f_m-1(x)]

```

其中:

- r_m(x) 表示第m次迭代的负梯度。

- y 表示真实值。

- f_m-1(x) 表示第m-1次迭代的模型预测值。

### 2.1.3 模型更新

计算出负梯度后,GBM算法将训练一个新的弱学习器(决策树)来拟合负梯度。

新弱学习器的预测值添加到当前模型中,更新模型预测值:

```

f_m(x) = f_m-1(x) + alpha * h_m(x)

```

其中:

- f_m(x) 表示第m次迭代的模型预测值。

- alpha 是学习率,用于控制新弱学习器的影响。

- h_m(x) 表示第m次迭代的弱学习器(决策树)的预测值。

# 3.1 提升模型泛化能力

GBM通过集成多棵决策树,有效提升了模型的泛化能力。泛化能力是指模型在未知数据上的预测性能。单棵决策树容易出现过拟合问题,即模型在训练集上表现良好,但在未知数据上表现不佳。这是因为单棵决策树过于关注训练数据的局部特征,导致模型对噪声和异常值敏感。

GBM通过集成多棵决策树,可以有效缓解过拟合问题。集成后的模型具有以下优点:

* **降低方差:**每棵决策树的预测结果存在一定的随机性,集成后取平均值可以降低预测结果的方差。

* **增加偏差:**集成后的模型比单棵决策树更加复杂,可以捕捉到训练数据中更多的特征信息,从而增加模型的偏差。

偏差和方差的平衡是机器学习模型的关键,GB

0

0