LSTM 模型在图像描述生成(Image Captioning)中的应用

发布时间: 2024-05-01 23:16:32 阅读量: 142 订阅数: 84

# 1.1 LSTM模型的结构与原理

LSTM(Long Short-Term Memory)模型是一种循环神经网络(RNN),专为解决RNN中存在的长期依赖问题而设计。它由霍赫莱特和施密德霍夫在1997年提出,通过引入记忆单元和门控机制,可以有效地学习和记忆长期依赖关系。

LSTM模型的基本结构如下图所示:

```mermaid

graph LR

subgraph LSTM单元

A[输入门] --> B[记忆单元]

C[遗忘门] --> D[输出门]

B --> D

end

```

LSTM单元主要由三个门控机制组成:

- **输入门(Input Gate):**控制新信息的输入,决定哪些信息将被添加到记忆单元中。

- **遗忘门(Forget Gate):**控制记忆单元中信息的遗忘,决定哪些信息将被丢弃。

- **输出门(Output Gate):**控制记忆单元中信息的输出,决定哪些信息将被作为模型的输出。

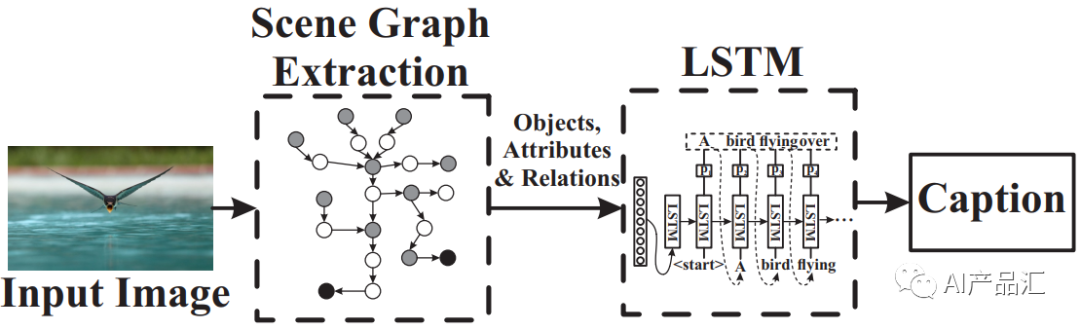

# 2. 图像描述生成中的LSTM模型应用

LSTM(长短期记忆)模型是一种强大的神经网络架构,在图像描述生成任务中表现出色。它能够有效地捕获图像的视觉特征并生成连贯且信息丰富的描述。

### 2.1 LSTM模型的图像特征提取

#### 2.1.1 卷积神经网络(CNN)

CNN是一种深度学习模型,专门用于处理网格状数据,如图像。它通过一系列卷积层和池化层提取图像的特征。卷积层使用卷积核在图像上滑动,检测局部模式。池化层通过对相邻像素进行聚合,减少特征图的尺寸。

**代码示例:**

```python

import tensorflow as tf

# 定义输入图像

input_image = tf.keras.layers.Input(shape=(224, 224, 3))

# 定义卷积层

conv1 = tf.keras.layers.Conv2D(32, (3, 3), activation='relu')(input_image)

conv2 = tf.keras.layers.Conv2D(64, (3, 3), activation='relu')(conv1)

# 定义池化层

pool1 = tf.keras.layers.MaxPooling2D((2, 2))(conv2)

pool2 = tf.keras.layers.MaxPooling2D((2, 2))(pool1)

# 输出特征图

features = pool2

```

**逻辑分析:**

* `input_image` 是输入图像,形状为 (224, 224, 3),其中 224x224 是图像的分辨率,3 是通道数(RGB)。

* `conv1` 和 `conv2` 是卷积层,分别使用 3x3 的卷积核提取图像的特征。

* `pool1` 和 `pool2` 是池化层,对特征图进行最大池化,以减少尺寸。

* `features` 是输出的特征图,包含图像的视觉特征。

#### 2.1.2 循环神经网络(RNN)

RNN是一种神经网络,专门用于处理序列数据。它通过将当前输入与前一个时间步的隐藏状态结合起来,捕获序列中的时间依赖性。LSTM是一种特殊的RNN,它使用记忆单元来存储长期依赖性。

**代码示例:**

```python

# 定义LSTM层

lstm = tf.keras.layers.LSTM(128, return_sequences=True)(features)

# 输出序列特征

sequence_features = lstm

```

**逻辑分析:**

* `lstm` 是LSTM层,它将特征图序列作为输入,并输出一个序列特征。

* `return_sequences=True` 表示LS

0

0