LSTM 模型在机器翻译领域的常见问题探讨

发布时间: 2024-05-01 23:02:14 阅读量: 75 订阅数: 84

# 1. LSTM模型概述**

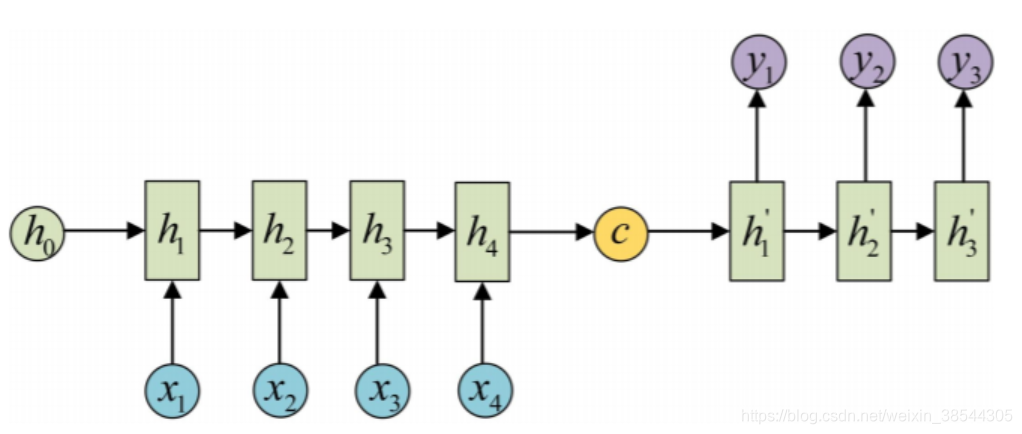

LSTM(长短期记忆)模型是一种循环神经网络(RNN),专门设计用于处理序列数据。它通过引入记忆单元来克服传统RNN在处理长期依赖关系方面的不足。LSTM模型由输入门、遗忘门和输出门组成,这些门控制着信息的流入、遗忘和输出。LSTM模型的优势在于其能够学习长期依赖关系,同时避免梯度消失和梯度爆炸问题。在机器翻译领域,LSTM模型已成为一种流行的技术,因为它能够有效地处理语言序列,并生成流畅、准确的翻译结果。

# 2. LSTM模型在机器翻译中的应用

### 2.1 LSTM模型在机器翻译中的优势

LSTM(长短期记忆网络)模型是一种强大的神经网络模型,在机器翻译领域取得了显著的成功。与传统机器翻译模型相比,LSTM模型具有以下优势:

- **记忆力长:**LSTM模型具有记忆长期依赖关系的能力,这对于翻译长句和复杂句非常重要。

- **处理顺序信息:**LSTM模型可以处理序列信息,这对于机器翻译中处理单词顺序至关重要。

- **捕获上下文:**LSTM模型可以捕获单词之间的上下文关系,从而生成更流畅、更准确的翻译。

### 2.2 LSTM模型在机器翻译中的挑战

尽管LSTM模型在机器翻译中表现出色,但仍面临一些挑战:

- **计算成本高:**LSTM模型的训练和推理计算成本都很高,这限制了其在实际应用中的规模。

- **过拟合:**LSTM模型容易过拟合训练数据,导致在测试数据上性能下降。

- **梯度消失:**在训练深度LSTM模型时,梯度可能会消失,导致模型难以学习。

#### 代码示例:

```python

import tensorflow as tf

# 定义LSTM模型

lstm_model = tf.keras.models.Sequential([

tf.keras.layers.LSTM(128, return_sequences=True),

tf.keras.layers.LSTM(128),

tf.keras.layers.Dense(len(target_vocab))

])

# 编译模型

lstm_model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy'])

# 训练模型

lstm_model.fit(source_data, target_data, epochs=10)

```

#### 代码逻辑分析:

该代码定义了一个LSTM模型,用于机器翻译。模型包含两个LSTM层,每个层有128个单元。第一个LSTM层返回序列,而第二个LSTM层返回单个向量。然后,一个稠密层将向量转换为目标词汇表的长度。模型使用Adam优化器和稀疏分类交叉熵损失函数进行编译。最后,模型在源数据和目标数据上训练了10个时期。

#### 参数说明:

- `source_data`:源语言数据。

- `target_data`:目标语言数据。

- `epochs`:训练时期数。

# 3. LSTM模型在机器翻译中的常见问题

### 3.1 过拟合问题

#### 3.1.1 过拟合产生的原因

过拟合问题是指模型在训练集上表现良好,但在测试集上表现不佳。这通常是由于模型学习了训练集中的特定噪声和异常值,而不是学习数据的底层模式。

在机器翻译中,过拟合可能由以下原因引起:

- **训练数据不足:**训练数据太少或不具有代表性,导致模型无法泛化到新数据。

- **模型过于复杂:**模型包含太多参数或层,导致它可以拟合训练集中的噪声。

- **正则化不足:**没有使用正则化技术(例如 L1 或 L2 正则化)来防止模型过拟合。

#### 3.1.2 过拟合的解决方法

解决机器翻译中的过拟合问题可以采取以下方法:

- **增加训练数据:**收集更多的数据,并确保数据具有代表性。

- **简化模型:**减少模型的参数数量或层数,以降低其复杂性。

- **使用正则化技术:**应用正则化技术,例如 L1 或 L2 正则化,以惩罚模型对噪声的拟合。

- **早期停止:**在训练过程中,监控模型在验证集上的性能,并在验证集性能不再提高时停止训练。

### 3.2 梯度消失问题

#### 3.2.1 梯度消失产生的原因

梯度消失问题是指在反向

0

0