多元线性回归岭回归实战指南:解决共线性问题的利器,提升模型泛化能力

发布时间: 2024-06-09 06:33:45 阅读量: 98 订阅数: 84

python源码集锦-多元线性回归模型预测房价

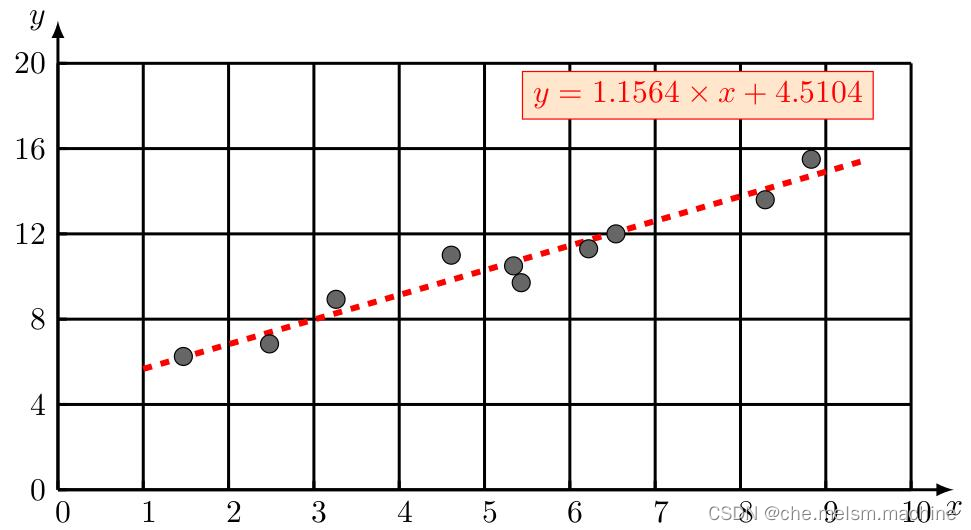

# 1. 多元线性回归基础

多元线性回归是一种预测模型,用于预测一个连续的因变量(目标变量)与多个自变量(特征)之间的关系。其基本形式如下:

```python

y = b0 + b1x1 + b2x2 + ... + bnxn + ε

```

其中:

* `y` 是因变量

* `x1`, `x2`, ..., `xn` 是自变量

* `b0`, `b1`, ..., `bn` 是回归系数

* `ε` 是误差项

多元线性回归模型的构建过程包括:

1. **数据收集和预处理:**收集相关数据并进行清洗和转换。

2. **模型训练:**使用最小二乘法或其他优化算法拟合模型参数。

3. **模型评估:**使用交叉验证或其他方法评估模型的性能,如均方误差 (MSE) 或决定系数 (R^2)。

# 2. 岭回归理论与实践

### 2.1 岭回归的原理和优势

**2.1.1 共线性的影响和解决方法**

共线性是指自变量之间存在高度相关性,这会导致多元线性回归模型出现不稳定和不可靠的系数估计。当自变量之间共线性严重时,会导致:

- **系数估计不稳定:**自变量之间轻微的变化会导致回归系数大幅波动。

- **模型泛化能力差:**训练集上的模型表现良好,但在新数据上表现不佳。

解决共线性问题的常用方法包括:

- **特征选择:**移除共线性的特征。

- **主成分分析 (PCA):**将共线性的特征投影到正交空间中。

- **岭回归:**通过添加惩罚项来缩小回归系数,从而降低共线性的影响。

### 2.1.2 岭回归的惩罚项和正则化参数

岭回归在目标函数中添加了一个惩罚项,该惩罚项与回归系数的平方和成正比。惩罚项的目的是缩小回归系数,从而降低共线性的影响。

岭回归的惩罚项为:

```python

λ * ||β||^2

```

其中:

- λ 是正则化参数,控制惩罚项的强度。

- ||β||^2 是回归系数向量的平方和。

正则化参数 λ 越大,惩罚项的强度越大,回归系数越小。

### 2.2 岭回归的实现和调参

**2.2.1 岭回归模型的构建和训练**

在 Python 中,可以使用 scikit-learn 库构建和训练岭回归模型:

```python

from sklearn.linear_model import Ridge

# 创建岭回归模型

ridge = Ridge(alpha=0.1)

# 训练模型

ridge.fit(X, y)

```

其中:

- `alpha` 是正则化参数。

- `X` 是特征矩阵。

- `y` 是目标变量。

**2.2.2 正则化参数的选择和交叉验证**

选择合适的正则化参数 λ 至关重要。λ 过小,共线性的影响可能无法得到有效抑制;λ 过大,模型可能欠拟合。

选择 λ 的常用方法是交叉验证:

1. 将数据集划分为训练集和测试集。

2. 在训练集上训练岭回归模型,使用不同的 λ 值。

3. 在测试集上评估模型的性能,选择在测试集上表现最好的 λ 值。

以下代码示例演示了如何使用交叉验证选择正则化参数:

```python

from sklearn.model_selection import cross_val_score

# 定义正则化参数的候选值

alphas = [0.01, 0.1, 1, 10]

# 使用交叉验证选择正则化参数

scores = cross_val_score(ridge, X, y, cv=5, scoring='neg_mean_squared_error', param_grid={'alpha': alphas})

# 选择在测试集上表现最好的正则化参数

best_alpha = alphas[np.argmin(scores)]

```

# 3. 岭回归实战应用

### 3.1 房价预测案例

#### 3.1.1 数据预处理和特征工程

1. **数据获取:**从公开数据集或房地产网站收集房价数据。

2. **数据清洗:**删除缺失值、异常值和重复数据。

3. **特征工程:**

- **数值特征:**如面积、卧室数、浴室数。

- **类别特征:**如房屋类型、地段、朝向。

- **特征编码:**使用独热编码或标签编码将类别特征转换为数值特征。

#### 3.1.2 岭回归模型的建立和评估

1. **模型构建:**

- 导入必要的库,如 scikit-learn。

- 初始化岭回归模型,设置正则化参数 lambda。

- 训练模型,使用训练数据拟合模型参数。

2. **模型评估:**

- 使用交叉验证评估模型性能,如 k 折交叉验证。

- 计算评价指标,如均方根误差 (RMSE)、决定系数 (R2)。

3. **参数调优:**

- 调整正则化参数 lambda,找到最佳值。

- 使用网格搜索或贝叶斯优化等方法进行参数优化。

```python

# 导入库

import numpy as np

import pandas as pd

from sklearn.linear_mode

```

0

0