堆排序与其他排序算法对比:优劣势大揭秘,选择最佳排序方案

发布时间: 2024-07-21 01:15:35 阅读量: 48 订阅数: 31

# 1. 排序算法概述

排序算法是计算机科学中一项基本技术,用于将一组数据元素按特定顺序排列。排序算法的应用广泛,从数据分析到机器学习,再到数据库管理。

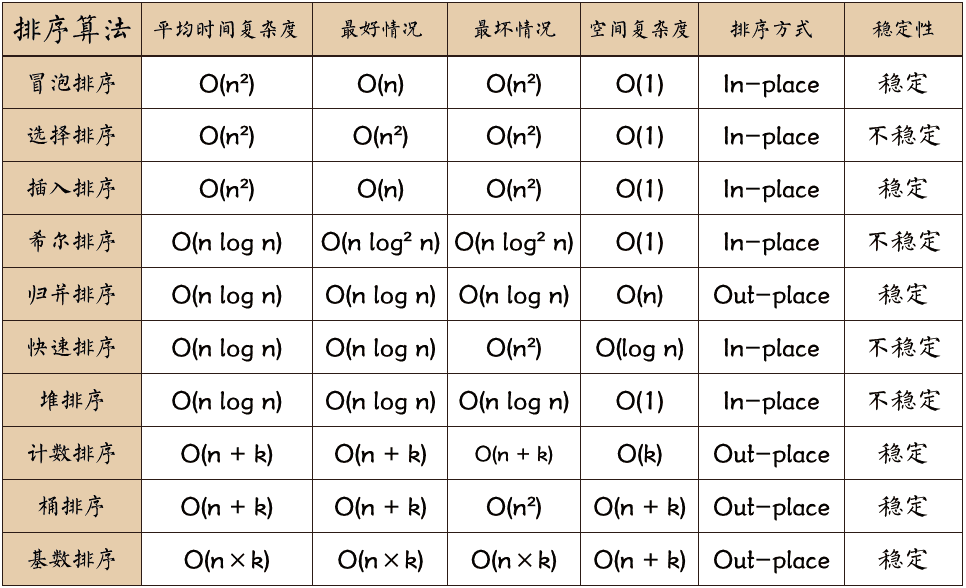

排序算法有多种类型,每种算法都有其独特的优势和劣势。常见的排序算法包括冒泡排序、快速排序、归并排序和堆排序。这些算法的复杂度、稳定性和空间消耗各不相同,适合不同的应用场景。

# 2. 堆排序的原理与实现

### 2.1 堆排序的基本思想

堆排序是一种基于堆数据结构的排序算法。堆是一种完全二叉树,其中每个节点的值都大于或等于其子节点的值。利用堆的这一特性,堆排序可以将一个无序的数组转换为一个有序的数组。

### 2.2 堆的构建和维护

堆的构建过程如下:

1. 将输入数组的第一个元素作为根节点。

2. 将剩余元素依次插入堆中,并调整堆以满足堆的性质。

堆的调整过程如下:

1. 将新插入的元素与它的父节点比较。

2. 如果新插入的元素大于父节点,则交换两者。

3. 重复步骤 1 和 2,直到新插入的元素到达根节点或找到合适的位置。

### 2.3 堆排序的算法步骤

堆排序的算法步骤如下:

1. 构建一个堆。

2. 将堆顶元素与堆底元素交换。

3. 调整堆,将堆底元素移除。

4. 重复步骤 2 和 3,直到堆中只剩下一个元素。

```python

def heap_sort(arr):

"""堆排序算法

Args:

arr (list): 待排序的数组

Returns:

list: 排序后的数组

"""

# 构建堆

for i in range(len(arr) // 2 - 1, -1, -1):

heapify(arr, i, len(arr))

# 堆排序

for i in range(len(arr) - 1, 0, -1):

arr[0], arr[i] = arr[i], arr[0]

heapify(arr, 0, i)

return arr

def heapify(arr, i, n):

"""调整堆

Args:

arr (list): 待调整的堆

i (int): 当前节点的索引

n (int): 堆的大小

"""

largest = i

left = 2 * i + 1

right = 2 * i + 2

if left < n and arr[left] > arr[largest]:

largest = left

if right < n and arr[right] > arr[largest]:

largest = right

if largest != i:

arr[i], arr[largest] = arr[largest], arr[i]

heapify(arr, largest, n)

```

**代码逻辑分析:**

* `heap_sor

0

0