堆排序算法的GPU实现:解锁堆排序在图形处理中的潜力,加速图像和视频处理

发布时间: 2024-07-21 01:39:13 阅读量: 31 订阅数: 33

# 1. 堆排序算法概述**

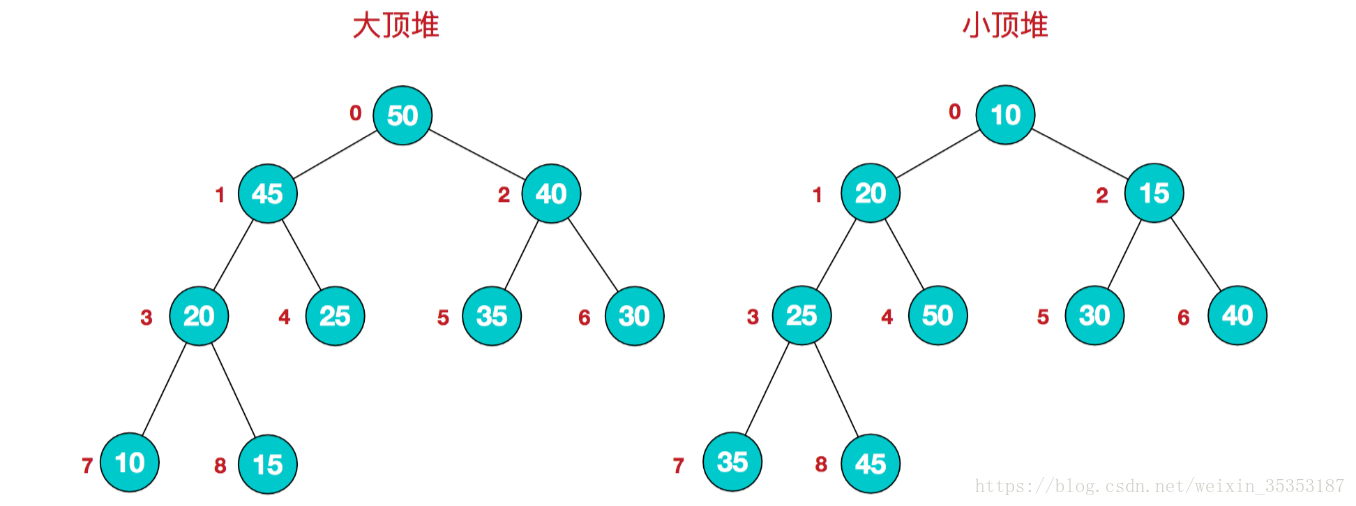

堆排序是一种基于比较的排序算法,它将数据结构组织成一个二叉堆。在堆中,每个节点的值都大于或等于其子节点的值。堆排序通过以下步骤对数据进行排序:

1. 将输入数据构建成一个堆。

2. 重复以下步骤,直到堆中只剩下一个元素:

- 从堆顶删除最大元素。

- 将删除的元素放入输出数组中。

- 将堆顶元素与堆的最后一个元素交换。

- 调整堆以满足堆性质。

# 2. GPU编程基础**

**2.1 GPU架构和并行计算**

GPU(图形处理单元)是一种专门为处理图形和视频数据而设计的并行计算设备。与CPU(中央处理单元)相比,GPU具有以下特点:

* **并行计算能力强:**GPU拥有大量并行处理单元(CUDA核心),可以同时处理大量数据。

* **内存带宽高:**GPU具有高带宽的内存接口,可以快速访问大量数据。

* **针对图形优化:**GPU的硬件架构针对图形处理进行了优化,可以高效地执行图形计算操作。

GPU的并行计算能力使其非常适合处理大规模、数据密集型任务,例如:

* 图像和视频处理

* 科学计算

* 机器学习

**2.2 CUDA编程模型**

CUDA(Compute Unified Device Architecture)是一种由NVIDIA开发的并行编程模型,用于在GPU上编写程序。CUDA编程模型包括以下关键概念:

* **主机代码:**在CPU上运行的代码,负责管理GPU和数据传输。

* **设备代码(内核函数):**在GPU上运行的代码,负责执行并行计算任务。

* **共享内存:**在GPU上可由所有线程访问的内存区域。

* **全局内存:**在GPU上可由所有线程访问的内存区域,但访问速度较慢。

* **局部内存:**每个线程私有的内存区域,访问速度最快。

CUDA编程模型允许程序员将计算任务并行化到GPU上,从而显著提高程序性能。

**代码块:CUDA内核函数示例**

```c++

__global__ void heapify(int *array, int size) {

int i, j, largest;

for (i = size / 2 - 1; i >= 0; i--) {

largest = i;

j = 2 * i + 1;

if (j < size && array[j] > array[largest]) {

largest = j;

}

j = 2 * i + 2;

if (j < size && array[j] > array[largest]) {

largest = j;

}

if (largest != i) {

swap(array[i], array[largest]);

}

}

}

```

**逻辑分析:**

此CUDA内核函数实现了堆排序算法中堆化操作的并行化。它遍历数组中的每个元素,并将其与它的左右子节点进行比较,将最大值交换到父节点的位置。

**参数说明:**

* `array`:输入数组

* `size`:数组大小

**表格:CUDA编程模型关键概念**

| 概念 | 描述 |

|---|---|

| 主机代码 | 在CPU上运行的代码 |

| 设备代码(内核函数) | 在GPU上运行的代码 |

| 共享内存 | 在GPU上可由所有线程访问的内存区域 |

| 全局内存 | 在GPU上可由所有线程访问的内存区域,但访问速度较慢 |

| 局部内存 | 每个线程私有的内存区域,访问速度最快 |

**mermaid流程图:CUDA编程模型流程**

```mermaid

graph LR

subgraph 主机代码

A[CPU]

end

subgraph 设备代码

B[GPU]

end

A --> B

```

# 3. GPU实现堆排序算法

### 3.1 堆排序算法在GPU上的并行化

堆排序算法在GPU上的并行化主要体现在两个方面:

1. **数据并行化:**将堆排序算法中的数据操作并行化到GPU的多个线程上,每个线程负责处理一部分数据。

2. **任务并行化:**将堆排序算法中的不同任务并行化到GPU的多个线程上,例如,构建堆、维护堆和排序。

### 3.2 CUDA内核函数设计

CUDA内核函数是GPU上执行的并行代码单元。对于堆排序算法,需要设计两个内核函数:

1. **构建堆内核函数:**负责将输入数据构建成一

0

0