【实战演练】文本摘要生成实现:抽取式与生成式方法的比较与应用

发布时间: 2024-06-25 08:55:16 阅读量: 119 订阅数: 147

白色大气风格的旅游酒店企业网站模板.zip

# 2.1 基于关键词的抽取式摘要

基于关键词的抽取式摘要方法通过提取文本中具有代表性的关键词来生成摘要。这些关键词通常是文本中出现频率较高、权重较大的词语。

### 2.1.1 TF-IDF算法

TF-IDF(Term Frequency-Inverse Document Frequency)算法是一种经典的关键词提取算法。它考虑了关键词在文本中出现的频率(TF)和在语料库中出现的频率(IDF)。TF-IDF值高的关键词表示其在文本中出现频率较高,同时在语料库中出现频率较低,具有较强的代表性。

```python

from sklearn.feature_extraction.text import TfidfVectorizer

# 初始化TF-IDF向量器

vectorizer = TfidfVectorizer()

# 拟合文本数据

vectorizer.fit([text1, text2, ...])

# 获取TF-IDF权重

tfidf_weights = vectorizer.transform([text])

# 提取关键词

keywords = [vectorizer.get_feature_names_out()[i] for i in tfidf_weights.argmax(axis=1)]

```

# 2. 抽取式文本摘要方法

抽取式文本摘要方法从原始文本中提取关键信息,形成摘要。它通过识别和提取重要句子或关键词来构建摘要。抽取式方法主要分为两类:基于关键词的抽取式摘要和基于句子的抽取式摘要。

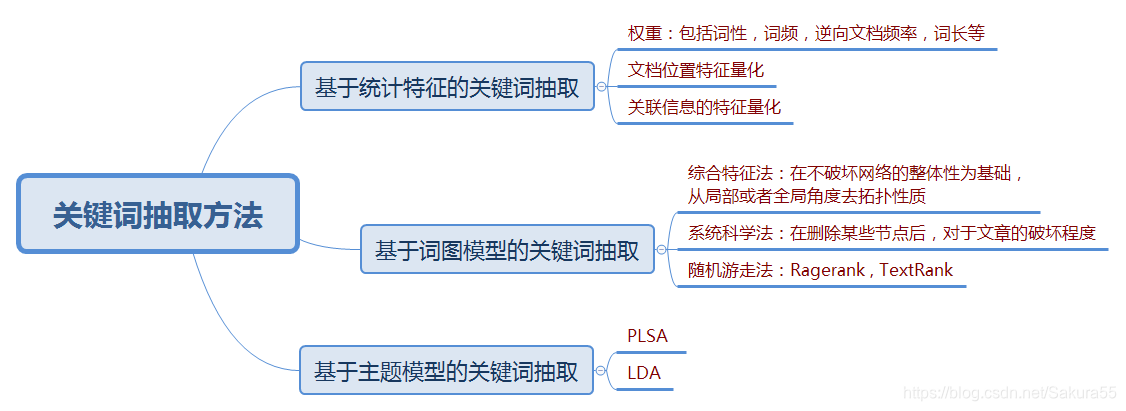

### 2.1 基于关键词的抽取式摘要

基于关键词的抽取式摘要方法通过计算关键词的权重来确定其重要性,然后从原始文本中提取这些关键词形成摘要。常用的关键词权重计算算法包括:

#### 2.1.1 TF-IDF算法

TF-IDF(Term Frequency-Inverse Document Frequency)算法是一种常用的关键词权重计算方法。它考虑了关键词在文本中出现的频率(TF)和在整个语料库中的分布(IDF)。TF-IDF算法的计算公式为:

```python

TF-IDF(t, d, D) = TF(t, d) * IDF(t, D)

```

其中:

* `t`:关键词

* `d`:文档

* `D`:语料库

* `TF(t, d)`:关键词 `t` 在文档 `d` 中出现的频率

* `IDF(t, D)`:关键词 `t` 在语料库 `D` 中出现的文档数量的对数的倒数

#### 2.1.2 TextRank算法

TextRank算法是一种基于图论的关键词权重计算方法。它将文本中的句子视为图中的节点,并根据句子之间的相似性构建边。句子之间的相似性可以通过余弦相似度或其他相似性度量来计算。TextRank算法通过迭代计算每个节点的权重,最终得到关键词的权重。

### 2.2 基于句子的抽取式摘要

基于句子的抽取式摘要方法通过识别和提取重要句子来构建摘要。常用的基于句子的抽取式摘要算法包括:

#### 2.2.1 中心性算法

中心性算法是一种基于图论的句子重要性计算方法。它将文本中的句子视为图中的节点,并根据句子之间的相似性构建边。句子之间的相似性可以通过余弦相似度或其他相似性度量来计算。中心性算法通过计算每个节点的中心性,最终得到句子的重要性。

#### 2.2.2 图论算法

图论算法是一种基于图论的句子提取方法。它将文本中的句子视为图中的节点,并根据句子之间的关系构建边。句子之间的关系可以通过共现关系、因果关系或其他关系来定义。图论算法通过遍历图并识别重要节点,最终得到重要

0

0