【进阶】jieba库高级分词应用案例:关键词提取与文本摘要

发布时间: 2024-06-25 07:52:10 阅读量: 127 订阅数: 147

基于freeRTOS和STM32F103x的手机远程控制浴室温度系统设计源码

该项目是一款基于freeRTOS操作系统和STM32F103x微控制器的手机远程控制浴室温度系统设计源码,共包含1087个文件,包括580个C语言源文件、269个头文件、45个汇编源文件、36个数据文件、36个目标文件、35个编译规则文件、28个包含文件、27个文本文件、6个源文件、3个归档文件。此系统通过手机远程实现对浴室温度的有效控制,适用于智能浴室环境管理。

# 2.1 词性标注和词频统计

### 2.1.1 词性标注的原理和应用

词性标注是指给分词后的词语打上词性标签,如名词、动词、形容词等。Jieba库使用隐马尔可夫模型(HMM)进行词性标注,通过训练语料库中的词语和词性关系,建立词性标注模型。

词性标注在文本处理中有着广泛的应用,如:

- **词义消歧:**通过词性信息可以区分词语的不同含义,如“银行”既可以是名词,也可以是动词。

- **语法分析:**词性信息有助于识别句子中的主语、谓语、宾语等语法成分。

- **信息抽取:**词性信息可以帮助提取特定类型的信息,如人名、地名、时间等。

### 2.1.2 词频统计的算法和意义

词频统计是指统计文本中每个词语出现的次数。Jieba库使用哈希表来存储词语和词频,并提供多种算法进行词频统计,如:

- **词频(TF):**统计词语在文本中出现的次数。

- **逆文档频率(IDF):**衡量词语在不同文档中出现的稀有程度。

- **TF-IDF:**结合词频和逆文档频率,衡量词语在特定文档中的重要性。

词频统计在文本处理中有着重要的意义,如:

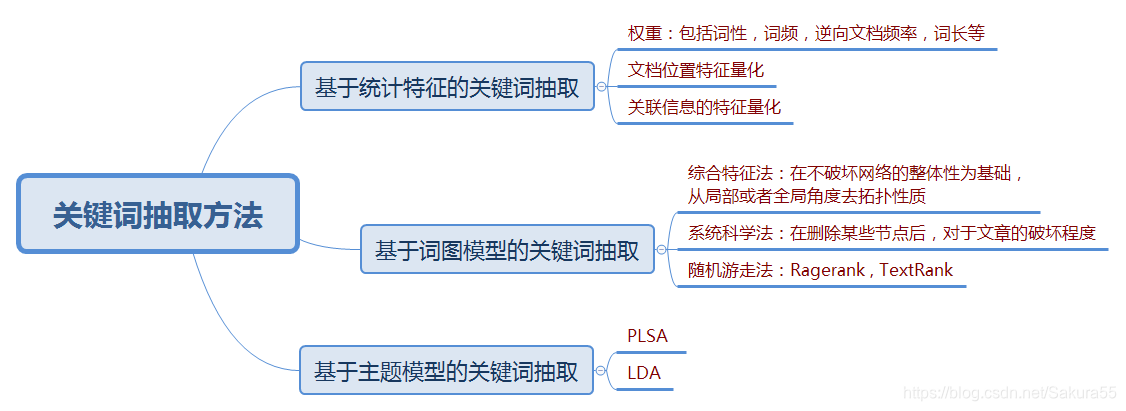

- **关键词提取:**通过词频统计可以提取文本中出现频率较高的关键词。

- **文本分类:**词频统计可以作为文本分类的特征,帮助识别文本的主题。

- **文本相似性计算:**词频统计可以用于计算文本之间的相似性,如余弦相似度。

# 2. Jieba库高级分词技巧

### 2.1 词性标注和词频统计

#### 2.1.1 词性标注的原理和应用

词性标注是指为每个分词结果分配一个词性标签,如名词、动词、形容词等。Jieba库集成了多种词性标注算法,包括基于规则的算法和基于统计的算法。

**基于规则的算法**通过预定义的词性规则对分词结果进行标注,具有较高的准确率,但覆盖范围有限。

**基于统计的算法**利用统计信息和语言模型对分词结果进行标注,具有较好的泛化能力,但准确率可能略低于基于规则的算法。

词性标注在自然语言处理中具有广泛的应用,如词义消歧、句法分析和机器翻译等。

#### 2.1.2 词频统计的算法和意义

词频统计是指统计分词结果中每个词出现的次数。Jieba库提供了多种词频统计算法,包括朴素贝叶斯算法和哈希表算法等。

**朴素贝叶斯算法**是一种基于概率论的算法,可以根据词频和词性信息计算词的权重。

**哈希表算法**是一种基于数据结构的算法,可以快速统计词频,但无法计算词的权重。

词频统计在自然语言处理中具有重要的意义,如关键词提取、文本分类和语言模型训练等。

### 2.2 分词自定义词典和停用词表

#### 2.2.1 自定义词典的创建和使用

自定义词典可以用来扩展Jieba库的分词能力,添加特定领域的专业术语或人名地名等。创建自定义词典时,需要将词语和对应的词性信息写入文本文件中,并指定词典路径。

```python

import jieba

# 创建自定义词典

jieba.load_userdict("my_dict.txt")

# 分词

words = jieba.cut("北京大学自然语言处理实验室")

print(list(words))

```

#### 2.2.2 停用词表的获取和应用

停用词表包含了在自然语言处理中经常出现但意义不大的词语,如介词、连词

百万级

高质量VIP文章无限畅学

百万级

高质量VIP文章无限畅学

千万级

优质资源任意下载

千万级

优质资源任意下载

C知道

免费提问 ( 生成式Al产品 )

C知道

免费提问 ( 生成式Al产品 )

0

0

相关推荐

李_涛

知名公司架构师

拥有多年在大型科技公司的工作经验,曾在多个大厂担任技术主管和架构师一职。擅长设计和开发高效稳定的后端系统,熟练掌握多种后端开发语言和框架,包括Java、Python、Spring、Django等。精通关系型数据库和NoSQL数据库的设计和优化,能够有效地处理海量数据和复杂查询。

专栏简介

本专栏汇集了全面的 Python 自然语言处理 (NLP) 知识,涵盖从基础到进阶的各个方面。专栏中包含一系列文章,深入探讨 NLP 的各个主题,包括:

* 基础知识:NLP 概述、Python 基础语法、文本数据结构、文本预处理、分词库、特征提取、分类算法、情感分析、相似度计算、数据集获取、命名实体识别、文本生成、语言模型、文本聚类、摘要和关键词提取、信息抽取、机器翻译。

* 进阶内容:多语言处理、NLP 工具库、高级文本表示学习、深度学习优化策略、高级文本生成、高级命名实体识别、高级文本相似度计算、情感分析调优、高级文本聚类、高级文本摘要、信息抽取高级应用、机器翻译模型优化、多语言处理挑战、GPT-3 原理和应用、BERT 与 GPT-2 对比、多模态文本生成、文本生成优化策略、文本生成应用案例分析、多语言机器翻译趋势。

* 实战演练:文本情感分析、文本分类、命名实体识别、文本相似度计算、文本摘要生成、信息抽取、机器翻译、文本数据清洗、特征提取、分类模型实现、情感分析实现、命名实体识别实现、文本相似度计算实现、文本聚类算法实现、文本摘要生成实现、信息抽取实现、机器翻译模型实现、文本生成模型实现、文本生成与对话系统实现、文本生成与图像处理结合实现、文本生成与语音合成实现、文本生成与知识图谱实现。

专栏目录

最低0.47元/天 解锁专栏

买1年送3月

百万级

高质量VIP文章无限畅学

百万级

高质量VIP文章无限畅学

千万级

优质资源任意下载

千万级

优质资源任意下载

C知道

免费提问 ( 生成式Al产品 )

C知道

免费提问 ( 生成式Al产品 )

最新推荐

【MOXA串口服务器故障全解】:常见问题与解决方案速查手册

# 摘要

本文对MOXA串口服务器的使用和维护进行了系统的介绍和分析。首先概述了MOXA串口服务器的基本功能与重要性。随后,本文详细探讨了故障诊断与排查的基础知识,包括理解串口通信原理和MOXA设备工作模式,以及如何通过检查硬件和使用命令行工具进行故障排查。接着,文章重点讨论了串口服务器的常见问题及其解决方案,涵盖了通信、网络和系统配置方面的问题。在高级故障排

GC理论2010全解析:斜率测试新手快速入门指南

# 摘要

本论文旨在全面回顾2010年垃圾回收(GC)理论的发展,并探讨其在现代编程语言中的应用。首先,文章概述了GC的基本原理,包括其历史演变、核心概念以及性能评估方法。其次,论文重点介绍了GC理论的关键创新点,比如增量式、并行和混合式垃圾回收算法,并分析了它们的技术挑战和适用场景。为了进一步理解和评估GC的

GS+ 代码优化秘籍:提升性能的8大实战技巧

# 摘要

本文深入探讨了GS+代码优化的各个方面,旨在提升软件性能和效率。第一章概述了性能优化的重要性。第二章详细介绍了性能分析的基础知识,包括识别性能瓶颈、代码剖析技术和性能度量指标。第三章聚焦于实战技巧,涵盖了数据结构优化、算法效率提升、并行处理和多线程、以及缓存的利用与管理。第四章探讨了高级性能优化技术,包括异步编程模式、代码重构与模式应用、硬件加速技术。第五章通过案例研究与总结,提供性能优化的最佳实践,并评估优化策略的效果。本文旨在为软件开发者提供一套完整的性能优化框架和实用工具,以应对多样化的性能挑战。

# 关键字

性能分析;代码优化;数据结构;并行处理;异步编程;硬件加速;缓存管

【数据驱动的CMVM优化】:揭秘如何通过数据分析提升机床性能

# 摘要

随着技术的进步,数据驱动的CMVM(Configuration Management and Versioning Model)优化已经成为提高企业资产管理效率和质量的重要手段。本文概述了CMVM优化的整个流程,包括性能数据的收集与管理、数据分析的理论基础及应用,以及优化策略的制定和实施。文章深入探讨了数据收集的技术工具、数据存储与管理策略、数据清洗

【西门子SITOP电源效率提升指南】:系统性能的关键优化步骤

# 摘要

本文深入研究了西门子SITOP电源的效率、性能参数及优化策略。首先概述了电源效率的基础理论,探讨了效率的定义、重要性以及提升效率的理论方法,接着重点分析了西门子SITOP电源的关键性能参数和性能测试方法。文章深入挖掘了硬件和软件优化策略以及系统集成优化的方法,并通过案例研究分享了实践

【性能优化实战】:提升俄罗斯方块游戏运行效率的10大策略

# 摘要

本文针对俄罗斯方块游戏性能优化进行了综合探讨,涉及渲染性能、游戏逻辑、数据结构、内存管理以及并发与网络通信等方面的优化策略。通过分析渲染引擎核心原理、图形处理与资源管理技术、硬件加速和多线程渲染的优势,本文深入探讨了提升游戏性能的技术手段。同时,文章对游戏逻辑代码和数据结构的选择进行了优化分析,以及介绍了内存分配、

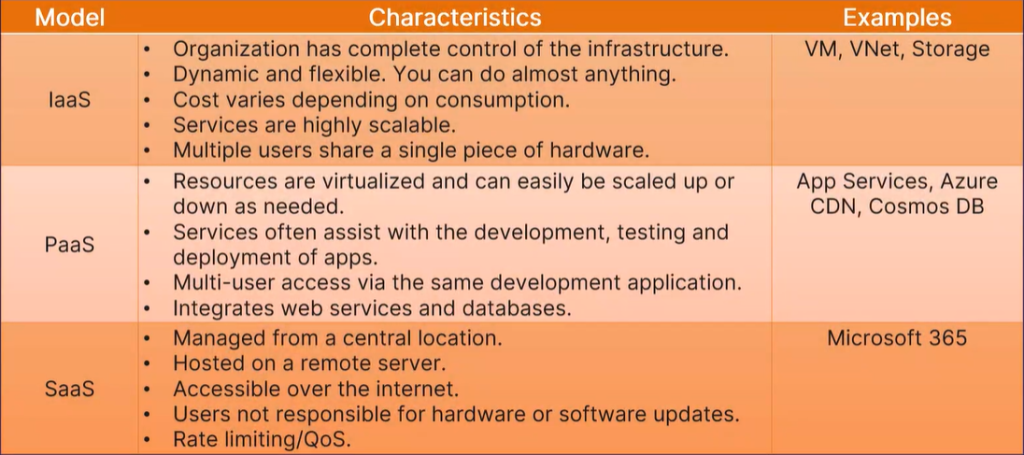

云服务模型全解析:IaaS、PaaS、SaaS的区别与最优应用策略

# 摘要

云计算作为一种新兴的计算模式,已经成为企业IT架构的重要组成部分。本文系统地概述了云服务的三种主要模型:IaaS、PaaS和SaaS,并详细探讨了它们的架构特性、技术细节、业务价值以及应用场景

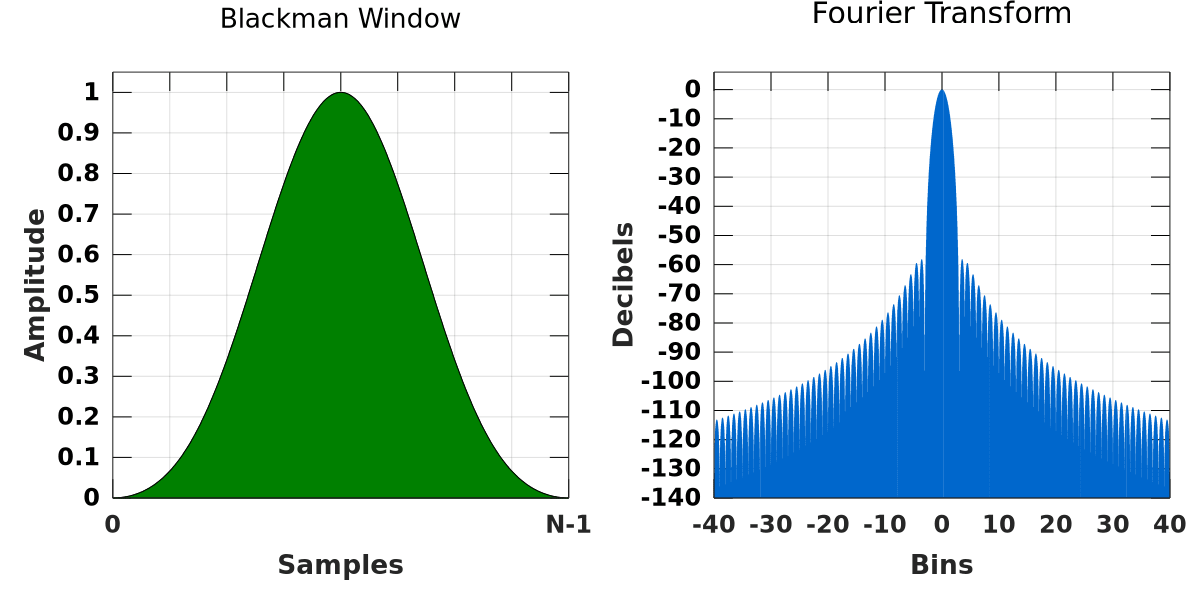

优化至上:MATLAB f-k滤波器性能提升的8大策略

# 摘要

本论文对MATLAB环境下的f-k滤波器进行了系统的研究,涵盖了其基本原理、性能提升的理论基础、实践技巧以及在不同领域的应用效果。文章首先介绍了f-k滤波器的基本工作原理和数学模型,随后深入探讨了提升其性能的关键参数分析和理论方法。接着,通过算法效率、数据处理改进及资源管理与分配优化等实践技巧,探讨了如何在实际应用中提高f-k滤波器的性能。此外,文章还研究了f-

资源上传下载、课程学习等过程中有任何疑问或建议,欢迎提出宝贵意见哦~我们会及时处理!

点击此处反馈

专栏目录

最低0.47元/天 解锁专栏

买1年送3月

百万级

高质量VIP文章无限畅学

百万级

高质量VIP文章无限畅学

千万级

优质资源任意下载

千万级

优质资源任意下载

C知道

免费提问 ( 生成式Al产品 )

C知道

免费提问 ( 生成式Al产品 )