挖掘隐藏模式:PCA降维算法在数据挖掘中的应用

发布时间: 2024-07-20 13:19:37 阅读量: 20 订阅数: 32

# 1. 数据挖掘概述**

数据挖掘是一种从大量数据中提取有价值信息的过程。它涉及使用统计、机器学习和数据库技术来发现隐藏的模式、趋势和关系。数据挖掘在各种行业中得到广泛应用,包括金融、医疗保健、零售和制造业。

数据挖掘过程通常包括以下步骤:

- **数据准备:**收集和清理数据,使其适合分析。

- **数据探索:**使用可视化和统计技术探索数据,发现模式和异常值。

- **模型构建:**使用机器学习算法构建模型,从数据中学习模式。

- **模型评估:**评估模型的性能,并根据需要进行调整。

- **部署:**将模型部署到生产环境中,用于预测和决策。

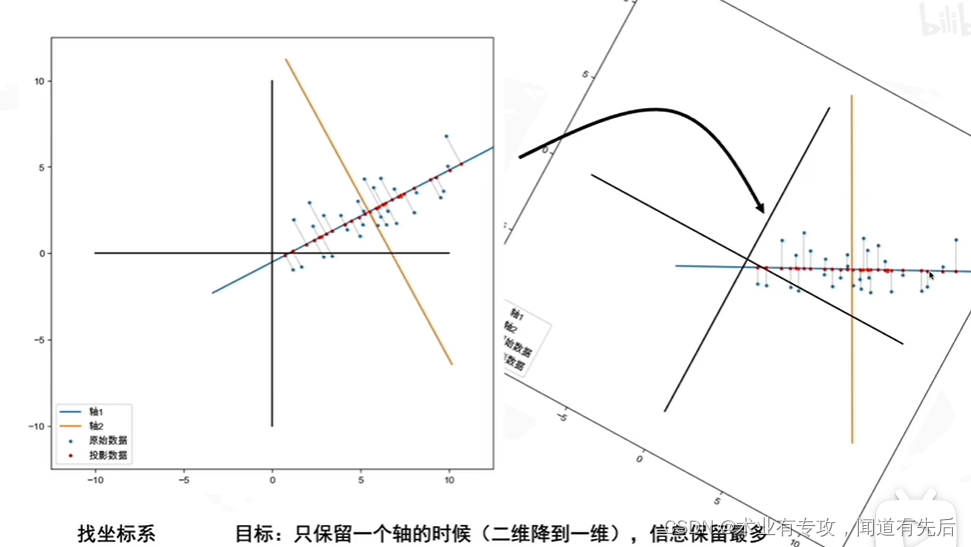

# 2.1 PCA算法原理

**主成分分析(PCA)**是一种降维算法,用于将高维数据投影到低维空间中,同时保留原始数据中的最大方差。PCA背后的基本原理是:

* **线性变换:**PCA将原始数据线性变换到一个新的坐标系中,称为主成分空间。

* **最大方差:**主成分空间中的第一个主成分(PC1)是原始数据中方差最大的方向。随后的每个主成分都是方差次之的方向。

* **正交性:**主成分彼此正交,这意味着它们独立于彼此。

**数学原理:**

PCA的数学原理可以表示为:

```python

X_pca = X @ P

```

其中:

* `X` 是原始数据矩阵,形状为 `n x m`(`n` 为样本数,`m` 为特征数)

* `X_pca` 是降维后的数据矩阵,形状为 `n x k`(`k` 为降维后的维度)

* `P` 是投影矩阵,形状为 `m x k`

投影矩阵 `P` 是通过以下步骤计算的:

1. 计算原始数据矩阵 `X` 的协方差矩阵 `C`。

2. 对协方差矩阵 `C` 进行特征值分解,得到特征值 `λ` 和特征向量 `v`。

3. 将特征向量 `v` 组成投影矩阵 `P`,其中每一列对应一个主成分。

**参数说明:**

* `n`:样本数

* `m`:特征数

* `k`:降维后的维度

* `λ`:特征值

* `v`:特征向量

* `P`:投影矩阵

**逻辑分析:**

PCA算法通过以下步骤工作:

1. **计算协方差矩阵:**协方差矩阵捕获了原始数据中特征之间的相关性。

2. **特征值分解:**特征值分解将协方差矩阵分解为特征值和特征向量。

3. **投影:**原始数据通过投影矩阵 `P` 投影到主成分空间中。

PCA算法的优点是:

* **降维:**PCA可以将高维数据降维到低维空间中,从而减少计算成本和存储空间。

* **保留方差:**PCA保留了原始数据中的最大方差,确保了降维后的数据仍然具有代表性。

* **正交性:**主成分彼此正交,这使得它们易于解释和使用。

# 3.1 PCA算法实现

### 代码实现

PCA算法的实现可以通过各种编程语言,例如Python、R、Java等。以下是一个使用Python实现PCA算法的示例代码:

```python

import numpy as np

from sklearn.decomposition import PCA

# 导入数据

data = np.loadtxt('data.csv', delimiter=',')

# 创建PCA对象

pca = PCA(n_components=2)

# 拟合数据

pca.fit(data)

# 获取主成分

components = pca.components_

# 获取方差贡献率

variances = pca.explained_variance_ratio_

```

### 逻辑分析

- `n_components`参数指定要降维到的维度数。

- `fit`方法对数据进行拟合,计算主成分和方差贡献率。

- `components_`属性包含主成分,每个主成分是一个向

0

0