PPO算法在多智能体系统中的应用:协作与竞争

发布时间: 2024-08-22 01:13:33 阅读量: 13 订阅数: 19

# 1. 多智能体系统概述**

多智能体系统是由多个智能体组成的系统,其中每个智能体都具有感知、决策和行动的能力。多智能体系统在各个领域都有着广泛的应用,例如机器人协作、无人机编队和智能交通。

多智能体系统面临的主要挑战之一是协调不同智能体之间的行为,以实现共同的目标。传统的方法通常采用集中式控制,其中一个中心实体负责协调所有智能体的行为。然而,这种方法在复杂和动态的环境中往往不可行,因为中心实体可能无法获得所有必要的信息来做出最佳决策。

为了解决这个问题,研究人员提出了分布式多智能体系统,其中每个智能体都独立决策并与其他智能体进行交互。分布式多智能体系统具有鲁棒性强、适应性好等优点,使其成为解决复杂问题的一个有吸引力的选择。

# 2. PPO算法理论

### 2.1 近端策略优化(PPO)算法原理

#### 2.1.1 策略梯度定理

策略梯度定理是PPO算法的基础,它提供了计算策略梯度的方法,即策略参数变化对目标函数影响的梯度。对于离散动作空间,策略梯度定理公式如下:

```

∇_θ J(θ) = E[∇_θ log π(a_t | s_t) A_t]

```

其中:

* θ:策略参数

* J(θ):目标函数

* π(a_t | s_t):在状态s_t下采取动作a_t的概率

* A_t:优势函数,衡量动作a_t相对于其他动作的优势

#### 2.1.2 PPO算法的优化目标

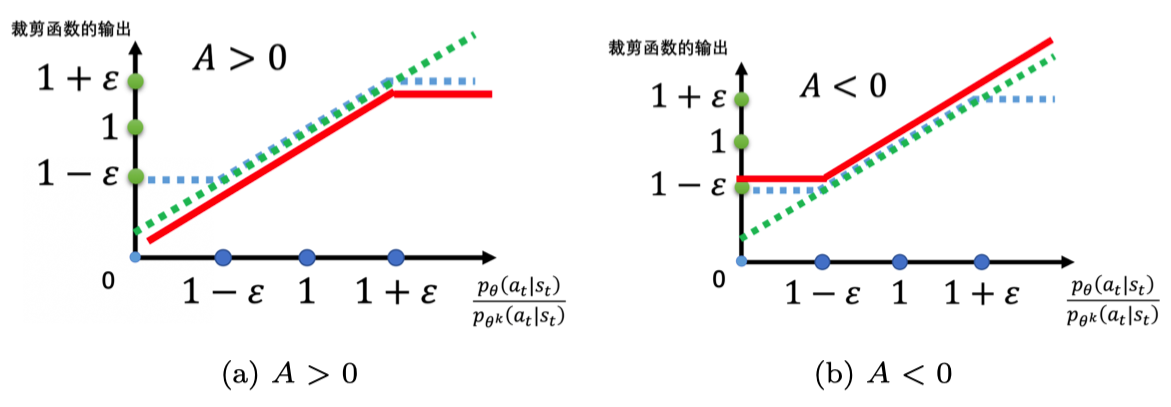

PPO算法的优化目标是最大化以下目标函数:

```

L(θ) = E[min(r_t(θ), clip(r_t(θ), 1 - ε, 1 + ε)) A_t]

```

其中:

* r_t(θ):策略梯度定理中计算的策略梯度

* clip(r_t(θ), 1 - ε, 1 + ε):截断函数,限制策略梯度的范围

* ε:截断阈值

### 2.2 PPO算法的实现细节

#### 2.2.1 演员-评论家架构

PPO算法采用演员-评论家架构,其中演员网络输出动作概率分布,评论家网络输出状态价值函数。演员网络根据评论家网络提供的价值函数更新策略,而评论家网络则根据策略更新价值函数。

#### 2.2.2 经验回放池

PPO算法使用经验回放池来存储过往的经验,这些经验包括状态、动作、奖励和下一个状态。在策略更新时,算法会从经验回放池中采样一批经验进行训练。

#### 2.2.3 策略更新机制

PPO算法使用一种称为信任区域策略优化(TRPO)的策略更新机制。TRPO通过限制策略更新的步长来确保策略的稳定性。具体来说,TRPO算法会计算一个约束,该约束限制策略更新的步长,使得更新后的策略不会偏离原始策略太多。

# 3. PPO算法在多智能体系统中的应用

### 3.1 多智能体协作优化

#### 3.1.1 分布式PPO算法

在多智能体协作优化中,PPO算法可以被扩展为分布式版本,以处理大规模多智能体系统。分布式PPO算法将训练过程分布在多个智能体上,每个智能体负责收集自己的经验并更新自己的策略。

**代码块:**

```python

import ray

import torch

@ray.remote

def train_agent(env, agent):

# 收集经验

experiences = []

fo

```

0

0