【进阶】时间序列分析:LSTM与RNN

发布时间: 2024-06-26 14:12:48 阅读量: 92 订阅数: 142

# 1. 时间序列分析基础**

时间序列分析是一门研究时间序列数据的科学,时间序列数据是指按时间顺序排列的数据。时间序列分析可以用于识别数据中的模式、趋势和异常,并用于预测未来的值。

时间序列分析有两种主要类型:

* **单变量时间序列分析:**只考虑一个时间序列变量。

* **多变量时间序列分析:**考虑多个时间序列变量。

时间序列分析中常用的方法包括:

* **平滑技术:**用于去除数据中的噪声和波动。

* **季节性分解:**用于识别和去除数据中的季节性模式。

* **趋势分析:**用于识别和去除数据中的趋势。

* **预测:**用于预测未来值。

# 2. LSTM与RNN理论基础

### 2.1 长短期记忆网络(LSTM)

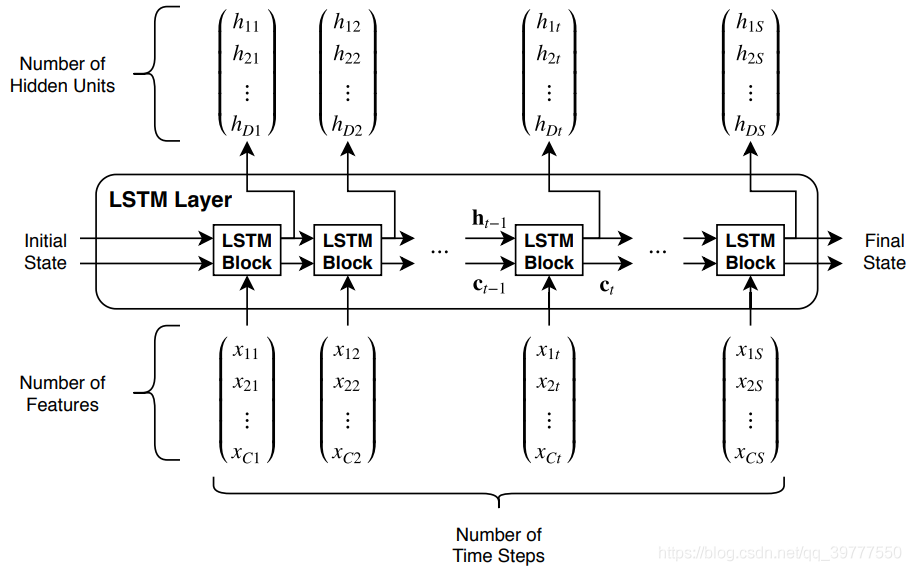

#### 2.1.1 LSTM的结构和原理

长短期记忆网络(LSTM)是一种循环神经网络(RNN),专门设计用于处理序列数据。与标准RNN不同,LSTM具有一个独特的单元结构,可以更好地学习和记住长期依赖关系。

LSTM单元由以下组件组成:

* **输入门:**决定哪些新信息将被添加到单元状态中。

* **遗忘门:**决定哪些现有信息将被丢弃。

* **更新门:**更新单元状态。

* **输出门:**决定哪些单元状态信息将被输出。

LSTM单元的工作流程如下:

1. **输入门:**sigmoid层接收输入和前一个隐藏状态,输出一个0到1之间的值。该值表示新信息被添加到单元状态的程度。

2. **遗忘门:**sigmoid层接收输入和前一个隐藏状态,输出一个0到1之间的值。该值表示前一个单元状态中哪些信息将被丢弃。

3. **更新门:**tanh层接收输入和前一个隐藏状态,输出一个-1到1之间的值。该值表示新的单元状态。

4. **输出门:**sigmoid层接收输入和前一个隐藏状态,输出一个0到1之间的值。该值表示单元状态中哪些信息将被输出。

#### 2.1.2 LSTM的训练和优化

LSTM的训练和优化与标准RNN类似。可以使用梯度下降算法和反向传播来调整网络权重。然而,由于LSTM单元的复杂性,训练LSTM网络可能需要更长的时间和更多的计算资源。

以下是一些优化LSTM训练的技巧:

* **使用较小的学习率:**较小的学习率有助于防止梯度爆炸。

* **使用梯度截断:**梯度截断可以防止梯度变得过大。

* **使用正则化:**正则化可以防止过拟合。

* **使用dropout:**dropout可以防止过拟合。

### 2.2 循环神经网络(RNN)

#### 2.2.1 RNN的结构和原理

循环神经网络(RNN)是一种神经网络,可以处理序列数据。RNN具有一个循环结构,允许信息在时间步长之间传递。

RNN单元由以下组件组成:

* **输入层:**接收输入。

* **隐藏层:**保存前一个时间步长的信息。

* **输出层:**输出预测。

RNN单元的工作流程如下:

1. **输入层:**接收输入。

2. **隐藏层:**将输入与前一个隐藏状态结合起来,更新隐藏状态。

3. **输出层:**将隐藏状态转换为输出。

#### 2.2.2 RNN的变种和改进

RNN有许多变种和改进,包括:

* **长短期记忆网络(LSTM):**如前所述,LSTM是一种专门设计用于处理长期依赖关系的RNN。

* **门控循环单元(GRU):**GRU是一种简化的LSTM,它没有输出门。

* **双向RNN(BiRNN):**BiRNN使用两个RNN,一个处理序列的正向,另一个处理序列的反向。

* **堆叠RNN(Stacked RNN):**堆叠RNN使用多个RNN层,每个层接收前一层输出。

# 3.1 LSTM与RNN在时间序列预测中的应用

### 3.1.1 股票价格预测

**应用场景:**

股票价格预测是时间序列预测的一个典型应用。给定历史股票价格数据,预测未来价格走势,为投资者提供决策依据。

**LSTM模型:**

LSTM网络具有强大的时间序列记忆能力,适合处理股票价格这种具有长期依赖关系的数据。其结构如下:

```python

import tensorflow as tf

class LSTMModel(tf.keras.Mode

```

0

0