【进阶】文本生成模型(如LSTM文本生成)实践指南

发布时间: 2024-06-25 04:20:12 阅读量: 122 订阅数: 127

# 1. 文本生成模型概述**

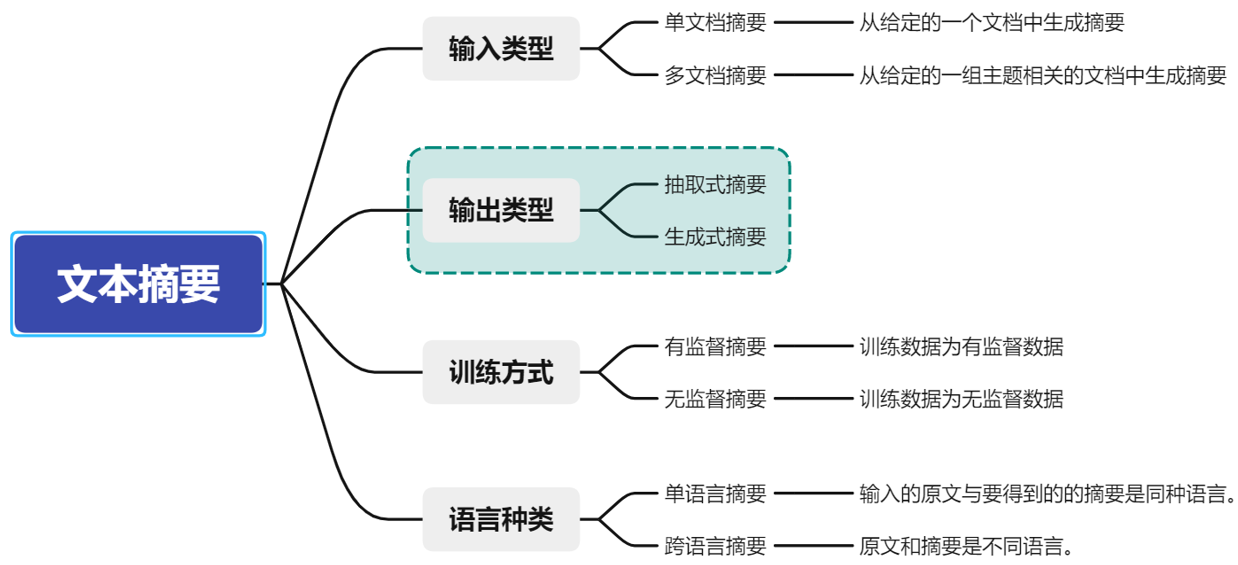

文本生成模型是一种人工智能技术,它能够根据给定的输入文本生成新的文本。这些模型广泛应用于自然语言处理(NLP)任务,例如文本摘要、机器翻译、对话生成和创意写作。文本生成模型通过学习文本数据的模式和结构来工作,使它们能够生成连贯、流畅且信息丰富的文本。

# 2. LSTM文本生成模型原理

### 2.1 LSTM神经网络结构

**2.1.1 LSTM单元结构**

LSTM(Long Short-Term Memory)神经网络是一种特殊的循环神经网络(RNN),专门设计用于处理序列数据。它由一系列称为LSTM单元的重复模块组成,每个单元包含三个门:输入门、遗忘门和输出门。

* **输入门**:控制新信息流入单元的程度。它接收当前输入和前一时刻的隐藏状态,输出一个介于0和1之间的值,表示每个输入元素被允许流入单元的程度。

* **遗忘门**:控制前一时刻的隐藏状态被遗忘的程度。它接收当前输入和前一时刻的隐藏状态,输出一个介于0和1之间的值,表示每个隐藏状态元素被允许遗忘的程度。

* **输出门**:控制当前单元的隐藏状态输出的程度。它接收当前输入和前一时刻的隐藏状态,输出一个介于0和1之间的值,表示每个隐藏状态元素被允许输出的程度。

**2.1.2 LSTM网络的训练和优化**

LSTM网络的训练过程与其他神经网络类似,使用反向传播算法。然而,由于LSTM单元的复杂性,训练过程可能很耗时。为了优化训练,可以使用以下技术:

* **梯度截断**:限制梯度的大小,防止梯度爆炸。

* **正则化**:通过添加惩罚项来防止过拟合,例如L1或L2正则化。

* **Dropout**:在训练过程中随机丢弃神经元,以提高泛化能力。

### 2.2 文本生成模型的构建

**2.2.1 数据预处理和特征提取**

文本生成模型的构建从数据预处理开始。这包括:

* **分词**:将文本分解为单词或词组。

* **词嵌入**:将单词或词组转换为数值向量,以捕获其语义含义。

* **序列截断**:将序列截断为固定长度,以适应模型输入。

**2.2.2 模型架构设计和训练**

文本生成模型的架构通常包含以下组件:

* **嵌入层**:将输入序列转换为数值向量。

* **LSTM层**:处理序列数据,学习序列中的长期依赖关系。

* **全连接层**:将LSTM层的输出转换为预测的概率分布。

* **损失函数**:度量模型预测与真实目标之间的差异,例如交叉熵损失。

模型训练过程涉及以下步骤:

1. 前向传播:将输入序列通过模型,计算损失函数。

2. 反向传播:计算损失函数对模型参数的梯度。

3. 参数更新:使用优化算法(如Adam)更新模型参数,以最小化损失函数。

**2.2.3 模型评估和调优**

模型训练后,需要进行评估和调优。评估指标包括:

* **准确率**:模型预测正确的序列的比例。

* **困惑度**:模型预测错误序列的概率。

调优技术包括:

* **超参数调优**:调整模型的超参数,如学习率和LSTM层数。

* **数据增强**:增加训练数据的数量和多样性

0

0