【进阶】深度学习中的残差网络(ResNet)原理与应用

发布时间: 2024-06-25 03:56:55 阅读量: 10 订阅数: 30

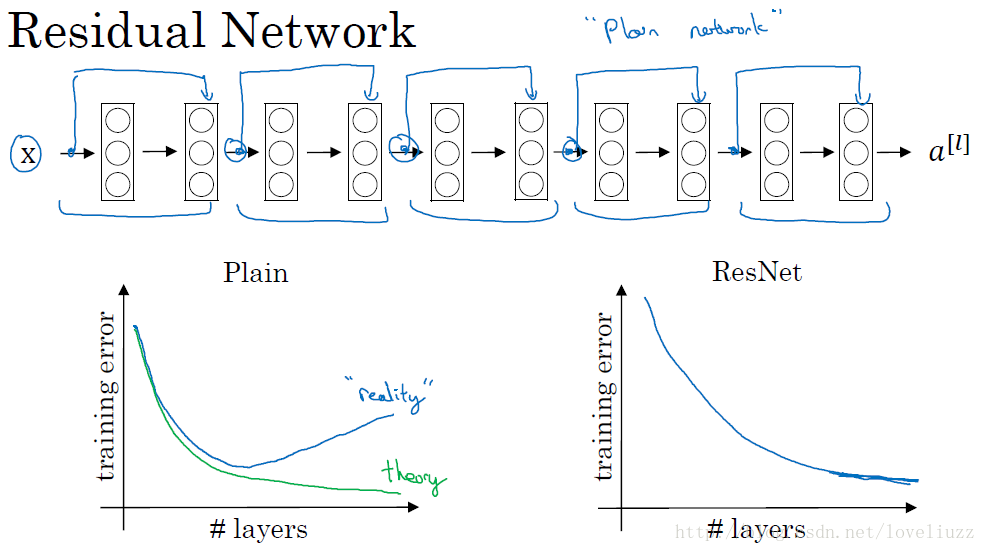

# 2.1 卷积神经网络的退化问题

随着卷积神经网络(CNN)层数的增加,网络的性能往往会遇到瓶颈甚至下降,这种现象被称为退化问题。退化问题的主要原因包括:

- **梯度消失:**当网络层数较深时,梯度在反向传播过程中会不断缩小,导致难以训练网络。

- **梯度爆炸:**在某些情况下,梯度也会在反向传播过程中不断增大,导致网络不稳定。

- **信息丢失:**随着网络层数的增加,网络可能会丢失一些重要的信息,导致性能下降。

# 2. ResNet的理论基础

### 2.1 卷积神经网络的退化问题

卷积神经网络(CNN)在计算机视觉领域取得了显著的成功,但随着网络层数的增加,CNN面临着梯度消失和梯度爆炸的问题,导致网络难以训练。

**梯度消失:**当网络层数较多时,梯度在反向传播过程中不断缩小,导致浅层网络无法有效更新权重。

**梯度爆炸:**相反,当网络层数较多时,梯度在反向传播过程中不断放大,导致深层网络的权重更新过于剧烈,使网络不稳定。

### 2.2 残差学习的提出和原理

为了解决CNN的退化问题,何凯明等人提出了残差学习的概念。残差学习的思想是将网络的输入和输出之间的差值(残差)作为网络学习的目标,而不是直接学习输出。

具体来说,残差网络中的每个残差块包含一个卷积层和一个恒等映射(identity mapping)。恒等映射直接将输入传递到输出,而卷积层则学习输入和输出之间的残差。

### 2.3 ResNet的网络结构和特点

ResNet的网络结构由多个残差块堆叠而成。每个残差块包含两个3x3卷积层,中间穿插一个恒等映射。

ResNet的特点包括:

- **深度:**ResNet可以堆叠数百层,而不会出现梯度消失或梯度爆炸问题。

- **效率:**残差学习允许梯度直接流经恒等映射,避免了梯度消失。

- **准确性:**ResNet在图像分类、目标检测和语义分割等任务上取得了最先进的性能。

```python

import torch

import torch.nn as nn

class ResidualBlock(nn.Module):

def __init__(self, in_channels, out_channels, stride=1):

super(ResidualBlock, self).__init__()

self.conv1 = nn.Conv2d(in_channels, out_channels, kernel_size=3, stride=stride, padding=1)

self.bn1 = nn.BatchNorm2d(out_channels)

self.relu = nn.ReLU()

self.conv2 = nn.Conv2d(out_channels, out_channels, kernel_size=3, stride=1, padding=1)

self.bn2 = nn.BatchNorm2d(out_channels)

self.shortcut = nn.Identity()

if stride != 1 or in_channels != out_channels:

self.shortcut = nn.Conv2d(in_channels, out_channels, kernel_size=1, stride=stride)

def forward(self, x):

out = self.conv1(x)

out = self.bn1(out)

```

0

0